2つのAIを使った音声翻訳サービス、日本語にも対応:人工知能ニュース

マイクロソフトは同社が展開するクラウドベースの機械翻訳サービス「Microsoft Translator」を強化し、ニューラルネットワーク機能を盛り込み、より自然な翻訳を実現した。

米国Microsoft(マイクロソフト)は2017年4月7日、同社が展開するクラウドベースの機械翻訳サービス「Microsoft Translator」を強化し、ニューラルネットワーク対応とした他、日本語に対応したことを発表した。

マイクロソフトの翻訳サービスである「Microsoft Translator」は、クラウドベースのオープンなAPI(Application Programming Interface)サービスで、テキストの機械翻訳を行う。60以上の言語に対応。Azureサービスの一部として提供され、製品やサービスの一部に組み込んで展開することなども可能。言語翻訳については、人工知能(AI)などによる研究が進んでいるが、まだまだ人間が行う通訳に比べると品質差が大きい。しかし、人間による翻訳に大きいコストが掛かる場合や、コンテンツが頻繁に作成され更新ペースが早い場合、翻訳スピードの優先度が高い場合などでは活用の余地は大きいといえる。

従来の機械翻訳は、統計的手法が用いられていたが、基本的には単語ベースでの状況把握となるため、同じ単語がさまざまな意味で用いられる翻訳では、長い文章の文脈の正しい解釈と翻訳後の再構築という点で、課題を抱えていた。そこでマイクロソフトでは、新たに翻訳技術に深層学習(ディープラーニング)技術を組み込み、各単語で想定されるモデルを作成し、文章全体の中の文脈を見た上で、その文脈内で単語モデルを翻訳するという仕組みを作った。

マイクロソフトのAI & Researchグループ ディレクターであるオリヴィエ・フォンタナ(Oliver Fontana)氏は「ニューラルネットワークを活用するということは自動車でいえばガスエンジンから電気エンジンへと切り替えるようなものだ。全く新しい能力を持つことになる」と価値について述べている。

2つのAIを使った音声翻訳機能

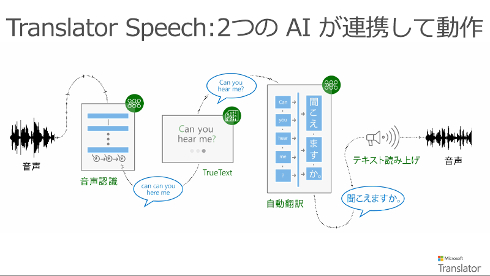

さらに、マイクロソフトでは、ニューラルネットワークを活用したテキスト翻訳に加えて、音声認識にもAI関連技術を採用。音声翻訳は、マイクロソフトの独自技術「TrueText」で、音声認識用と機械翻訳用の2つの異なるタイプのAIを組み合わせることで実現する仕組みとしている。TrueText は認識された音声を機械翻訳で翻訳可能な形に変換する機能だ。

音声翻訳を行う場合、まず音声認識ニューラルネットワークシステムへと音声を送る。このシステムは、人間の自然な対話を扱えるよう設計されている。人間は自然の対話の中ではつなぎ言葉を発している。専門領域では「ディスフルエンシ(disfluencies)」と呼ばれているもので、日本語では「えーと」などに当たる。「TrueText」ではこの不要なつなぎ言葉を削除し、完全な文章に必要な大文字化や、句読点の追加を行い、翻訳ステージでの適切な処理を可能とする。

次に、「TrueText」の出力を機械学習による2つ目のAI機能に送られ、文章の文脈を利用してより流ちょうで人間らしく聞こえる翻訳を行う。そして、最後にテキスト読み上げ機能により、音声に変換する。

マイクロソフトではこれらの機能を、マイクロソフトの全てのアプリケーションに採用していく方針を示している。

関連記事

マイクロソフトが研究する「信用できるAI」は「FATE」が必要

マイクロソフトが研究する「信用できるAI」は「FATE」が必要

マイクロソフトの研究部門であるマイクロソフトリサーチ(MSR)は、AI研究について「基礎研究」「タスク完了」「信用できるAI」という3つの方針を掲げている。また方針の1つである「信用できるAI」には「FATE」が必要になるという。 まずは植物工場から――富士通とマイクロソフトが製造業向けIoTで協業

まずは植物工場から――富士通とマイクロソフトが製造業向けIoTで協業

富士通と米国マイクロソフトは、製造業分野におけるIoTを活用した技術展開において協業することを発表した。まずは富士通の会津若松の植物工場で実践を行う。 高精度な英文特許自動翻訳サービスをセキュアなクラウド環境で提供

高精度な英文特許自動翻訳サービスをセキュアなクラウド環境で提供

情報通信研究機構、みらい翻訳、日本特許翻訳、化学情報協会は、高精度でセキュアな英文特許自動翻訳サービスを開発した。外国公報全体を表や数式、図も含めて正確な日本語に翻訳し、セキュアなクラウド環境を通じて提供する。 機械と電話のハイブリッド翻訳、京急で試験導入

機械と電話のハイブリッド翻訳、京急で試験導入

京急電鉄と情報通信研究機構(NICT)、ブリックスは鉄道分野における外国人との円滑なコミュニケーションを目的とした実験を開始する。翻訳アプリに電話翻訳のサービスを組み合わせ、有用性を検証する。 「IoTの第2フェーズはまだ始まっていない」富士通山本正己氏

「IoTの第2フェーズはまだ始まっていない」富士通山本正己氏

10月7日まで開催されたCPS/IoT展「CEATEC JAPAN 2016」の基調講演で登壇した富士通 代表取締役会長の山本正己氏は「IoT活用の第2段階はまだ始まっていない」と述べている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- 日本のロボット開発は「安全性」を優先、フィジカルAIも重視するが姿勢は慎重

- PCマウス原理でエレベーターの“ロープ”不要に AI保守を見据える日立HMAX戦略

- 物理世界と相互作用する「フィジカルAI」 AWSが語るロボット制御の進化とは

- CEATEC AWARDから6年越しの商品化、村田製作所の超音波デバイス「サーモホン」

- Astemoと日立が運転支援AI開発基盤構築の狙いを説明、「SDVのさらなる強化へ」

- 2035年のパワー半導体市場は7兆3495億円に倍増、酸化ガリウムが149億円規模に

- ボッシュとオモビオのソフト子会社が禁断のタッグ!? ADAS向けソフト基盤で協業

- 最新のBlackwellアーキテクチャを搭載した組み込みGPUシリーズを量産開始

- 中小FPGAベンダー盛衰記――QuickLogicからSilicon BlueそしてまたLatticeへ

- 車載小型モーター用マイコン統合型ドライバの新製品、サンプル出荷開始

コーナーリンク