ディープラーニングで最適なステアリング制御は実現するか、スバルの挑戦:自動運転技術

SUBARU(スバル)は、NVIDIAのユーザーイベント「GTC Japan 2018」(2018年9月13〜14日)において、2024年以降の製品化を目指す開発中の自動運転システムについて紹介した。スバル 第一技術本部 自動運転PGMの主査で、開発に携わる小山哉氏が登壇した。

SUBARU(スバル)は、NVIDIAのユーザーイベント「GTC Japan 2018」(2018年9月13〜14日)において、2024年以降の製品化を目指す開発中の自動運転システムについて紹介した。スバル 第一技術本部 自動運転PGMの主査で、開発に携わる小山哉氏が登壇した。

スバルは2020年に高速道路での高度な運転支援システムを製品化し、2024年以降で高度な運転支援を行う範囲を自動車専用道路や一般道に広げる計画だ。自動運転のレベルに置き換えると2020年にレベル2を、2024年以降でレベル2以上の自動運転システムや、レベル4に相当する自動駐車機能を開発する。

高速道路のみでの高度な運転支援システムは、ステレオカメラと車両の四隅に配置したミリ波レーダー、デジタルマップやGPS情報を使用する。対応範囲を一般道などにも広げるには、さらにきめ細かい周辺監視やセンサーの多重化、システムによる走行計画の策定(パスプランニング)といった技術の搭載が必要になると見込む。

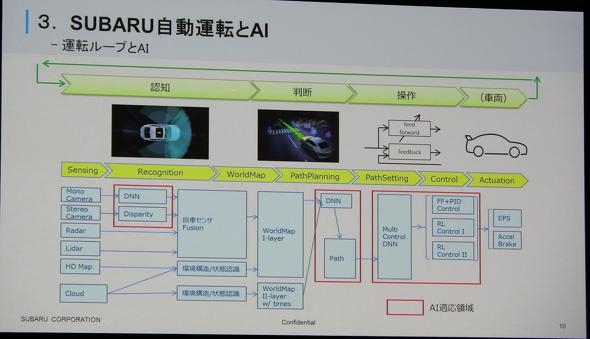

そのため、現在、スバルでは周辺環境の認識やパスプランニング、走行計画に基づく車両の制御に深層学習(ディープラーニング)を活用しようと開発を進める。その先行開発プラットフォームとして、NVIDIAの「DRIVE PX2」が採用されている。

単眼カメラ8個で途切れず周辺監視

2024年以降のレベル2〜4の自動運転を想定した実験車両には、ステレオカメラ1基と6個の単眼カメラ、4つのミリ波レーダー、LTE端末、GNSSアンテナを装着する。DRIVE PX2はこれらの情報をまとめる知能化ECUとして搭載されている。

周辺環境の認識では、ステレオカメラを2個の単眼カメラとし、単眼カメラ8個という扱いで個々のカメラがディープラーニングで周囲の物体までの距離を検出する。2個以上のカメラで検知エリアが重なるため冗長性を確保できるほか、複数のカメラの視差を利用して障害物までの距離を立体的に把握できるという。シミュレーションや実際の走行データをもとに、8個の単眼カメラで周囲の車両を途切れることなく捕捉し続けられることを確認済みだ。

道路の形状や車両の相対位置、車両の状態などを基にした最適な運転を、深層学習で実現できるかどうかについても検証を進めている。操舵(そうだ)の制御について、コース内の車両偏差を報酬に強化学習を行うこととした。MILS(Model in the Loop Simulation)による学習を実施し、学習済みのニューラルネットワークを実装したコントローラーが最適な操舵のために動作できることをHILS(Hardware in the Loop Simulation)で確かめた。

そのコントローラーを実際の車両に搭載し、狭いカーブなどでも最適な運転が可能か検証した。その結果、カーブでは安定して操舵を制御できたものの、直進中にステアリングがガクガクと左右にぶれることが判明。原因として、車線内の横位置に対する報酬が高いことや、学習時の車両のプラントモデルの再現性が低いことがあるという。

対策としては、より精度の高いプラントモデルを用いて学習することや、エンジニアの手でプログラムする既存の操舵制御技術と深層学習による操舵の併用、ニューラルネットワークの層を増やすことなどを想定している。ただ、既存の操舵制御技術と併用する場合は、深層学習による判断と人力のプログラミングが一致しないことが起こり得る。登壇した小山氏は「どういった場面でどちらを優先するか、1つずつ潰していくことが課題になる」と語った。

関連記事

スバルの2020年の高度運転支援システムは次世代「アイサイト」とミリ波レーダー

スバルの2020年の高度運転支援システムは次世代「アイサイト」とミリ波レーダー

SUBARUは「第45回東京モーターショー 2017」において、高度運転支援技術を搭載したスポーツセダンのコンセプトモデル「VIZIV PERFORMANCE CONCEPT(パフォーマンスコンセプト)」を世界初公開した。 「ぶつからない」と言い切ったアイサイトが日本の運転支援システムを変えた

「ぶつからない」と言い切ったアイサイトが日本の運転支援システムを変えた

2009年まで、日本では衝突する前に完全に停止する自動ブレーキが法規制で認められていなかったが、今や部分的ながら自動運転システムも利用されるようになった。自動運転の前段にある運転支援システムを、前後編に分けて紹介する。前編は、クルマがぶつからないための技術だ。 開発中止の危機を乗り越えヒット商品に、「EyeSight」成功の原動力とは

開発中止の危機を乗り越えヒット商品に、「EyeSight」成功の原動力とは

富士重工業のステレオカメラを用いた運転支援システム「EyeSight」の販売が好調だ。同社の主力車種「レガシィ」では、新車販売時の装着率が90%にも達するという。ヒット商品に成長したEyeSightだが、今ある成功の陰には開発陣の20年以上にわたる苦闘があった。基礎研究の段階から開発に携わってきた樋渡穣氏に、EyeSight開発の道のりについて聞いた。 市街地の自動運転で役割広がるAI、車載カメラでの使い方さまざま

市街地の自動運転で役割広がるAI、車載カメラでの使い方さまざま

「人とくるまのテクノロジー展2018」に出展した外資系大手サプライヤーのブースから、人工知能技術を活用した画像認識の取り組みを紹介する。 ダイムラーの完全自動運転はNVIDIAの「DRIVE Pegasus」、バッテリーと一緒に水冷

ダイムラーの完全自動運転はNVIDIAの「DRIVE Pegasus」、バッテリーと一緒に水冷

NVIDIAとRobert Bosch(ボッシュ)、Daimler(ダイムラー)は、完全自動運転車と無人運転車に、NVIDIAのAI(人工知能)コンピュータ「DRIVE Pegasus」を採用する。 ヤマハ発動機が「万能型の知能化プラットフォーム」を構築へ、NVIDIAと協業

ヤマハ発動機が「万能型の知能化プラットフォーム」を構築へ、NVIDIAと協業

ヤマハ発動機は、研究開発中の製品群の自動化や知能化に向けてNVIDIAと協業する。今後は、NVIDIAの組み込み機器向けGPUコンピューティングシステム「Jetson AGX Xavier」などを用いて、あらゆる製品に展開可能な「万能型の知能化プラットフォーム」を構築する方針だ。

Copyright © ITmedia, Inc. All Rights Reserved.

モビリティの記事ランキング

- 新型「bZ4X」の走行距離が伸びた理由、デンソーの「世界初」と「世界最高」が貢献

- ギガキャストを発案したテスラの現在・過去・未来

- ECUの一体化で進化したトヨタの「新型TSS」 RAV4の安全走行を支える技術とは

- スズキ、排出ガス中のCO2を回収し農場で再利用できる「スーパーキャリイ」披露

- SDV時代には「製品開発スピード」だけでなく「製品発見スピード」も求められる

- どこへでも移動可能な自由を── ランドクルーザーの新型車「FJ」シリーズが登場

- 「新興勢力に圧倒的に劣っている」――ホンダは開発を根本から変えられるか

- コマツが次世代月面物流ローバーの研究開発を開始

- 新型「CX-5」はSUVの王道を極める、SDV化も進みアップデートでGeminiも利用可能

- デンソー新型SiCなど世界初公開23件! 「人テク展」が映す自動車技術の現在地

コーナーリンク