AIプロダクトの品質保証をAI技術で支援する、「AI4QA」という考え方:人工知能ニュース(2/2 ページ)

社会的な影響を視野に入れたAI開発を

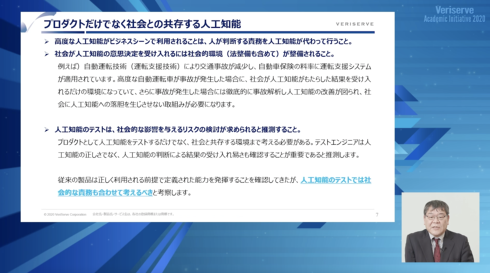

佐々木氏は、AIにおける品質保証の考え方は、通常のプロダクト開発とは異なるものが求められていると指摘した。「仮にAIが社会を落胆させる事件や事故が起こってしまったら、第3次ブームが終わる要因となりかねない。AIを単なるプロダクトとしてではなく、『社会インフラ』の1つとして捉える必要がある。AIのシステム検証を行うことは、すなわち、社会的な責務である」(佐々木氏)。

通常の「品質保証」は、プロダクトの使用結果について製造者が消費者に対して責任を持つ、ということを主に意味する。しかしAIの場合には、使用した結果が及ぼす社会的な影響までを視野に入れた品質保証の在り方が求められる。

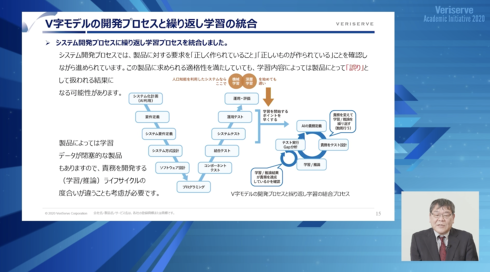

とはいえ、AIのアウトプットを確認し、問題を確認してから開発をやり直すのではロスタイムが大きくなる。そこで佐々木氏が提案するのが、一般的なシステム開発で参照されるV字モデルの開発プロセスの中で、AIの責務定義と学習/推論プロセスのサイクルを素早く回す「繰り返し成長モデル」を統合したAI開発アプローチである。

アプローチ自体はまだ構想段階にとどまると前置きした上で、佐々木氏は「システム検証時点でAIの責務開発を繰り返し行い、運用・評価時点ではベースとなる責務データ、学習モデルが完結していることが望ましい。それを実現し得るのが、この統合型アプローチだ」と語る。

しかし、この開発プロセスを実際の現場に適用すると、何度も繰り返しシステムの検証を行うため、そのプロセスに膨大な時間を費やさなければならなくなる。そこで効率化、精度向上のために期待されるのがAIの力である。つまり、AI4QAの取り組みが役立つ。

AI4QAのツールは開発者の負担を軽減、効率的な開発を支援する

ベリサーブ 研究企画開発部 部長の松木晋祐氏は品質保証を支援する自動化ツールについても紹介した。

2000年代後半からいくつかの自動化ツールが登場し、少しずつ技術革新が起きている。AI技術の進展によって、単純な作業自動化だけでなく、「失敗したテスト結果」を自動的に予測、作成してくれるツールも登場した。テスト時間を短縮して効率化が図れるので、開発者としてはプロダクトの価値検討や、品質の向上に向き合う時間を確保できるようになる。これらのツールはコードのオープンソース化の動きも相まって、日々刻々と進歩を続けている。

松木氏は、AIの重要性が高まる現在の“ウィズAI時代”においては、QA4AI、そしてAI4QAという品質保証の考え方を適用していくべきだと指摘する。

「こうした技術を使える組織と使えない組織においては、新しいバージョンのAIプロダクトを世に出すリードタイムに100倍の開きが出るともいわれている。品質保証は単に個人の努力や資質によるものではなく、組織的な投資でカバーできる部分がかなりある点に気付かれたい」(松木氏)

加熱しすぎた一時のブームは去ったように思えるが、コロナ禍の最中、AIに対する社会的な期待は着実に大きくなっていることは間違いない。今後、社会インフラに関わる分野での導入が進めば、AIに対する社会的な責任は一層重くなる。

AIの社会的な価値や責務から逆算して品質保証を実現する視点も、今後のモノづくり開発では必要になる。

関連記事

進まぬ製造現場のAI活用、AIベンダー側とユーザー側のそれぞれの事情

進まぬ製造現場のAI活用、AIベンダー側とユーザー側のそれぞれの事情

マクニカとマクニカネットワークスは2020年7月2〜3日と9〜10日の4日間、シンポジウム「Macnica Networks DAY 2020+macnica.ai」をオンライン形式で開催した。本稿では、マクニカイノベーション戦略事業本部カスタマーサクセス部課長の本村健登氏による「製造業はAIごときで立ち止まるな〜Industrial DXを実現した企業の5つの秘密〜」の内容を紹介する。 “人をお手本にするAI”は製造現場に何をもたらすのか

“人をお手本にするAI”は製造現場に何をもたらすのか

協働ロボットなど機械が人と共に働く場面が増える中で、円滑に人と協調する能力が機械にも求められるようになっている。これらの要望に応えるため、三菱電機では「人と協調するAI」を開発した。同技術により得られる価値や狙いについて、開発陣に話を聞いた。 製造現場で活躍広がる「画像×AI」、どういう場で生きるのか

製造現場で活躍広がる「画像×AI」、どういう場で生きるのか

グルーヴノーツは、「製造×画像AI」をテーマに2020年4月14日、オンラインセミナーを開催。グルーヴノーツ アカウントエグゼクティブ 岩野敦氏が製造業向けのインフラ設備・機械の保全・安全管理業務における画像AIの活用事例などを紹介した。 教師データは深層学習の10分の1、スパースモデリング活用の外観検査AIキット

教師データは深層学習の10分の1、スパースモデリング活用の外観検査AIキット

HACARUS(ハカルス)は2021年1月7日、AI技術の一分野であるスパースモデリング技術を活用した外観検査AIスターターキット「SPECTRO GO」の提供を開始した。同技術はディープラーニングと比較すると、より少ない画像数で高精度のAIモデルを作成できるという強みがある。 正常データだけで学習する異常検知AIに新手法、半導体ウェーハで検知精度90%超も

正常データだけで学習する異常検知AIに新手法、半導体ウェーハで検知精度90%超も

東芝が製品の外観画像から製造状態の異常を検知するAI技術について世界トップレベルの検知性能を達成したと発表。公開データを用いた際の検知精度で従来手法の69.5%から79.1%に向上したという。これにより、製造現場で収集が困難な異常データを使用することなく、正常データを用いて学習を行ったAIで高精度の異常検知を行えるようになる。 技術者知見を学習する不良原因解析AIを東芝が開発、自社半導体工場へ導入

技術者知見を学習する不良原因解析AIを東芝が開発、自社半導体工場へ導入

東芝は2020年12月10日、現場技術者の知見を加えることで半導体工場や化学プラントなど変数が多項目に及ぶ工場において、不良原因解析を容易化するAIを開発したと発表した。同技術は、機械学習分野における最大級の国際会議の1つである「NeurIPS 2020」に採択されている。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- 「成長していないパナソニック」から脱却へ、楠見CEOが「MIF」で描く次の一手

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

コーナーリンク