産総研のフィジカルAIプロジェクトに迫る 10万年ギャップを超えろ!:組み込みイベントレポート(5/5 ページ)

限定資源下におけるマルチモーダル/視覚基盤モデルの構築

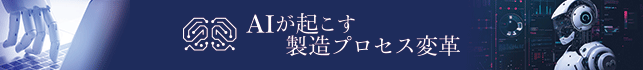

最後に、産総研 人工知能研究センター コンピュータビジョン研究チーム 上級主任研究員の片岡裕雄氏が、産総研で構築している限定資源下でのVFM(視覚基盤モデル)について紹介した。データ、モデル両方のノウハウを持つメンバーで開発を行っており、4つのモダリティ(2D画像、3D点群、動画、視覚と言語のマルチモーダル)のモデルを構築して統合していると全体像を紹介した。

片岡氏らは「リミテッド」、すなわち限定資源下におけるマルチモーダル/視覚基盤モデル構築をテーマとしている。複数モダリティを効率的に個別構築し、データ収集とモデル構築の経験を積み重ねながら横展開/社会実装を通じて知見を獲得し、学習を継続改善していく戦略を採用している。プロジェクトでは仮想国際連携拠点「LIMIT.Lab」を結成して、英国、ドイツ、オランダなどとも国際連携しており、トップカンファレンスでのワークショップ開催なども行い、年間70本以上の論文を輩出している。活動の中から、「スケーリングバックワーズ(Scaling Backwards)」というパラダイムも生まれている。計算量が少なくデータが少ない条件下でもトランスフォーマーモデルを効率よく学習できるという思想であり、特に合成データの活用によって高効率な基盤モデル構築が可能であることが示されている。

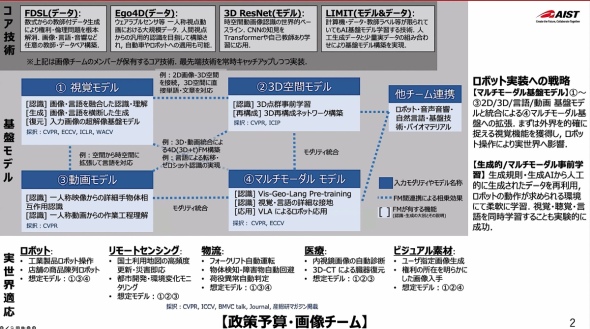

技術的な取り組みはモダリティごとに異なる。VFMは超解像基盤モデルを構築している。フィルタリングによってデータをある程度削減する一方、より高品質なデータのみを残すことで、むしろ性能が向上することを明らかにした。さらに、テキストから生成した合成画像データを活用することで、特にアート領域の超解像における性能向上が確認されている。画像認識のロバスト性についてはモアレ画像を混ぜ込むことでロバスト性が増すという。

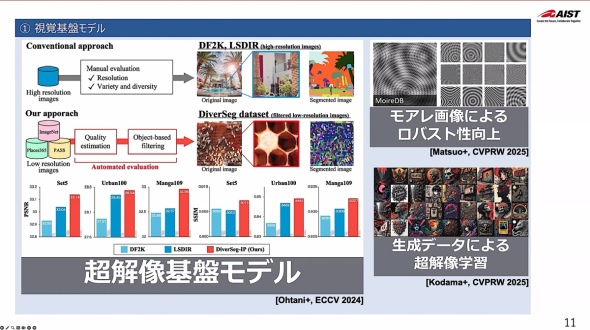

3D点群の基盤モデル構築にも取り組んでおり、こちらには動画を用いている。従来、3次元データの収集は人がスキャナーを持って現実世界をスキャンする方法が主流だったが、手間がかかる。これが3D自己教師あり学習(Self-Supervised Learning)のボトルネックである。そこで動画から3次元再構成モデルを使って3D点群データに変換し、そのデータを自己教師あり学習に投入することで、3D空間表現を獲得させるという手法で、この問題を解決しようとしている。動画から再構成した3Dデータだけで、実世界スキャンデータに匹敵する性能が得られたという。

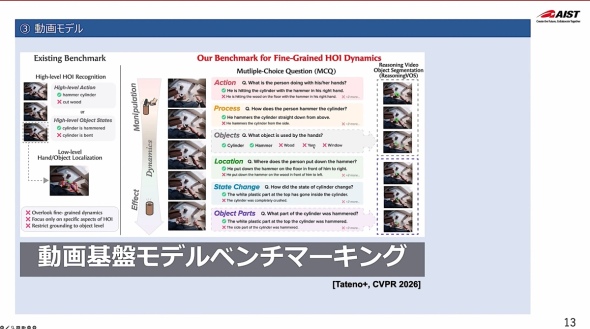

動画モデルについては、動作分類にとどまらず、一人称視点からの手と物体の相互作用といった細粒度の理解に焦点を当てている。行動/プロセス/物体の状況変化に対応できているかを計測するベンチマークとして新しく「HanDyVQA」を設定し、一人称視点映像に特化した評価基盤を整備している。

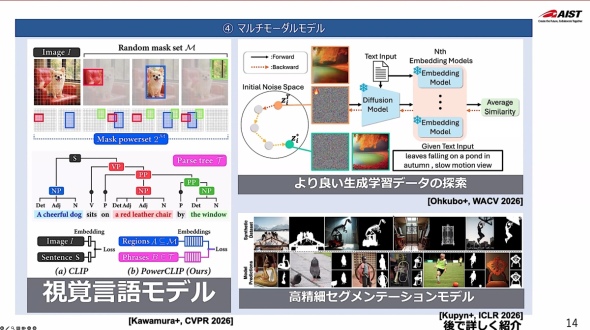

4つ目がマルチモーダルである。VLMを基本として、より良い生成学習データの探索、Text-to-Imageモデルを活用した高精細セグメンテーションモデルの構築などを進めている。

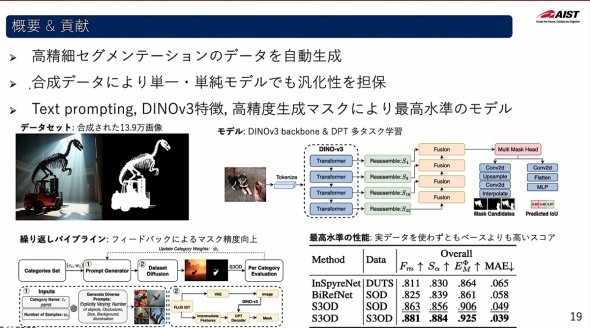

高精細画像セグメンテーションは、ピクセル単位の精密なアノテーションが必要であり、人手によるラベル付けに膨大な時間を要するという問題があった。そこでText-to-Imageモデルを活用し、画像だけでなくラベルまでも自動生成するという手法を採用した。また、Metaが公開している汎用視覚特徴抽出モデル「DINOv3」をバックボーンとして活用している。約13.9万枚の画像とラベルのペアデータを自動生成し、高品質な視覚特徴を基盤モデルから取り込み、カテゴリーごとに出力/評価し、認識精度が高かったカテゴリーをフィードバックしてプロンプトを調整するループ構造を作ってアノテーションを反復改善させたところ、実データを1枚も使わず、合成データのみでベースラインを超えるスコアを達成した。この成果は「基盤モデルが次の基盤モデル開発のベースとなる」という発展が可能であることを実証している。

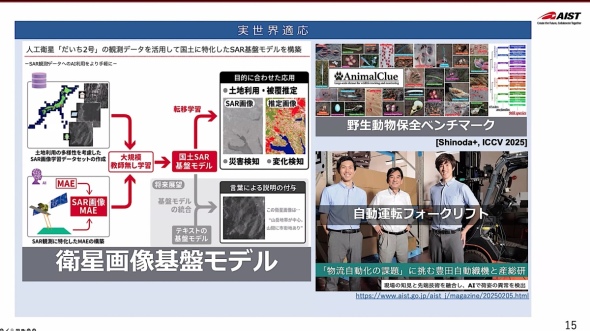

実世界での応用では、人工衛星画像基盤モデル、野生動物保全ベンチマーク「AnimalClue」、豊田自動織機との連携による自動運転フォークリフトの開発を挙げ、研究から社会実装までを一貫して行っているという。

産総研による学術成果と社会実装の橋渡し

最後に、産総研 人工知能研究センター 研究センター長の片桐恭弘氏が全体をまとめた。片桐氏は「この分野は変化が速い。なるべく早く実態を伝えてフィードバックすることが必要と考え今回のイベントを開催した。まだまだやるべきことがある。国研として、学術成果の学会発表と社会実装の橋渡しの両方が必要。コラボレーションも大歓迎だ。これからも拡大していくのでぜひ参加してほしい」と述べている。

関連記事

CES 2026でも過熱する「フィジカルAI」、バズワードを脱して本格的なトレンドへ

CES 2026でも過熱する「フィジカルAI」、バズワードを脱して本格的なトレンドへ

2025年後半から日本国内でもバズワードとして取り上げられてきた「フィジカルAI」。その主戦場は日本が得意とする自動車とロボットであり、2026年はこのフィジカルAIが本格的なトレンドとして定着していく年になるだろう。「CES 2026」でもフィジカルAIに向けた新製品の発表が相次いだ。 黒船「フィジカルAI」襲来 日本におけるヒューマノイド開発の最適解とは

黒船「フィジカルAI」襲来 日本におけるヒューマノイド開発の最適解とは

アールティが、産業技術総合研究所、川田テクノロジーズ、川崎重工業などと共同で「フィジカルAI勉強会」を開催。ヒューマノイドの実用化に必要不可欠な技術としてフィジカルAIという言葉そのものや技術成熟度への認識については混乱が見られる中、今回の勉強会は現時点でのフィジカルAIの捉え方を共有することを目的に開催された。 日立がフィジカルAIへの注力を鮮明に、東京駅直結の協創施設に体験スタジオ開設

日立がフィジカルAIへの注力を鮮明に、東京駅直結の協創施設に体験スタジオ開設

日立製作所がJR東京駅直結の協創施設「Lumada Innovation Hub Tokyo」内に開設する「フィジカルAI体験スタジオ」について説明。同社のAIで社会インフラを革新する次世代ソリューション群「HMAX」で重要な役割を果たす、フィジカルAIに関する日立の先行導入事例やソリューションを体験できる。 三菱電機と燈が目指す暗黙知のデータ化、現場で使えるフィジカルAI

三菱電機と燈が目指す暗黙知のデータ化、現場で使えるフィジカルAI

三菱電機と燈は「協業に関する戦略発表会」を開催。AI活用による協業戦略について説明した。三菱電機の持つ現場の知見や制御技術と、燈の高度なデジタルツインやAI技術を融合し、フィジカルAIの実装を加速させる。 フィジカルAIで変わるロボットの在り方、ヒューマノイドロボットの衝撃

フィジカルAIで変わるロボットの在り方、ヒューマノイドロボットの衝撃

本連載では、「デジタルツイン×産業メタバースの衝撃」をタイトルとして、拙著の内容に触れながら、デジタルツインとの融合で実装が進む、産業分野におけるメタバースの構造変化を解説していく。第9回となる今回は、フィジカルAIへの期待とヒューマノイドロボットのインパクトを解説する。 フォックスコンがフィジカルAIで実現する「AX」とは、NVIDIAと川崎重工も講演

フォックスコンがフィジカルAIで実現する「AX」とは、NVIDIAと川崎重工も講演

「ファクトリーイノベーションWeek2026」の2日目に当たる2026年1月22日、「知能化・AI化が進むロボットと工場:世界最先端事例から学ぶ」と題した特別講演が行われ、フォックスコン(鴻海精密工業)とNVIDIA、川崎重工業が登壇した。

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- IoTとは何かを問いただすため、まずは薪ストーブに熱電対センサーを取り付ける

- PCマウス原理でエレベーターの“ロープ”不要に AI保守を見据える日立HMAX戦略

- イチから全部作ってみよう(32)PythonでSQLを実行してデータベースを操作する

- ソフトウェアテスト自動化SDKをオープンソースで公開

- 動かぬ検証機「SEIMEI」に純国産ヒューマノイド開発に向けたKyoHAの覚悟を見た

- 消費電力を10分の1に低減したグローバルシャッター搭載CMOSイメージセンサー

- ソフトバンクが堺にギガファクトリー、国産の燃えない水電池を2027年度に量産へ

- 電力を最大64%低減、エッジデバイスにも応用可能なモバイル向けプロセッサ

- 2035年のパワー半導体市場は7兆3495億円に倍増、酸化ガリウムが149億円規模に

- 1.42×1.00×0.43mmの超小型反射形フォトインタラプタを開発

コーナーリンク