ジム・ケラー氏率いるテンストレントがNVIDIAに対抗、鍵は“AIコンピュータ”:人工知能ニュース(2/2 ページ)

生成AIでも技術的な優位性を生かす

テンストレントのAIアクセラレータは、多くのAIスタートアップが学習もしくは推論のどちらかに特化した技術を展開しているのに対して、学習にも推論にも高い性能を発揮できることを特徴としている。競合として想定するのは、高性能GPU技術を中核にAI開発に必要なツールやライブラリ、ミドルウェアなどを展開するNVIDIAだ。

ケラー氏は「AIのトレンドが大きく高まったタイミングに応えたのがNVIDIAのGPUだ。ただし、GPUはAI処理に最適化されてはいない。当社のAIアクセラレータが効率性で上回ることを証明して行く必要がある。またGPUによるAI処理は、CPUやメモリとのアクセスがボトルネックになることも課題の一つだ。CPUとしてRISC-Vを統合したBlackhole移行の世代ではこれらのボトルネックを解消して、より省電力で低コストのAIコンピュータを実現できる」と説明する。

技術的な優位性の一方で、NVIDIAのGPUを一気に置き換えていくというような性急な将来像を描いているわけではない。AIモデル開発のインフラとして、NVIDIAの「CUDA」はデファクトスタンダードであり、今後もしばらくはCUDAとNVIDIAのGPUが最初の選択肢になることは確かだからだ。「AMD時代に開発した64ビット対応のOpteronは、大手サーバメーカーの採用も勝ち取ったが、一気に競合のインテルを置き換えるところまではいかなかった。しかし現在のサーバアーキテクチャをみれば、Opteronから始まった64ビット対応の技術が100%を占めるようになっている。このように、結果がすぐに出るとは限らないが、当社の優位性を基にしっかりと取り組みを進めていきたい」(ケラー氏)という。

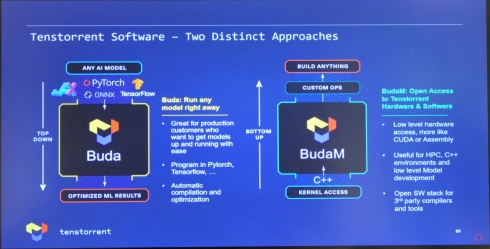

なお、テンストレントのAIモデル開発環境としては、開発済みのAIモデルを最適化する「Buda」と、CUDAのようにAIアクセラレータのハードウェア機能をフル活用してAIモデルを開発するための「BudaM」を用意している。

また、ChatGPTなどに代表される生成AIについても、AIアクセラレータとRISC-VベースCPUで構成されるテンストレントのAIコンピュータを有効活用できるという。ケラー氏は「当社のAIアクセラレータは、学習と推論の両方に対応し、画像、自然言語、小規模から大規模に至るまでさまざまなAIモデルを扱える。生成AIでは、より大きなモデルをより小さなリソースで処理できることが求められるが、そういった意味で当社のAIコンピュータは最適だろう。直近2年間でAIモデルには5つの大きな革新があったが、今後2年間も5つ以上の新たな革新が生まれるだろう。当社はそれらの革新に対応しながら、技術的な優位性を生かして事業を拡大していきたい」と述べている。

関連記事

RISC-Vとチップレットで“高性能”を設計、ジム・ケラー氏率いるテンストレント

RISC-Vとチップレットで“高性能”を設計、ジム・ケラー氏率いるテンストレント

AIアクセラレータやRISC-VベースのCPU、チップレット技術を手掛けるテンストレント(Tenstorrent)の日本法人・テンストレント・ジャパンが、同社のプロダクトや事業戦略などについて説明した。 脳型AI半導体のBrainChipが第2世代IPを投入、エッジ活用に向け本格提案

脳型AI半導体のBrainChipが第2世代IPを投入、エッジ活用に向け本格提案

脳の構造を模倣するニューロモーフィック技術を活用したAI半導体を手掛けるオーストラリアのBrainChipが、第2世代IPとして2023年9月のリリースを計画している「Akida 2.0」について説明した。 エッジAIの3つの課題を克服するルネサス、組み込み向けではNVIDIAより優位

エッジAIの3つの課題を克服するルネサス、組み込み向けではNVIDIAより優位

ルネサス エレクトロニクスが同社のエッジAIの事業状況や今後の展開などを説明。エッジやエンドポイントといった現場側へのAIの実装では「DRP-AI」をはじめとする同社の技術やパートナーとのエコシステムが生かせる点を強く打ち出した。 「Jetson Orin Nano」の開発者キットはエッジでトランスフォーマーモデルが動く

「Jetson Orin Nano」の開発者キットはエッジでトランスフォーマーモデルが動く

NVIDIAは、「GTC(GPU Technology Conference) 2023」において、組み込み機器向けAIモジュールの新製品「Jetson Orin Nano」の開発者キットを発表した。同年4月の出荷予定で、米国での価格は499米ドル。 RISC-Vへの移行の流れは止まらない、「2024年にはArmを超える」

RISC-Vへの移行の流れは止まらない、「2024年にはArmを超える」

SiFive Japanは、SiFive米国本社で共同設立者・主任設計技術者を務めるクルスト・アサノヴィッチ氏の来日会見を開いた。同氏は「業界は常に高品質のオープンスタンダードを求めており、プロセッサもRISC-Vへの移行が進めば元に戻ることはない」と強調した。 「今こそRISC-V浸透のベストタイミング」、SiFiveが日本法人を設立

「今こそRISC-V浸透のベストタイミング」、SiFiveが日本法人を設立

オープンソースのプロセッサコア「RISC-V」に基づく半導体IPプロダクトを展開するSiFiveが、日本法人「SiFive Japan株式会社」の設立を発表した。2022年8月に法人登記を完了する予定で、代表取締役社長には、ザイリンクス日本法人の社長を務め、スパンションやAMDの日本法人でも活躍してきたサム・ローガン氏が就任する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- 三菱電機が第5世代SiC-MOSFETを開発、オン抵抗を25%削減し業界トップクラスに

- 中小FPGAベンダー盛衰記――QuickLogicからSilicon BlueそしてまたLatticeへ

- NVIDIAの「RTX Spark」と搭載ノートPCがCOMUPTEX TAIPEIのMediaTekブースに集結

- ガラスの透明性を維持するフルカラー3Dホログラムの作製手法を開発

- 波長3μm付近の中赤外光を検知、分子ごとの特徴を読み取れる小型赤外光センサー

- ダイキンがタイに空調機器向け組み込みソフト開発の合弁会社を設立

- 動きを先読みして触覚で状況を判断 新たなロボット基盤モデル「RLDX-1」とは

- 「WEDA」を前面に押し出すアドバンテック、エッジAIモデルの開発期間を86%削減

- 「TOUGHBOOK」による過酷な環境でのエッジコンピューティングが可能に

- CEATEC AWARDから6年越しの商品化、村田製作所の超音波デバイス「サーモホン」

コーナーリンク