RISC-Vとチップレットで“高性能”を設計、ジム・ケラー氏率いるテンストレント:組み込み開発ニュース(1/2 ページ)

AIアクセラレータやRISC-VベースのCPU、チップレット技術を手掛けるテンストレント(Tenstorrent)の日本法人・テンストレント・ジャパンが、同社のプロダクトや事業戦略などについて説明した。

AI(人工知能)アクセラレータやRISC-VベースのCPU、チップレット技術を手掛けるテンストレント(Tenstorrent)の日本法人・テンストレント・ジャパンは2023年3月28日、オンラインで会見を開き、同社のプロダクトや事業戦略などについて説明した。

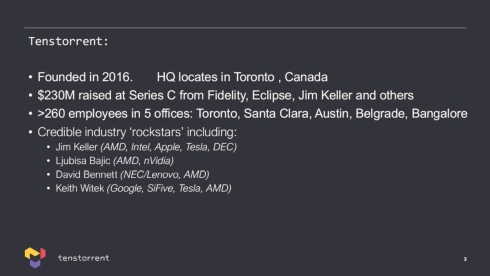

2016年創業でカナダに本拠を置くTenstorrentは、AI関連のハードウェアやソフトウェア、オープンソースのプロセッサコアであるRISC-VベースのCPUなどを手掛けるベンチャー企業だ。本社はトロントにあるものの、開発の主体は米国のサンタクララやオースティンなど半導体/エレクトロニクス産業の集積地に置き、セルビアのベオグラード、インドのベンガルール(バンガロール)を含めた5拠点で従業員数は約260人だ。スタートップ企業だが、黒字経営が安定するシリーズCに入っており、これまでの総投資額は2億3000万米ドルとなっている。

テンストレントの名前がクローズアップされたのは、先端半導体の設計者として知られるジム・ケラー(Jim Keller)氏が入社した2020年12月のことだ。ケラー氏は2021年1月には社長兼CTO兼取締役に就任し、その後CEOとなり同社を率いている。ケラー氏は、DECの「Alpha 21164/21264」に始まり、AMDの「Athlon」、アップル(Apple)の「A4/A5」の開発を手掛け、再びAMDに戻って開発した「Zen」は現在のAMDの勢いを生み出す原動力となった。その後テスラ(Tesla)で自動運転向けAIシステムである「HW3」「Dojo」を開発した後、AMDのライバルであるインテル(Intel)で「SaphireRapids」のべースとなる技術を開発している。

そのテンストレントの日本法人であるテンストレント・ジャパンが設立されたのは2023年1月である。代表取締役社長には、クレイ・ジャパンの社長を2005〜2019年まで務め、直近ではAIコンピュータシステムを扱うグラフコア(Graphcore)の日本法人社長だった中野守氏が就任した。中野氏は「テンストレントはAIアクセラレータやRISC-VベースのCPU、チップレット技術などを手掛けているが、一言でまとめると『高性能を設計する企業(a high performance Design Company)』だ」と語る。なお、テンストレント・ジャパンのマネジメントには、中野氏とケラー氏の他、これまでNECパーソナルコンピュータのCEO兼社長を務め、現在はテンストレントのCCO(最高顧客責任者)であるデビット・ベネット(David Bennett)氏も加わっている。

「Tensix Core」を多数集積するAIアクセラレータ

テンストレントのプロダクトとしてはAIアクセラレータとRISC-VベースCPU、これらのプロダクトを効率良く半導体パッケージに集積するチップレット技術がある。

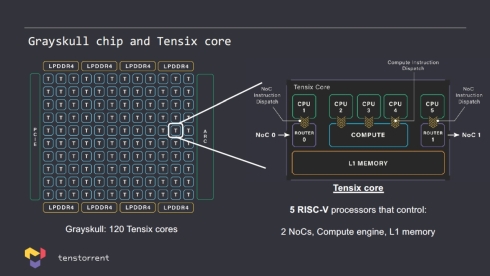

AIアクセラレータは、独自開発の「Tensix Core」を多数集積する技術が核になっている。Tensix Coreは、RISC-Vコアを5つ内蔵しており、これらのうち2つが他のTensix Coreとの通信を担うNoC(Network on Chip)の制御を担い、残りの3つでAI演算を行う「Compute Engine」を制御するという構成になっている。「条件分岐を適切に制御することでAI処理の疎結合が可能になり、GPUのように大規模でなくても高い計算処理性能が出せる」(中野氏)という。

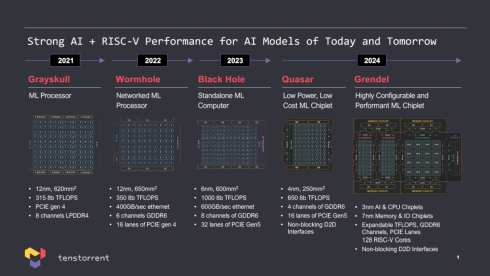

現在は、このTensix Coreを12nmプロセスで120コア集積した「Grayskull」を用いたPCI-Expressカードやワークステーションの他、同じく12nmプロセスの「Wormhole」で構成するサーバとAIクラウドなどを提案している。単体のAI処理性能はGrayskullが315TFLOPS、Wormholeが350TFLOPSだ。2023年後半には、次世代製品としてスタンドアロンのAIコンピュータ向けで6nmプロセスの「Blackhole」を投入する。2024年に向けて、低消費電力低コストの機械学習チップセットとなる4nmプロセスの「Quasar」、3nmプロセスでAIアクセラレータとRISC-V CPUをチップレットに集積する「Grendel」の開発を進めているところだ。

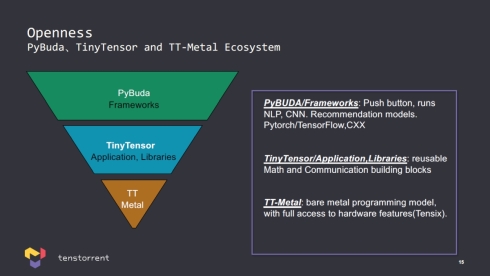

なお、AIアクセラレータを広く活用するためのエコシステムとして、フレームワークの「PyBuda」、アプリケーション/ライブラリの「TinyTensor」をオープンソースで公開している。さらに、NVIDIAのGPUにおけるCUDAに相当する、TensixのCompute Engineにアクセスするためのプログラミングモデルとして「TT-Metal」もオープンになっている。

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- 日本のロボット開発は「安全性」を優先、フィジカルAIも重視するが姿勢は慎重

- PCマウス原理でエレベーターの“ロープ”不要に AI保守を見据える日立HMAX戦略

- 物理世界と相互作用する「フィジカルAI」 AWSが語るロボット制御の進化とは

- CEATEC AWARDから6年越しの商品化、村田製作所の超音波デバイス「サーモホン」

- Astemoと日立が運転支援AI開発基盤構築の狙いを説明、「SDVのさらなる強化へ」

- 2035年のパワー半導体市場は7兆3495億円に倍増、酸化ガリウムが149億円規模に

- ボッシュとオモビオのソフト子会社が禁断のタッグ!? ADAS向けソフト基盤で協業

- 最新のBlackwellアーキテクチャを搭載した組み込みGPUシリーズを量産開始

- 中小FPGAベンダー盛衰記――QuickLogicからSilicon BlueそしてまたLatticeへ

- 車載小型モーター用マイコン統合型ドライバの新製品、サンプル出荷開始

コーナーリンク

テンストレント・ジャパンの中野守氏

テンストレント・ジャパンの中野守氏