企業が「責任あるAI」を実現するための4つのアプローチ:人工知能ニュース(2/2 ページ)

「責任あるAI」の実現は人間社会の問い直しにつながる

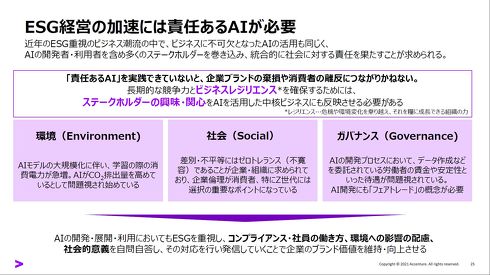

「ブランド」は企業ブランドのことだが、特に近年注目を集めるESG(Environment、Social、Governance)経営の観点から対策する必要もあるという。例えば、環境の観点からは、AIモデルの大規模化は学習時の電力消費量の急増、ひいてはCO2排出量の増大をもたらしかねない。社会の観点からはAIによる差別、偏見の助長が、ガバナンスの観点からはデータ作成委託先の従業員の賃金や雇用安定性などが懸念されている。

鈴木氏はこれらの課題を乗り越えるには、AIの開発、利用、展開において自社のコンプライアンスや環境への配慮、社会的意義などを自ら問い直し、対応を発信していく必要があると指摘する。

「ガバナンス」は、企業全体でAI戦略を実行するための体制構築である。鈴木氏はアクセンチュアが実施した調査を引用しつつ、「ビジネスリーダーの63%が『AIシステムのモニタリングは重要だが、その方法が分からない』と回答しており、また24%は『一貫性のない結果、透明性の欠如、偏った結果のために、AIシステムの全面的な見直しを余儀なくされている』と回答している。これらの結果は、部門単位でAIを管理するのではなく、全社的なガバナンス体制を構築して、全体最適化されたAI戦略を実施する必要性を示している」と指摘した。

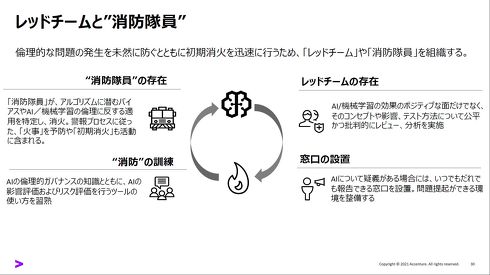

具体的な施策としては、倫理委員会の設置や経営トップのコミットメント強化、社内ステークホルダーに向けたAIガバナンス強化のためのトレーニング、レッドチームと“消防隊員”の設置、倫理指標の導入、問題提起しやすい環境の醸成などが挙げられる。なお、レッドチームと“消防隊員”とは、「レッドチームはセキュリティ分野の用語だが、AIのポジティブな面だけでなくネガティブな面も考慮して倫理的な問題の発生を事前に防ぐチームである。消防隊員は、問題という“火事”が起きた際の、火事の原因特定や適切な初期消火の方法を学び、実践するメンバーだ。これは訓練を受ければ、潜在的には従業員が誰でも担当できる」と鈴木氏は説明した。

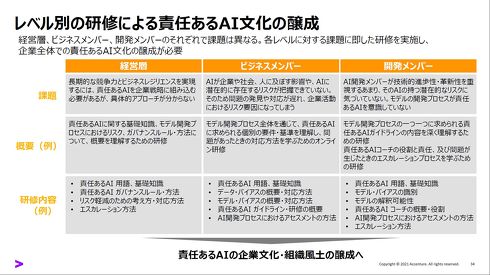

「組織・人材」は「責任あるAI」の開発に関する社内文化の醸成に関わる取り組みである。経営層、ビジネスメンバー、開発メンバーのそれぞれについて研修プログラムを用意することで、「責任あるAI」を実現しやすい社内文化醸成を目指す。

アクセンチュア AIグループ日本統括 AIセンター長 保科学世氏は「AIが人間から偏った考えを学ぶことは危険だ。しかし、人間の実社会を見ると、実際には社会的偏見やさまざまなところに存在している。この意味でAIは人間の世界を反映しているだけという言い方も可能であり、そうした仕方で考えると、『責任あるAI』をいかにして実現するかという問いは、そもそも人間の世界はどうあるべきかというより大きな問いにつながり得るのではないか」と指摘した。

関連記事

AIプロダクトの品質保証をAI技術で支援する、「AI4QA」という考え方

AIプロダクトの品質保証をAI技術で支援する、「AI4QA」という考え方

AIの社会的影響力が高まる中で、AIそれ自体の品質保証の重要が高まっている。品質保証を実現する上で重要になる考えとは何か。 日本初のAIプロダクト品質保証ガイドライン、QA4AIコンソーシアムが発行へ

日本初のAIプロダクト品質保証ガイドライン、QA4AIコンソーシアムが発行へ

QA4AI(AIプロダクト品質保証)コンソーシアムは「AIプロダクト品質保証ガイドライン 2019.05版」を策定した。2019年5月17日に東京都内で開催する「Open QA4AI conference 2019」に合わせて発行する予定だ。 AI活用製品の品質保証はどうすればいいのか、QA4AIコンソーシアムが発足

AI活用製品の品質保証はどうすればいいのか、QA4AIコンソーシアムが発足

AI技術を活用した製品の品質保証に関する調査/体系化、適用支援/応用、研究開発を推進する「AIプロダクト品質保証(QA4AI)コンソーシアム」が発足する。産学から24人の発起人と3つの組織/団体が名を連ねており、AI技術による製品の進化スピードを落とすなく、社会が安心してそれらの製品を利用できるようにしていくことは目指す。 AI製品の品質保証はどうする、日本初のガイドラインで品質と開発速度を両立せよ

AI製品の品質保証はどうする、日本初のガイドラインで品質と開発速度を両立せよ

AI技術を活用した製品の品質保証に関する調査/体系化、適用支援/応用、研究開発を推進するQA4AIコンソーシアムが、東京都内でイベント「Open QA4AI Conference」を開催。日本初となる「AIプロダクト品質保証ガイドライン」について、同コンソーシアム 運営委員長の西康晴氏が説明した。 AIに関する10の「よくある誤解」

AIに関する10の「よくある誤解」

ガートナー ジャパンは、AIに関する10の「よくある誤解」を発表した。AIへの関心が高まる中、「誰でもすぐにすごいことができる」などの誤解が増えていると指摘している。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

- 重要案件の見逃しを防いで見える化 OKIが実用化を目指すAIメール管理技術とは

コーナーリンク