MITとIBMが10年と250億円超をかけて研究する「Broad AI」は何ができるのか:人工知能ニュース(2/2 ページ)

ラボの研究開発テーマは4つの柱から成る

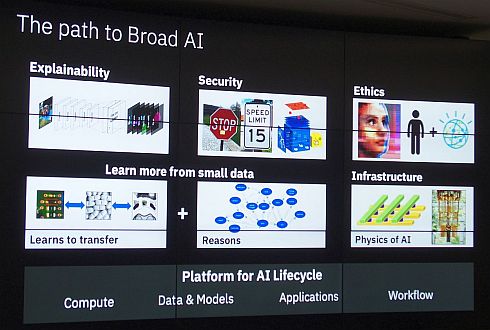

コックス氏は、Broad AIをどのように実現していくかについて説明した。「Broad AIはブラックボックスではダメで説明可能でなければならない。また、セキュアであることも重要。AIが人に作られたものである以上、人から攻撃され得るからだ。そして倫理的視点も必要であり、よる少ないデータによる学習も求められる。もちろんBroad AIを効率的に動かせるインフラも必要だ」(同氏)。

その上で研究開発は、「AI Algorithms」「Applications to Industries」「Physics of AI」「AI for Shared Prosperity」という4つのテーマを柱として進めている。

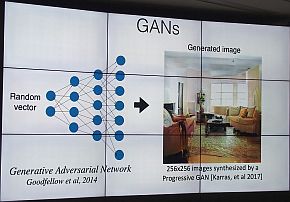

AI Algorithmsの研究事例として挙げたのが「The image generation challenge」だ。人間は、さまざまな写真や風景を基にして、この世には存在しない絵を描くことができる。2010年ごろから、AIにさまざまな画像データを与えて、新しい絵を描かせる取り組みを進めてきたが、2018年時点ではGAN(Generative Adversarial Networks:敵対的生成ネットワーク)を用いることでかなりリアルに描けるところまで来ているという。

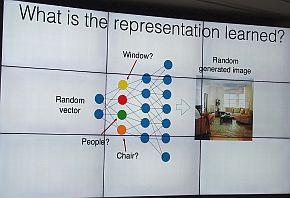

この研究事例で興味深いのは、進化するAIがその中で何をしているかが分かってきたことだ。コックス氏は「例えば部屋の絵を描くときに、窓やソファ、人の概念を作るのに特化したニューラルネットワークが存在することが分かった。このことを応用すれば、簡単に『窓をなくす』と指定するだけで、絵の中から窓を消せるようになる」と述べる。

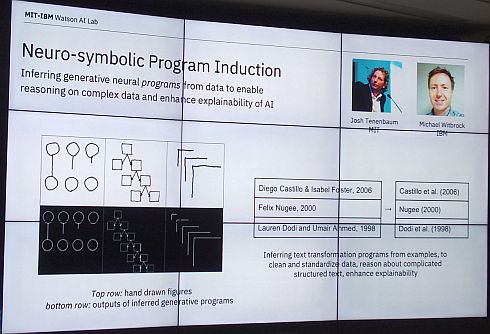

また「Neuro-symbolic Program Induction」では、現在のAI技術の中核であるニューラルネットワークと、それ以前にエキスパートシステムなどで中心的役割を果たしてきたシンボリックAIの融合を試みている。入力されたデータ配列の規則性を理解して、次のデータを自動で生成できるので、データサイエンティストの業務の8割以上を占めるデータの準備やフォーマット変換が不要になる可能性がある。

これらの他、説明可能なAIを実現するために「相関」ではなく「因果関係」を見られるようにする技術の開発も進めている。

Applications to Industriesで対象とする産業分野としては、セキュリティとヘルスケアがある。また2019年からは金融も加わる予定だ。

Physics of AIではBroad AIに求められるインフラの研究が行われている。例えば、次世代コンピューティング技術として期待されている量子コンピュータとAIの組み合わせだ。この研究プロジェクトには、量子コンピュータの研究で知られるMITのピーター・ショア(Peter Shor)氏が参画している。

AIに求められる要素とは

ギル氏は、記者からの質問に答える形で、AIに求められる要素について説明したので簡単に紹介したい。

まず「信頼できるAI」は4つの次元で担保されるとした。その4つの次元とは「公平性」「説明性」「堅牢性」「決定の履歴を持つこと」である。そして、AIの利用が広がるための要素は、4つの同心円から成るとした。中心には「高度なAI」があり、その外側に「信頼されるAI」と「AIの拡張性」がきて、そして外周には「ワークフローへの組み込み」がくるという。「AI導入がPoC(概念実証)から先になかなか進まないのは、信頼されておらず、ワークフローにも組み込まれていないからだ」(ギル氏)としている。

関連記事

AIと機械学習とディープラーニングは何が違うのか

AIと機械学習とディープラーニングは何が違うのか

技術開発の進展により加速度的に進化しているAI(人工知能)。このAIという言葉とともに語られているのが、機械学習やディープラーニングだ。AIと機械学習、そしてディープラーニングの違いとは何なのか。 機械学習はどうやって使うのか――意外と地道な積み重ね

機械学習はどうやって使うのか――意外と地道な積み重ね

前編では、AI(人工知能)と機械学習、ディープラーニングといった用語の説明から、AIを実現する技術の1つである機械学習が製造業を中心とした産業界にも徐々に使われ始めている話をした。後編では、機械学習を使ったデータ分析と予測モデル作成について説明する。 世界を変えるAI技術「ディープラーニング」が製造業にもたらすインパクト

世界を変えるAI技術「ディープラーニング」が製造業にもたらすインパクト

人工知能やディープラーニングといった言葉が注目を集めていますが、それはITの世界だけにとどまるものではなく、製造業においても導入・検討されています。製造業にとって人工知能やディープラーニングがどのようなインパクトをもたらすか、解説します。 9種の業界向け、学習済みのWatsonソリューションを発表

9種の業界向け、学習済みのWatsonソリューションを発表

IBMは、農業や人事、マーケティングなど、9種の業界と業種に合わせた、事前学習済みの新しいWatsonソリューションを発表した。 人工知能「Watson」の無期限試用が可能に、日本IBMがビジネス利用の拡大を強化

人工知能「Watson」の無期限試用が可能に、日本IBMがビジネス利用の拡大を強化

日本IBMは、AIの活用に関するユーザーイベント「AI Business Forum TOKYO」を開催し、同社が展開する人工知能「Watson」の価値と先進事例について紹介。同時に「Watson」を含むクラウドサービスを無期限で試用できる「IBM Cloud ライト・アカウント」の開始についても発表した。 製造業で人工知能はどう使うべきなのか

製造業で人工知能はどう使うべきなのか

日本IBMとソフトバンクは、自然対話型人工知能「ワトソン(Watson)」の日本語版の提供を開始する。自然言語分類や対話、検索およびランク付け、文書変換など6つのアプリケーションをサービスとして展開する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- DXで必須の「標準」とは誰のもの? Fit to Standardの意識のズレが招く停滞

- 重要案件の見逃しを防いで見える化 OKIが実用化を目指すAIメール管理技術とは

- 「日本は製造業のパワーハウス」、IFSが産業AI投資を急拡大する理由

- DXの本質はデジタルじゃない、カギは“競争力につながるデータ”

コーナーリンク