ルネサスがエッジAIで処理性能130TOPSを達成、高い電力効率でファンレス動作も:人工知能ニュース(1/2 ページ)

ルネサス エレクトロニクスは「ISSCC 2024」において、新たなAIアクセラレータやCPUなど各種IPとの協調動作によりリアルタイム処理を実現するヘテロジニアスアーキテクチャ技術を開発したと発表した。AI処理性能で130TOPSを実現し、電力効率でも世界トップレベルとなる23.9TOPS/Wを達成したという。

ルネサス エレクトロニクスは2024年2月22日、半導体技術の国際会議である「ISSCC(International Solid-State Circuits Conference) 2024」(2024年2月18〜22日、米国サンフランシスコ)において、新たなAI(人工知能)アクセラレータや、CPUなど各種IPとの協調動作によりリアルタイム処理を実現するヘテロジニアスアーキテクチャ技術を開発するとともに、これらの技術を搭載した組み込みAI-MPUを試作し、高速かつ低消費電力の動作が可能なことを実証したと発表した。従来技術のAIアクセラレータを用いる場合と比べてAI処理性能は最大16倍となる130TOPSを実現し、1W当たりのAI処理性能で表される電力効率についても「世界トップレベル」(同社)の最大23.9TOPS/W(0.8V動作時)を達成したという。

今回の開発成果は、枝刈り(Pruning)という技術で軽量化したAIモデルを効率良く処理するAIアクセラレータと、ロボット制御などで力を発揮するリアルタイム処理が可能なヘテロジニアスアーキテクチャ技術の2つから構成される。

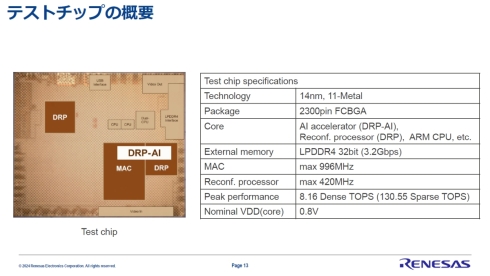

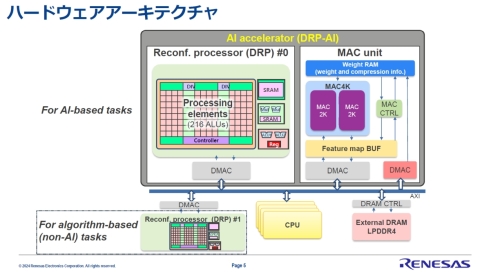

新技術のハードウェアアーキテクチャ。AI処理向けの「DRP-AI」と、リアルタイム処理が可能なヘテロジニアスアーキテクチャ技術向けの「DRP」から成る[クリックで拡大] 出所:ルネサス エレクトロニクス

新技術のハードウェアアーキテクチャ。AI処理向けの「DRP-AI」と、リアルタイム処理が可能なヘテロジニアスアーキテクチャ技術向けの「DRP」から成る[クリックで拡大] 出所:ルネサス エレクトロニクスルネサスはこれまでに、独自の動的再構成ハードウェアである「DRP(Dynamically Reconfigurable Processor)」をベースにした「DRP-AI」を開発し製品にも展開してきた。ただし、現場で利用される機器上でAIモデルの推論実行を行う「エッジAI」では、認識精度などに大きな影響を与えない範囲でAIモデルを軽量化することが一般的になっている。新開発のAIアクセラレータは、エッジAIにおけるAIモデル軽量化のトレンドに対応するため、浮動小数点演算ベースのAIモデルから8ビット固定小数点演算モデルへの量子化に対応するとともに、枝刈りによるAIモデルの大幅な軽量化にも対応できるようになっている。

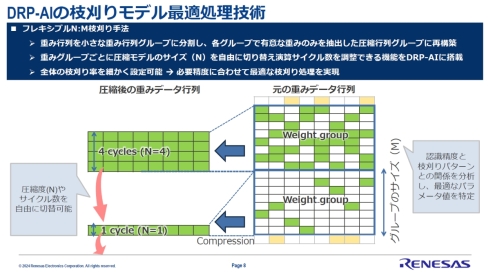

DRPとMAC(積和演算)ユニットから成るAIアクセラレータは、代表的な画像認識向けAIモデル(CNNモデル)における枝刈りパターンの特徴や枝刈り方式と認識精度との関係を分析し、高い認識精度と枝刈り率を両立可能なAIアクセラレータのハードウェア構造を特定して設計に反映した。さらに、このAIアクセラレータ向けに最適化したAIモデルを軽量化するソフトウェアも開発しており、不規則な枝刈りモデルの構成を高効率な並列演算処理に変換することによってAI処理の高速化が可能になったとする。

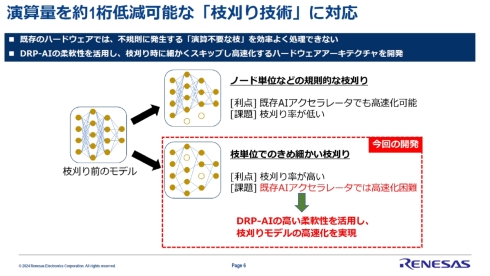

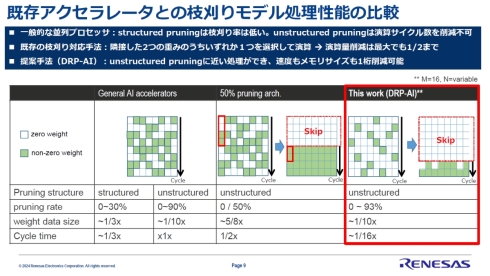

CPUやGPUなど並列処理プロセッサを用いる場合のAIモデルの枝刈りは、ノード単位など規則的な枝刈りとなってしまい、軽量化の比率が低いことが課題になっている。新開発のAIアクセラレータは、動的再構成が可能なDRPの特性を生かして、AIモデル内の局所的な枝刈り率の変化に応じて処理サイクル数を動的に切り替えることが可能な柔軟性の高い枝刈り対応技術(フレキシブルN:M枝刈り技術)を開発し、ユーザーが必要とする消費電力や動作速度、認識精度に応じた細かな枝刈り率の調整が可能になった。

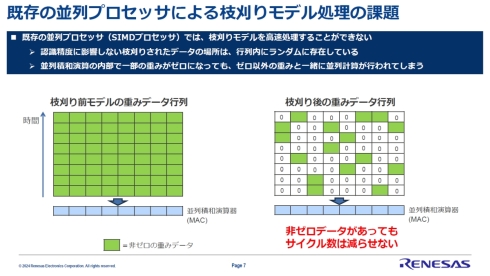

実際に、一般的な並列処理プロセッサではAIモデルのデータ容量は軽量化できるものの、AIモデル処理時の処理サイクル数は大幅に低減することは難しい。また、NVIDIAは「Ampere」世代のGPUアーキテクチャから、50%の枝刈りによって処理サイクル数を半減する「スパース化」という技術を採用しているものの、枝刈り率は50%で固定されており、ユーザー側で自由に調整することはできない。新開発のAIアクセラレータは、AIモデルの処理サイクル数を枝刈りモデル対応前と比較して16分の1まで削減するとともに、消費電力も最小で約8分の1以下にすることができるとともに、枝刈り率や処理サイクル数を消費電力や認識精度に合わせて調整することが可能だ。

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- 日本のロボット開発は「安全性」を優先、フィジカルAIも重視するが姿勢は慎重

- PCマウス原理でエレベーターの“ロープ”不要に AI保守を見据える日立HMAX戦略

- 物理世界と相互作用する「フィジカルAI」 AWSが語るロボット制御の進化とは

- CEATEC AWARDから6年越しの商品化、村田製作所の超音波デバイス「サーモホン」

- Astemoと日立が運転支援AI開発基盤構築の狙いを説明、「SDVのさらなる強化へ」

- 2035年のパワー半導体市場は7兆3495億円に倍増、酸化ガリウムが149億円規模に

- ボッシュとオモビオのソフト子会社が禁断のタッグ!? ADAS向けソフト基盤で協業

- 最新のBlackwellアーキテクチャを搭載した組み込みGPUシリーズを量産開始

- 中小FPGAベンダー盛衰記――QuickLogicからSilicon BlueそしてまたLatticeへ

- 車載小型モーター用マイコン統合型ドライバの新製品、サンプル出荷開始

コーナーリンク