パナソニックがAI倫理原則を発表、実践を後押しするチェックシステムも開発:人工知能ニュース(2/2 ページ)

AI倫理リスクチェックシステムが“必要十分な”チェックリストを生成

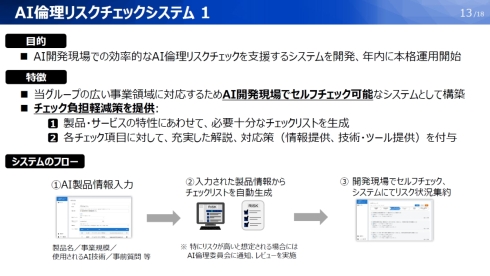

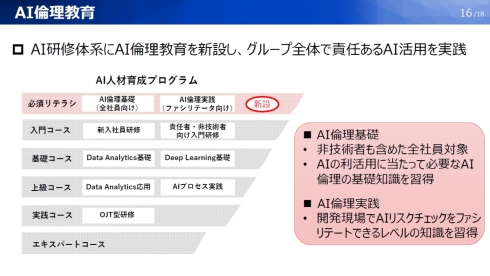

今回発表したAI倫理原則の実践を後押しするのが、2022年内の本格運用開始を見込む「AI倫理リスクチェックシステム」と、AI人材育成プログラムの中で2022年9月に開始する予定の「AI倫理基礎」と「AI倫理実践」だ。

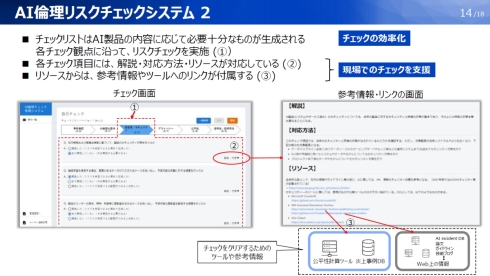

AI倫理リスクチェックシステムについては、AI倫理委員会で中央集権的に管理するのではなく、グループ各社のAI開発現場で効率的にAI倫理リスクチェックを支援するためのシステムとして開発が進められている。パナソニックHD テクノロジー本部 デジタル・AI技術センター 主任技師の丸山友朗氏は「チェック負担の軽減策として、製品やサービスの特性に合わせて“必要十分な”チェックリストを生成できるような仕組みを取り入れた」と強調する。また、各チェック項目に対して、充実した解説や対応策を用意しており、それらの情報提供からAI開発現場のリテラシー向上も期待できるとしている。

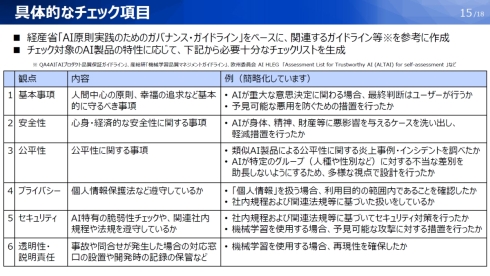

チェック項目は「基本事項」「安全性」「公平性」「プライバシー」「セキュリティ」「透明性・説明責任」があり、これら6項目のそれぞれで最大7つのチェックリストが用意されている。例えば、人をAIの対象としない外観検査向けのAIであれば、AI製品情報入力プロセスの事前質問でそのことを明示しておけば、人と関連するチェックリストが外されるので“必要十分な”チェックリストを生成できる。

AI人材育成プログラムのAI倫理基礎は、非技術者を含めた全社員向けとなっており国内だけでなく海外でも行う計画である。AI倫理実践は、開発現場でAIリスクチェックをファシリテートできるレベルの知識を習得できる内容となっている。

なお、パナソニックグループは2016年からAI人材の強化を進めており、2021年度末には2016年度比約3.8倍の1283人に増えた。各部署におけるAI開発の段階も、当初の「検討段階」や「人材育成」から「モデル開発」や「運用中」に移行しつつあるという。今後も、AI倫理基礎のような全社員向けのプログラムを含めてAI人材の強化を続け「毎年200人のペースでAI人材を増やしていきたい」(佐藤氏)としている。

関連記事

パナソニックが目指すAIの“使いこなし”とは

パナソニックが目指すAIの“使いこなし”とは

パナソニックがAI(人工知能)の活用に注力する姿勢を鮮明にしている。2017年4月に新設したビジネスイノベーション本部傘下のAIソリューションセンターは、AIの“使いこなし”を進めて、従来にない新たな事業の立ち上げも担当していく方針だ。同センター 戦略企画部 部長の井上昭彦氏に話を聞いた。 AIで実現するパナソニックの「ヨコパナ」、1000人のAI人材確保も着実に進む

AIで実現するパナソニックの「ヨコパナ」、1000人のAI人材確保も着実に進む

パナソニックがAI活用戦略について説明。AI開発の方向性「E3(イーキューブ)-AI」や、3+1の注力分野、AI相談の社内向けワンストップサービス「DAICC(ダイク)サービス」などについて紹介した。かねて発信している、2020年度までのAI人材1000人の確保に向けた取り組みも着実に進めているという。 パナソニックのエッジAI基盤「Vieureka」が独立分社、JVCケンウッドなどが出資

パナソニックのエッジAI基盤「Vieureka」が独立分社、JVCケンウッドなどが出資

パナソニック ホールディングス(パナソニックHD)、JVCケンウッド、米国ベンチャーキャピタルのWiLの3社は、パナソニックHDの研究開発部門の傘下で実績を積み重ねてきたエッジAIプラットフォーム「Vieureka(ビューレカ)」を提供する新会社「Vieureka株式会社」に共同出資すると発表した。 顔認証トップのパナソニックが動作予測AIコンテストに挑む、Facebookに肉薄

顔認証トップのパナソニックが動作予測AIコンテストに挑む、Facebookに肉薄

顔認証トップのパナソニックが、新たなAI技術分野に展開を図るべく、台所での動作認識や予測の精度を競うコンテスト「EPIC-KITCHENS-100」に参加。動作予測部門の23チームの中で、第1位のFAIR(Facebook AI Research)に次ぐ第2位の成績を収めた。 住空間データのImageNetとなるか、パナソニックがAIデータセットを公開する狙い

住空間データのImageNetとなるか、パナソニックがAIデータセットを公開する狙い

パナソニックは「CVPR2021」において2件のAI技術が採択されたと発表。このうち1件と関わる住空間向けデータセット「Home Action Genome」は、同社が独自に構築したもので、住空間向けでは従来にない大規模なデータセットであるにもかかわらず無償で公開されている。その狙いについて、パナソニック テクノロジー本部の担当者に聞いた。 外乱影響に惑わされないパナソニックの画像センシング技術、60年の歴史が裏打ち

外乱影響に惑わされないパナソニックの画像センシング技術、60年の歴史が裏打ち

パナソニック システムソリューションズ ジャパン(PSSJ)が「現場センシングソリューション」の一角を担う画像センシング技術の開発状況について説明。監視カメラの開発から60年以上の歴史を積み重ねてきた同技術を基に、今後はディープラーニング技術との組み合わせによって、より幅広い分野への展開を目指す方針だ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

- 重要案件の見逃しを防いで見える化 OKIが実用化を目指すAIメール管理技術とは

コーナーリンク