ディープラーニングの学習データ量を削減、「敵対的特徴」の活用で:人工知能ニュース

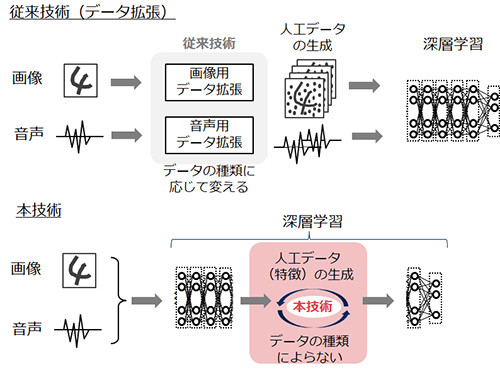

NECは2019年8月19日、ディープラーニングの学習に必要なデータ量を削減する新たな技術を開発したと発表した。同技術は画像や音声などデータ形式によらず適応でき、学習データセットの拡張を専門家による調整なしに実現するとしている。

NECは2019年8月19日、ディープラーニングの学習に必要なデータ量を削減する新たな技術を開発したと発表した。同技術は画像や音声などデータ形式によらず適応でき、学習データセットの拡張を専門家による調整なしに実現するとしている。

製品の外観検査など、製造業においてもディープラーニング活用が進む。ディープラーニングの推論精度は学習用データセットの質と規模に依存するが、高品位なデータセットの用意は手間やコスト面で高いハードルが存在する。外観検査の例においても不良品の画像データを多数そろえる必要があるが、そもそも発生頻度の低い不良でデータ収集が困難な場合が多い。この問題を解決するため、他領域で学習したニューラルネットワークを転用する「転移学習」や、元の学習データを人為的に加工し学習用データセットへ加える「データ拡張」などの手法に注目が集まっている。

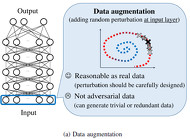

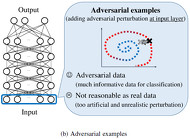

一方で、データ拡張は専門家による調整を必要とするため、多種のデータに短期間に適用することは困難だった。また、分類器モデルの学習を行う場合、決定境界に近い学習データを多く収集することで効率的に推論精度を向上できる。しかし、十分に調整されていないデータ拡張は、モデルの推論精度向上に有益でない些細な学習データを水増しする場合がある。

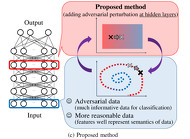

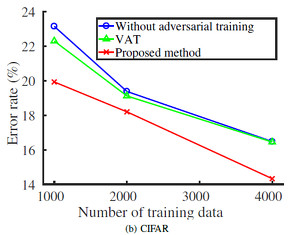

同技術は、元の学習データとニューラルネットワークの隠れ層から算出した「敵対的特徴(Adversarial feature)」を用いてモデルの学習を行う。敵対的特徴は学習中にネットワークを正則化し、モデルの過学習を防ぐ役割がある。半教師あり学習の「VAT(Virtual Adversarial Training)」も同様に、「敵対的サンプル(Adversarial example)」によってネットワークを正則化するが、NECの提案手法では実データとの合理性を保つため、学習データの線形結合によって表現されるよう敵対的特徴を規定したとする。

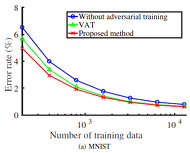

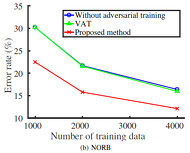

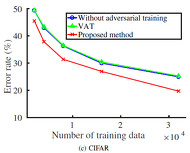

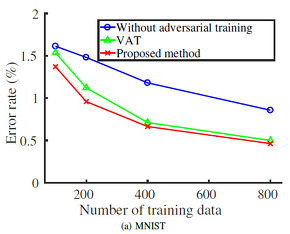

提案手法を敵対的学習なしやVATと比較評価したところ、提案手法が少ないデータセットにおいても良好な推論精度を確保している結果となった。また、転移学習と組み合わせた場合においても、同様に提案手法が最も良い結果となっている。

今後、同技術をリカレントニューラルネットワークやメモリネットワークなどより複雑な構造のネットワークに適応することを目指す。今回の成果は、ニューラルネットワークの国際会議「International Joint Conference on Neural Networks」(2019年7月14〜19日、ハンガリー・ブダペスト)で発表された。

関連記事

“プロセッサ”を開発する東芝メモリ、その技術と狙い

“プロセッサ”を開発する東芝メモリ、その技術と狙い

東芝メモリがプロセッサの開発を発表した。現業から離れているように見えるプロセッサの開発を通じて東芝メモリは何を目指すのか。今回発表された技術の概要と開発の狙いを聞いた。 低コストFPGAで深層学習、コア技術をオープンソース化したベンチャーの狙い

低コストFPGAで深層学習、コア技術をオープンソース化したベンチャーの狙い

LeapMindは2018年10月19日、組み込み向けFPGA上でディープラーニングを動作させるソフトウェアスタックをオープンソースで公開した。同社が今まで強みとしてきた技術が、誰でも利用もできるようになった。同社CTO(最高技術責任者)を務める徳永拓之氏に、blueoilとはどのようなもので、何が実現できるのか。そして、オープンソース化した狙いなどを聞いた。 深層学習AIをエッジで動かす、東芝と理研がスパース化現象でパラメータ8割削減

深層学習AIをエッジで動かす、東芝と理研がスパース化現象でパラメータ8割削減

東芝と理化学研究所が、深層学習(ディープラーニング)によって得られるAI(人工知能)である「深層ニューラルネットワーク(DNN)」のコンパクト化技術を開発。DNNの性能を維持したままで、学習した結果であるパラメータを80%削減できる。 ディープラーニング技術を用いて部品の検品を自動化する実証実験

ディープラーニング技術を用いて部品の検品を自動化する実証実験

ABEJAが武蔵精密工業と協業し、ディープラーニング技術を用いて四輪車用部品の検品を自動化する実証実験を実施した。その結果、自動化は難しいとされてきた検品工程において、目視による検品と同等の精度を持つ学習済みモデルを構築できた。 組み込みAIは必要不可欠な技術へ、推論に加えて学習も視野に

組み込みAIは必要不可欠な技術へ、推論に加えて学習も視野に

2017年初時点では芽吹きつつあった程度の組み込みAI。今や大きな幹にまで成長しつつあり、2019年からは、組み込み機器を開発する上で組み込みAIは当たり前の存在になっていきそうだ。 AIと機械学習とディープラーニングは何が違うのか

AIと機械学習とディープラーニングは何が違うのか

技術開発の進展により加速度的に進化しているAI(人工知能)。このAIという言葉とともに語られているのが、機械学習やディープラーニングだ。AIと機械学習、そしてディープラーニングの違いとは何なのか。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- CEATEC AWARDから6年越しの商品化、村田製作所の超音波デバイス「サーモホン」

- PCマウス原理でエレベーターの“ロープ”不要に AI保守を見据える日立HMAX戦略

- 物理世界と相互作用する「フィジカルAI」 AWSが語るロボット制御の進化とは

- Astemoと日立が運転支援AI開発基盤構築の狙いを説明、「SDVのさらなる強化へ」

- 日本のロボット開発は「安全性」を優先、フィジカルAIも重視するが姿勢は慎重

- ボッシュとオモビオのソフト子会社が禁断のタッグ!? ADAS向けソフト基盤で協業

- 中小FPGAベンダー盛衰記――QuickLogicからSilicon BlueそしてまたLatticeへ

- 車載小型モーター用マイコン統合型ドライバの新製品、サンプル出荷開始

- 2035年のパワー半導体市場は7兆3495億円に倍増、酸化ガリウムが149億円規模に

- レノボ、ニデックらが結集 AIインフラ熱問題に向けた水冷検証拠点を開設

コーナーリンク