日本語版の医療特化LLM基盤を開発、医師国家試験ベンチマークで最高性能:医療機器ニュース

ELYZAは、日本語版の医療LLM基盤「ELYZA-LLM-Med」シリーズを開発した。汎用モデルは国内最高性能、現場の医療タスクではグローバルトップ水準を超える精度を達成している。

ELYZAは2025年7月14日、日本語版の医療LLM(大規模言語モデル)基盤「ELYZA-LLM-Med」シリーズを開発したと発表した。汎用モデルは国内最高性能、現場の医療タスクではグローバルトップ水準を超える精度を達成している。

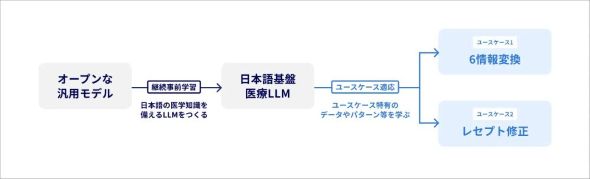

研究では、まず各ユースケースの基盤となる日本語版汎用医療LLMを開発。これをベースに、各ユースケースを解くための日本語版汎用医療LLMの適合に向けたモデルを開発した。なお、共通部分はあらかじめ学習させており、継続事前学習により高性能なモデルを今後も効率的に作成し続けることができる。

基盤となる「ELYZA-Med-Base-1.0-Qwen2.5-72B」は、海外製のオープンモデル「Qwen2.5-72B-Instruct」をベースとし、複数の医療関連コーパスを用いた継続事前学習を実施した。これに追加で事後学習し、「電子カルテ標準化のための情報変換」(UC1)と、「レセプト(診療報酬明細書)の確認修正内容の提案」(UC2)に適合するモデルを開発した。

各モデルの有効性を検証したところ、基盤モデルでは医師国家試験ベンチマーク「IgakuQA」において、国内最高性能を達成した。

またUC1は、OpenAIの「o1(2024-12-17)」を超える性能を達成。UC2では、「修正要否の精度」「コメントの質」において、OpenAIの「gpt-4o(2024-11-20)」をクリアした。

今後は、特定領域に特化したLLMソリューションを順次展開する。同研究は、内閣府の「戦略的イノベーション創造プログラム(SIP:エスアイピー)」の支援を受けて実施したもので、プロジェクトはさくらインターネット、東京大学、ABEJAらと共同で実施した。

関連記事

人工甘味料が大腸炎を悪化させるメカニズムを解明

人工甘味料が大腸炎を悪化させるメカニズムを解明

慶應義塾大学は、人工甘味料として広く使用される糖アルコールのソルビトール摂取により、腸内細菌叢およびその代謝物を介した腸管の炎症性免疫応答性が活性化し、大腸炎が悪化することを明らかにした。 立ったまま寝る仮眠ボックスの販売を拡大

立ったまま寝る仮眠ボックスの販売を拡大

イトーキは、立ったまま寝る仮眠ボックス「giraffenap」の販売を開始した。同社が所有する、仮眠ボックスに関する開放特許「人体収納用構造体及び睡眠用筐体」を基に製品化したものとなる。 オリンパスが内視鏡手術ロボット開発へ、米国で投資会社と新会社を設立

オリンパスが内視鏡手術ロボット開発へ、米国で投資会社と新会社を設立

オリンパスは、エンドルミナルロボティクスの開発を加速するため、米国の医療業界特化の投資会社であるリバイバルと契約を締結したと発表した。両社は同契約に基づき、米国に新会社「スワン・エンドサージカル(Swan EndoSurgical)」を共同で設立する。 リニューアルした血糖測定システムの販売を開始

リニューアルした血糖測定システムの販売を開始

テルモは、リニューアルした血糖測定システム「メディセーフフィットスマイル」の販売を開始した。操作フローや画面表示などを改良している。 OKIとエフィニックスが提携 低電力FPGAを設計から量産までワンストップで提供へ

OKIとエフィニックスが提携 低電力FPGAを設計から量産までワンストップで提供へ

OKIとエフィニックスは業務提携を行い、FPGAの論理回路や搭載AI機器の設計から量産までをワンストップで受託するEMSサービスを展開すると発表した。 カカオの有効成分がスポーツ時の判断力を向上させる

カカオの有効成分がスポーツ時の判断力を向上させる

早稲田大学らは、カカオの有効成分ココアフラバノールを高用量含んだサプリメントを摂取することで、認知疲労下の運動中の判断力が向上することを明らかにした。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

医療機器の記事ランキング

- 脳動脈瘤の治療をより安全に テルモが細径対応の新デバイス発売

- 約10秒で検温完了 ケースごと丸洗い可能なテルモの新型体温計

- 厚さ約25μmの神経シートを開発、光刺激と記録を同時に実現

- 知人より見知らぬ他人とシンクロ? スポーツ観戦の熱狂を科学的に解明

- 生きた乳酸菌は代謝、死んだ乳酸菌は免疫へ 状態で異なる腸内効果

- 日立ら肺がん細胞診の新解析技術 SEMと元素分析で検体評価を支援

- あなたの「網膜」は実年齢より老けている? 写真1枚でAIが疾患リスクを推定

- 50万人の情報が流出した英国バイオバンクのインシデントでPETs利用は拡大するか

- がんの微小病変解析をより正確に、1台で核酸抽出から定量を自動処理する装置

- 猛暑の夏を乗り切る! 冷却性能20%増の首元デバイスで−2℃体験へ

コーナーリンク

![キャプション UC1(電子カルテ標準化のための情報変換)の精度比較[クリックで拡大] 出所:ELYZA](https://image.itmedia.co.jp/mn/articles/2507/31/mn_medical_25071801c.jpg)