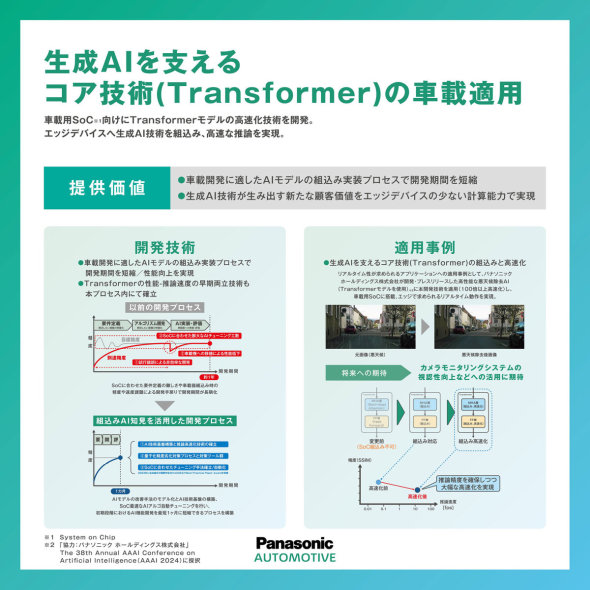

車載SoCでトランスフォーマーを推論実行、パナソニックオートが100倍に高速化:EdgeTech+ 2024

パナソニック オートモーティブシステムズは、「EdgeTech+ 2024」において、トランスフォーマーをベースにしたAIモデルを車載SoCで高速に処理する技術を披露した。雨や霧などの悪天候の影響をカメラ画像から除去するAI処理について、同技術の適用前と比べて約100倍の高速化を実現したという。

パナソニック オートモーティブシステムズは、「EdgeTech+ 2024」(2024年11月20〜22日、パシフィコ横浜)において、生成AI(人工知能)の主要構成要素であるトランスフォーマーをベースにした推論モデルを車載SoCで高速に実行する技術を披露した。雨や霧などの悪天候の影響をカメラ画像から除去するAI処理について、同技術の適用前と比べて約100倍の高速化を実現し、自動車操作系システムの要件で求められる10fpsを達成している。

展示では、悪天候下で走行中の車両前方のカメラ映像をディスプレイに表示した上で、この映像をカメラで撮影してトランスフォーマーベースのAIモデルの推論実行を行い、ほぼリアルタイムで雨や霧などの悪天候の影響をカメラ画像から除去するデモンストレーションを披露した。AIモデルの推論実行は、AI処理性能が約1TOPSとなるクアルコムの車載SoC「SA8155」を用いている。

そもそもこのトランスフォーマーベースのAIモデルは、パラメーター数などの関係でそのまま車載SoCに組み込むことができない。そこでまずは、車載SoCに合わせてパラメーター数を最適化するとともに、AIモデルの軽量化で一般的に用いられる枝刈りや量子化などの技術も適用して組み込み可能な状態にした。推論精度は90%以上を確保したものの、画像を1枚処理するのに10秒以上かかるため(0.1fps以下)、自動車操作に対応するリアルタイム性はない。

ここからさらに高速化するために、トランスフォーマーモデルの処理で多く行われる3次元から4次元、4次元から3次元などの次元変換を極力減らすような最適化を施した。これによって、10fps以上の高速化を実現している。

なお、これまで車載開発に適したAIモデルの開発には約1年を要していたが、今回の高速化技術開発と併せて、要件定義やアルゴリズム開発、AIの実装/評価にかかる期間を短縮し最短1カ月で開発を完了できるような体制も構築したとする。

同社の説明員は「車載SoC上で他の処理を行うことも考えると、20〜30fpsくらいまで性能を向上する必要がある。ただ、今後の車載SoCのAI処理性能が大きく伸びていくことを考慮すると十分達成できるだろう。開発した技術は今後3〜5年で実用化につなげたい」と述べている。

関連記事

エッジであれエンドポイントであれ今こそ現場にAIを実装すべし

エッジであれエンドポイントであれ今こそ現場にAIを実装すべし

2023年に大きな注目を集めた生成AIは、膨大なパラメータ数とあいまってAIモデルをクラウド上で運用することが一般的だ。2024年は、AIモデルを現場側に実装するエッジAIやエンドポイントAIを活用するための技術が広く利用できるようになるタイミングになりそうだ。 “エッジ生成AI”に挑む日本発スタートアップ、60TOPSのAI処理性能を8Wで実現

“エッジ生成AI”に挑む日本発スタートアップ、60TOPSのAI処理性能を8Wで実現

生成AIへの注目が集まる中、その生成AIを現場側であるエッジデバイスで動かせるようにしたいというニーズも生まれつつある。この“エッジ生成AI”を可能にするAIアクセラレータとして最大AI処理性能60TOPS、消費電力8Wの「SAKURA-II」を発表したのが、日本発のスタートアップであるエッジコーティックスだ。 RAGとの組み合わせでエッジ生成AIを可能に、NXPがAI開発ソフトに新機能

RAGとの組み合わせでエッジ生成AIを可能に、NXPがAI開発ソフトに新機能

NXPジャパンが無償で提供しているAI/機械学習開発ソフトウェア「eIQ AIソフトウェア」の最新アップデートについて説明。時系列データを基にエッジ機器向けのAIモデルを構築する「eIQ Time Series Studio」と、生成AIのカスタマイズ手法の一つである「RAG」の作成を行える「eIQ GenAIフロー」という2つのエッジAI機能を新たに追加する。 エッジAIで生成AIとのコミュニケーションを円滑に、シャープの「CE-LLM」

エッジAIで生成AIとのコミュニケーションを円滑に、シャープの「CE-LLM」

シャープは、技術展示イベント「SHARP Tech-Day'24」において、開発中のエッジAI技術「CE-LLM」の搭載により生成AIとの自然なコミュニケーションを可能にするウェアラブルデバイス「AIスマートリンク」を披露した。 ソニーセミコンがエッジAIを物流業界に提案、トラックの荷待ち時間管理を自動化

ソニーセミコンがエッジAIを物流業界に提案、トラックの荷待ち時間管理を自動化

ソニーセミコンダクタソリューションズは、「国際物流総合展2024」において、エッジAIセンシングプラットフォーム「AITRIOS(アイトリオス)」を用いた物流業界向けソリューションを紹介した。 LLMを活用したエッジAI向け画像解析ソリューションを提供

LLMを活用したエッジAI向け画像解析ソリューションを提供

Ideinは、エッジAIプラットフォーム「Actcast」とマルチモーダルLLMを連携した画像解析ソリューション「LLM App on Actcast」の提供を開始した。エッジAI導入時のPoCを容易に実施できる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

組み込み開発の記事ランキング

- CEATEC AWARDから6年越しの商品化、村田製作所の超音波デバイス「サーモホン」

- 中小FPGAベンダー盛衰記――QuickLogicからSilicon BlueそしてまたLatticeへ

- PCマウス原理でエレベーターの“ロープ”不要に AI保守を見据える日立HMAX戦略

- 物理世界と相互作用する「フィジカルAI」 AWSが語るロボット制御の進化とは

- Astemoと日立が運転支援AI開発基盤構築の狙いを説明、「SDVのさらなる強化へ」

- 日本のロボット開発は「安全性」を優先、フィジカルAIも重視するが姿勢は慎重

- レノボ、ニデックらが結集 AIインフラ熱問題に向けた水冷検証拠点を開設

- ボッシュとオモビオのソフト子会社が禁断のタッグ!? ADAS向けソフト基盤で協業

- 車載小型モーター用マイコン統合型ドライバの新製品、サンプル出荷開始

- 2035年のパワー半導体市場は7兆3495億円に倍増、酸化ガリウムが149億円規模に

コーナーリンク