カメラとLiDARをピクセルレベルで統合処理、自動運転の高度化に貢献:自動運転技術(2/2 ページ)

また、岡田氏は「視差を合わせ込むことはセンサーフュージョンのレベルを上げていく過程で避けて通れない課題だ」と説明する。「カメラが影などのテクスチャーを“物体がある”と認識し、LiDARでは何も物体が見つかっていない場合、LiDARの検知結果を優先して走らなければならない。今後、より高度な自動運転をやっていく上では、LiDARでなければ物体が認識できないケースが出てくるのではないか。そこで高度なセンサーフュージョンが要求される。LiDARを使う業界に向けて、それを解決できるコンセプトを持っていることを訴求していきたい」(岡田氏)

こうした背景の下、京セラはLiDARとカメラのローデータでのセンサーフュージョンに力を入れてきた。ただ、カメラとLiDARの視差を踏まえてキャリブレーションと高頻度なメンテナンスを行う必要があった。また、オフラインでデータを重畳しなければならないという課題もあり、実用的とはいえない技術だった。

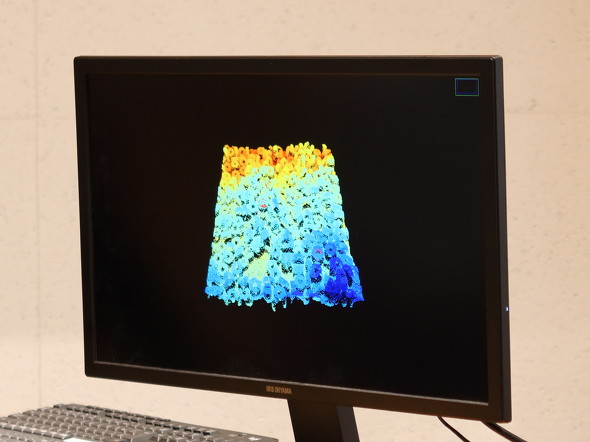

そこで、京セラのカメラLiDARフュージョンセンサはカメラとLiDARの視差がないリアルタイムなデータ統合を実現することを目指した。また、キャリブレーション不要でメンテナンスフリーであることも重視した。カメラとLiDARは1つのユニットに収めて光軸を一致させたことでセンサーフュージョンの処理プロセスが容易になり、遅延なくカメラの画像データとLiDARの距離データを統合することが可能になった。

これまでステレオカメラでは検知できなかったものに対応

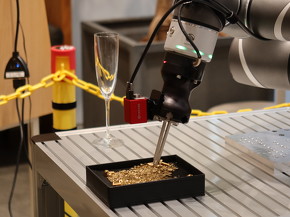

AI測距カメラは、レンズを2つ搭載したステレオカメラ方式で、物体までの距離10cmで計測誤差0.1mmの高精度な距離測定を実現する。

大きさ1mm程度の小さな物体だけでなく、ステレオカメラでは測距が難しかった樹脂などの半透明なものや金属など光沢があるものにも対応しており、ロボットハンドと組み合わせることで、「これまで自動化が難しかった領域の自動化が可能になる」(京セラ 研究開発本部 先進技術研究所 第2基盤技術ラボ コンピュータビジョン研究課責任者の林佑介氏)としている。

開発品は1つのイメージセンサーに2つのレンズを搭載し、レンズ間の距離を大きく狭めた超狭基線長の構成とすることで、左右のレンズの視差をより近距離でも検知でき、極小物体の大きさも正確に計測できるようにした。1つのイメージセンサーに2つのレンズを搭載する構成に合わせたキャリブレーション手法も構築した。

さらに、AIのステレオビジョンアルゴリズムにより、距離計測の精度を単眼カメラと比べて10倍に高めている。データ収集の負担を低減するCGによる学習データ生成技術と、正解データが不要な事前学習技術により、AIの学習コストを抑えた。正解データを必要としない事前学習技術は、中部大学との共同開発によって改良。また、新規性や有効性が評価され、論文が国際会議BMVC2024(The 35th British Machine Vision Conference)で採択された。

AI測距カメラは、時計の内部のような小さい部品を取り扱う製造現場での部品ピッキング作業の自動化、医療現場における金属製の器具の取り扱い、物流現場などでの搬送ロボットなどの用途を見込んでいる。まずは2025年4月から京セラ社内で活用し、2026年から外販する。

関連記事

京セラがヘッドランプ用半導体レーザー、ランプのLiDAR化や可視光無線通信も視野

京セラがヘッドランプ用半導体レーザー、ランプのLiDAR化や可視光無線通信も視野

京セラは、「人とくるまのテクノロジー展 2022 YOKOHAMA」(2022年5月25〜27日、パシフィコ横浜)において、自動車のヘッドランプや照明などに向けた半導体レーザーを展示した。半導体レーザーを活用して、ヘッドランプにセンサーとしての機能を持たせたり、ヘッドランプの光による通信機能を実現したりしていく。 京セラが自動運転向けライダー、メカレスで分解能はヴェロダイン並み

京セラが自動運転向けライダー、メカレスで分解能はヴェロダイン並み

京セラは「人とくるまのテクノロジー展2018」において、Velodyne(ヴェロダイン)に匹敵する分解能を達成したライダー(LiDAR:Light Detection and Ranging)を参考出品した。 LiDARから中核のECUまで、トヨタのハンズオフを支えるデンソー製品

LiDARから中核のECUまで、トヨタのハンズオフを支えるデンソー製品

デンソーは2021年4月9日、トヨタ自動車の高度運転支援技術の新機能「Advanced Drive」で採用された製品を発表した。Advanced Driveはレクサスブランドのフラグシップセダン「LS」と燃料電池車(FCV)「MIRAI(ミライ)」に搭載される。ドライバーは周辺を常時監視する必要があり、分類上はレベル2の自動運転に該当する。 日産がLiDAR採用の運転支援技術、2段階の衝突回避で複雑な場面に対応

日産がLiDAR採用の運転支援技術、2段階の衝突回避で複雑な場面に対応

日産自動車は2022年4月25日、障害物や車両との衝突を緊急回避するための次世代センシング技術を発表した。障害物を操舵アシストで回避した後に歩行者を検知してブレーキを制御するというように、2段階での緊急回避を実現する。この運転支援技術「グラウンド・トゥルース・パーセプション」は技術開発を2020年代半ばまでに完了させ、新型車に順次搭載する。 ホンダのレベル3の自動運転は限定100台、「しっかり使ってもらってフィードバックを得る」

ホンダのレベル3の自動運転は限定100台、「しっかり使ってもらってフィードバックを得る」

ホンダは2021年3月4日、フラグシップセダン「レジェンド」にレベル3の自動運転を含む高度な運転支援システム「Honda SENSING Elite(ホンダセンシングエリート)」を搭載して3月5日からリース販売すると発表した。100台の限定生産で、当面は増産や販売拡大の計画はない。税込みメーカー希望小売価格は1100万円(既存モデルは724万9000円)。 自動運転技術は低速域でも着実に進化、ホンダが道の駅で実証

自動運転技術は低速域でも着実に進化、ホンダが道の駅で実証

本田技術研究所はアグリサイエンスバレー常総において、一般の訪問者を対象にした自動走行技術の実証実験を開始する。 全固体電池やLiDAR……自動車メーカーがコストよりも「足りない性能」に言及するとき

全固体電池やLiDAR……自動車メーカーがコストよりも「足りない性能」に言及するとき

土曜日ですね。昨日からお休みの方、5月8日まで休みで10連休だという方、「みんなが休みのときこそ仕事」という方、皆さまおつかれさまです。連休直前や連休明けに稼働停止という自動車メーカーがあり、気をもんでいる方も多いかもしれません。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

モビリティの記事ランキング

- 新型「bZ4X」の走行距離が伸びた理由、デンソーの「世界初」と「世界最高」が貢献

- ギガキャストを発案したテスラの現在・過去・未来

- ECUの一体化で進化したトヨタの「新型TSS」 RAV4の安全走行を支える技術とは

- スズキ、排出ガス中のCO2を回収し農場で再利用できる「スーパーキャリイ」披露

- SDV時代には「製品開発スピード」だけでなく「製品発見スピード」も求められる

- デンソー新型SiCなど世界初公開23件! 「人テク展」が映す自動車技術の現在地

- 6kWの普通充電に対応 ホンダの“風になれる”EVバイク「WN7」は日本展開も視野に

- コマツが次世代月面物流ローバーの研究開発を開始

- どこへでも移動可能な自由を── ランドクルーザーの新型車「FJ」シリーズが登場

- 「新興勢力に圧倒的に劣っている」――ホンダは開発を根本から変えられるか

コーナーリンク