コロナ禍で加速するライブ中継の革新、ソニーのスイッチャーはなぜクラウド化したのか:小寺信良が見た革新製品の舞台裏(19)(2/4 ページ)

ハードウェアからソフトウェアになるとオペレーションはどうなるのか

―― 御社は以前からIP伝送を使った映像制作ソリューションを展開してきました。ただIP伝送の先にはハードウェアがあったわけです。今回は全部をクラウド上でやってしまうということでは、またメリットが違うように思えますが。

小貝 クラウドで全部やれるとなると、機材のセッティングという観点でそこの時間が大幅に短縮されます。従来のSDIと呼ばれる映像ケーブルによる接続では、一番大型のスイッチャーですと入出力で合計120本のケーブルが行き来するということになってました。そこがIPになって、30本まで大きく減らせるところまで来ました。それでもやっぱり現場でIPをやると、ケーブルを差さなければいけない。

さらにそれがクラウドになると、カメラ自身がワイヤレスでクラウドにつながり、その場ですぐに中継制作ができるところは、いろいろなお客さまともPoC(概念実証)をやって、われわれが横で見ててもかなりエポックメイキングというか。今まではケーブルを差し間違えて絵が来ないといったような部分がインスタントにつながるというのは大きな革新ですね。

―― これまでハードウェアベースでやってきたオペレーションが全てソフトウェアになると、オペレーションのやり方も変わっていくということでしょうか。

小貝 お客さまが実際映像制作をされるユーザーインタフェースというのは、これまでとほぼ同じです。従来ハードウェアのコントロールパネルでオペレーションしていたものが、そのままGUI上でタッチパネルやマウスを使って操作をしていただくということになっていますので。

―― セッティングが全てクラウドになってくると、これまでケーブリングでシステムをセットアップしてきた映像エンジニアも、今度はもっとIPが分かる人を連れてこないといけないということでしょうか。

前川 映像を撮りに行く現場にはどうしてもカメラが必要になるので、カメラを扱う映像エンジニアはそのまま残ると思います。その後のスイッチャーについては、われわれがやろうとしているSaaSモデルであればソニー側で全部面倒を見ますので、単純につなげばいいということで、IPやITのスキルがなくても問題ないです。

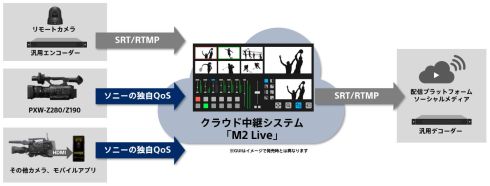

小貝 M2 Liveでカメラ側で入力するのって、URLみたいなものとポート番号、ID/パスワードくらいっていう、その程度なんです。最近はYouTubeLiveでライブ配信される方も増えてますのでお分かりになると思うんですけど、そうした配信で行う設定項目とほぼ変わらないものをカメラマンに入力していただくだけということになっています。

染谷 ソニーの機材につないでいただく場合は、その辺のサポート機能も入っておりますので、結構簡単につなげていただけると思います。一方、汎用機材を使う場合は、今言ったように本当にYouTubeLiveにつなぐような程度の入力で、後の接続は全部クラウド上でやります。それもリモートでやれますので、現場でやることはそんなにないと思っています。

「リアルタイム」と「時間のズレ」との戦い

―― 現場で撮影した「ファイル」をクラウドに送るところから、とうとうライブの映像をそのままリアルタイムでコンテンツにしていくところまで、時間が短縮されてきました。なぜこれほどまでに、ライブが注目されるようになってきたんでしょう。

小貝 最近感じるのは「みんなと共感したい」っていうのが、世の中の流れとして大きくあると思います。みんなと共感するには、必然的にやっぱり同じ物を同じタイミングで見ているっていう状況が重要で。昔は、実際にその現場に行って盛り上がるっていうことしかできなかったのが、インターネットの進化、通信技術の進化で、離れた場所でもできるようになった。やっぱり同じタイミングで盛り上がりたいっていう根本的な要求が、ライブへの重要性をもたらしているのかなと思いますね。

前川 今はいつでも人と人がつながっていますよね。スマホを1台持っていればすぐに情報も取れたり、逆にそこから発信できたり。そういうのに慣れてくると、すごく時間をかけてクオリティーの高いコンテンツを作ってそれを楽しむっていうところから、クオリティーはちょっと落ちてても即時性があるというのに対しての喜びというか期待感が増えてきているようなイメージを持っていますね。

―― そういう意味では、ちょっと前までは1本のライブストリームをネットに出すために、LTE回線を数本束ねたリュックを背負って中継に挑むような状況でした。それがあっという間にスマホ1つでアップロード、となったのはある意味衝撃的なんですけれども、それはやはり5Gが前提になっているというところなんでしょうか。

小貝 われわれの構想のきっかけとして5Gがあったことは否定しません。5Gの大容量、低遅延という特徴は大きく影響していますし、既にリリースさせていただいているフジテレビさんとサガテレビさんで行ったリモート実験もあります。

ただし5G自体がまだカバーエリア的にはそこまで広がっていないのもありまして、M2 LiveはLTEでもお使いいただけるようになっています。

―― アップロード回線がバラバラだと、リアルタイム性という点では時間差が出てくると思うんですよね。そういうところって、どういう風に解決していくんでしょうか。

前川 そこがポイントの一つだと思うんですけれども、ネットワークを使ってクラウドに上げていく場合には遅延とジッタ(時間軸のゆらぎ)が問題になります。ジッタを吸収する際には、通信の中に再送する仕組みを入れるんですけれども、その中で遅延量を整理して、それぞれの遅延量を合わせていく仕組みをソニーの独自QoS(Quality of Service)の中に入れています。

染谷 今回、M2 Liveでは他の汎用的な機器もサポートしますが、それらの機器ではちょっとそういうことができないプロトコルなどもあり、そこが難しいところです。もともとハードウェアのスイッチャーでも入力のディレイがあって、遅延が一番遅いところに合わせ込んだりしていましたが、ケーブル接続の場合はフレーム単位で済んでいました。しかし、ネットワークになると数100msの遅延差が発生することもあり、そこを合わせ込むことになりますので、対応可能な機材では、そこのバッファーをクラウド上で持たせて合わせ込んでいくということになります。

―― 映像・音声信号はディレイでタイミングを合わせるとしても、現場とスイッチャーオペレーションとの間で見てる映像がずれることになりますよね。例えばスイッチャー側で絵を見ながら急いでカメラマンに指示を出しても、それほど遅延が大きいと現場では被写体がもう通り過ぎて目の前にいない、ということにもなりかねないと思いますが。

前川 多分イメージされてるのはスポーツのライブ配信などでしょうか。さすがにモータースポーツみたいなものをパンパンと切り替えていくというのは、おそらく最初は厳しいと思います。ただ、IP伝送を使ったリモート中継というのはもう数年前からやられていて、遅延が大きいと片道で100ms超えてくるような場合でも、実際に中継をやられています。当初はいろいろ懸念したんですけども、数フレームぐらいの遅れであれば、ネットワーク遅延を考慮して運用側でなんとか吸収しているという理解です。

それ以外の本当に瞬間的な切り替えが必要なものであれば多分遅延は許されないので、そこは従来方式の制作という方法を残して、そこをいかに小さくした上でそれ以外をクラウドでやるかという、そういった組み合わせで運用していくのかなっていうイメージを持っています。

―― なるほど。従来方式とクラウドのハイブリッドでやる、ということですね。

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- 「成長していないパナソニック」から脱却へ、楠見CEOが「MIF」で描く次の一手

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

コーナーリンク