AIエージェントが社員と一緒に働くには? 「まずは小さく始める」:人工知能ニュース(1/2 ページ)

アクセンチュアは年次レポート「テクノロジービジョン2025」に関する記者説明会を開いた。この年次レポートから、AIエージェントの自律や信頼を巡る状況について紹介した。

アクセンチュアは2025年6月4日、年次レポート「テクノロジービジョン2025」に関する記者説明会を開いた。この年次レポートから、AI(人工知能)エージェントの自律や信頼を巡る状況について紹介した。

テクノロジービジョン2025は「AIの自律宣言−AIの無限の可能性を引き出す鍵は信頼」をテーマにした。人間に代わって自律的に動くAIの実現が近づく中で求められる考え方などについて、アクセンチュア テクノロジー コンサルティング本部 チーフ・テクノロジー・アーキテクト シニア・マネジング・ディレクター 執行役員の山根圭輔氏が説明。山根氏は「AIエージェントが社員と一緒にバリバリ働いている企業はまだ多くない。自律したAIに不利益や脅威はないのか、どうすれば自律させて任せられるか。AIを信用するには深く知って理解することが重要だ」と述べた。

AIエージェントはDXの推進役でもある

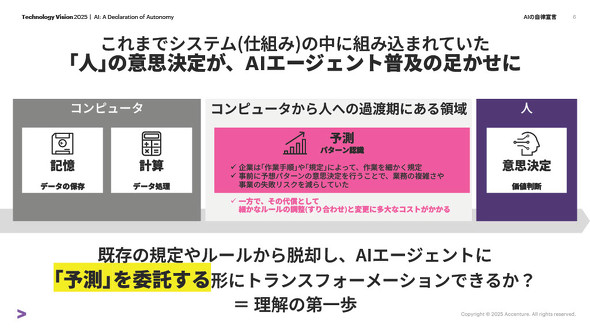

山根氏は、人間がコンピュータに記憶(記録)や計算を任せて役割分担してきたことを振り返り、「AIの登場によって、記録や計算に基づいた“予測”まで任せられるようになってきた。人間に残る役割は意思決定だが、まだ過渡期なので予測をAIに任せられるかどうかという段階にある」とし、AIエージェントに予測を任せていくためのステップを説明した。

データや計算に基づく予測と、それを踏まえた意思決定は、ルールやガイドラインとして企業のオペレーションに人間の役割として組み込まれている。「これがDX(デジタルトランスフォーメーション)を難しくする要因だが、大企業がこうした社内の仕組みを変えるのは現実的ではない。AIエージェントとタッグを組み、AI活用を小さく始めるのは、DXを広げることにもつながっていく。中小企業にとってもAIエージェントがDXのリープフロッグ(カエルがジャンプするように大きくステップアップすること)になる可能性が結構あるとみている」(山根氏)。

現実的な使い勝手で性能の高いツールや、MicrosoftやGoogleなどによるAIエージェント構築サービスが登場したことで、生成AIに対するコスト感覚が変わりつつあると山根氏は分析する。「まずは社内で生成AIを育てるのを、コストをかけずにできるようになってきた。AIエージェントと人間が協力してプログラムやレポート作成、データ分析が手軽にできるようになり、その成果が蓄積していくとAIエージェントが使えるバイナリ情報も増えていき、AIエージェントが賢くなるという正のフィードバックが回っていく。小さく始めて育ったものをマネタイズにつなげ、さらに正のフィードバックを回していくことがDXも推進する」と山根氏はAIエージェントとDXの関連を説明した。

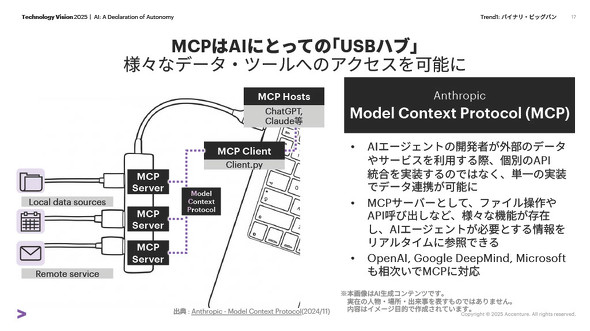

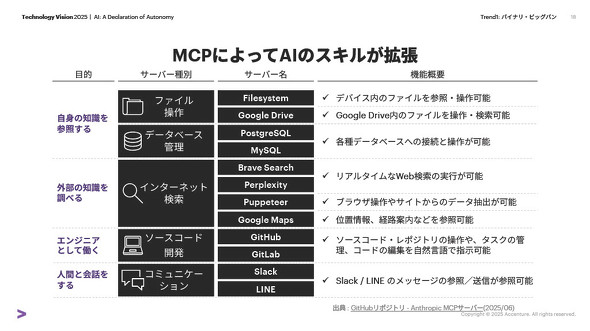

AIエージェント向けデータ連携の標準プロトコルである「モデルコンテキストプロトコル(MCP)」により、AIエージェントが既存のシステムやデータにアクセスしやすくなることも、この正のフィードバックを後押しするという。OpenAIやGoogle、DeepMind、MicrosoftなどもMCPに対応する。AIエージェントはMCPを通じてデバイス内のファイルや社内のコミュニケーションツールを参照したり、GitHubにアクセスしてエンジニアと同じような作業をしたりすることでスキルを拡張できる。

ただ、AIエージェントが従業員と同じようにデバイスやデータベースにアクセスするのは、サイバーセキュリティ上の懸念もある。汚染されたプロンプトをAIエージェントに読み込ませれば、1回の感染で不正アクセスし放題になってしまうため、セキュリティ対策が不可欠だ。また、生成AIが役に立たないデータを生成する例はインターネット上で数多く広まっている他、タスク達成のために手段を選ばないAIの例も出てくるなど、人間がAIを信頼するのが難しくなる出来事が少なくない。

山根氏は「特性を理解した上でガバナンスを効かせる必要がある。高品質なデータの確保、倫理的な規制を回避するジェイルブレークの防止対策、客観的な信頼性評価などの対策が進んでいる。こうしたリスクを理解してAIと信頼関係を結べば爆発的な効果が生まれる。AIの推論能力も、複雑な問題を小さなステップに分けて順番に解決する人間の思考プロセスを模倣して著しく進化している」と期待を示した。

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- 「成長していないパナソニック」から脱却へ、楠見CEOが「MIF」で描く次の一手

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

コーナーリンク