東芝から世界最高精度の自動運転AI技術が2つ、推定誤差を従来比4割削減:人工知能ニュース

東芝は、自動車やドローンなどの安全性向上や自動走行・自律飛行に用いる2つのAI(人工知能)技術で世界最高精度を達成したと発表した。1つは、カメラと慣性センサーの組み合わせだけで自車両の動きを高精度に推定する「自車両の動き推定AI」で、もう1つはさまざまな交通シーンで周辺車両の将来の動きを予測する「他車両の動き予測AI」。

東芝は2020年6月3日、自動車やドローンなどの安全性向上や自動走行・自律飛行に用いる2つのAI(人工知能)技術で世界最高精度を達成したと発表した。1つは、カメラと慣性センサーの組み合わせだけで自車両の動きを高精度に推定する「自車両の動き推定AI」で、もう1つはさまざまな交通シーンで周辺車両の将来の動きを予測する「他車両の動き予測AI」。公開データを用いた実験により、推定結果と実距離の差の絶対値の平均である推定誤差について、従来技術と比較してそれぞれ40%削減したという。今後は、公道など実際の環境での評価を行い、2023年度の実用化を目指すとしている。

自動運転車の安全走行には、自車両の動きの正確な推定と、他車両の将来の動きを正確に予測する技術が不可欠といわれている。そのために、LiDAR(Light Detection and Ranging、ライダー)やGPSなどのセンサーを用いた技術が開発されているが、高価であったり、周辺の建物などによっては衛星からの電波が届かず計測ができなかったりといった課題が指摘されている。また、将来の動きを高精度に予測するためには、周辺道路の車線数や曲率などの道路形状に合わせてそれぞれ予測AIモデルを用意する必要があり、さまざまな交通シーンや車両の動きが想定される一般道への対応が難しいのが現状だ。

そこで東芝は、これらの課題を解決するために、安価に手に入るとともに電波などの環境に依存しないカメラと慣性センサー(加速度センサー、角速度センサー)を用いる「自車両の動き推定AI」と、道路形状ごとに予測AIモデルを作る必要のない「他車両の動き予測AI」の開発に乗り出した。

「自車両の動き推定AI」で難しいのは高速道路?

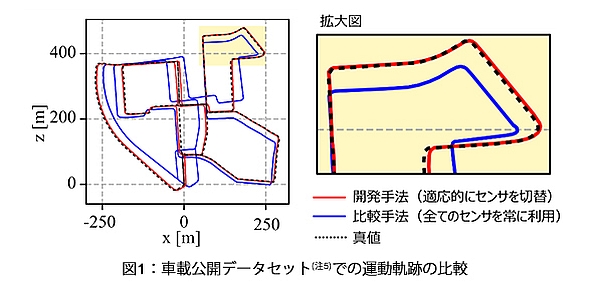

「自車両の動き推定AI」では、カメラ画像から周囲環境の3次元空間地図の生成と車両位置の推定を同時に行うSLAM(Simultaneous Localization and Mapping)技術をベースに、慣性センサーを用いることでさまざまな道路環境に対応する。ただし、カメラと慣性センサーの組み合わせで課題になるのが、高速道路などで車両の速度が一定でセンサーの値に変化がない場面だ。この場合、センサーのノイズの方が有効信号より大きくなってしまい、推定精度に悪影響を及ぼしかねない。

開発したAI技術では、車両の動きに応じて画像(カメラ)、加速度センサー、角速度センサーごとのデータの有用性を各時刻で判定し、変化がある有効なセンサーだけを適宜組み合わせて車両の動きを推定する手法を開発した。これにより、自動車のように加減速が比較的少ない動き方から、ドローンのような加減速の大きい動き方まで対応することができる。

公開されているデータセット(KITTI、EuRoC)を用いて開発技術を検証したところ、カメラと慣性センサーから得られる全てのセンサーデータを常に利用する従来手法と比べて誤差を40%低減できた。また、カメラのみを用いた場合との比較でも誤差を82%低減できている。真値の軌跡ともほぼ一致しており、世界最高精度の結果を確認できたとしている。

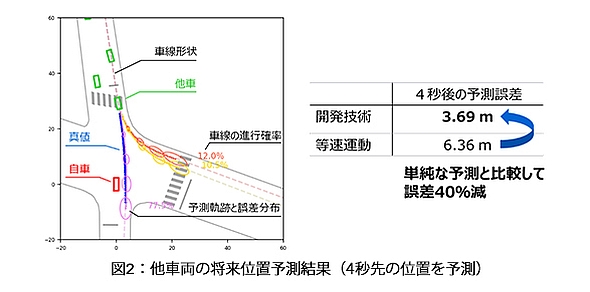

多様な道路形状に対応する「他車両の動き予測AI」

「他車両の動き予測AI」については、さまざまな道路形状で有効だという。道路形状などを一般化した幾何学的な特徴をディープラーニングで学習することで、実際の道路の形状に依存しないAIが実現でき、さまざまな交通シーンが想定される一般道などにおいても膨大な数の予測AIモデルの作成が不要になるとする。車線ごとの動きの予測と、将来走行する可能性の高い車線を予測のする2段階構成となっており、多様な道路形状に対応して高精度な予測を実現している。

公開されているデータセット(Argoverse)を用いた実験では、他車両の将来位置予測(4秒先の位置の予測)において、従来手法と比較して誤差を40%以上削減し、世界最高精度を達成したという。

関連記事

自動運転で広がる非競争領域、足並みを速やかにそろえられるか

自動運転で広がる非競争領域、足並みを速やかにそろえられるか

自動車業界の大手企業が自前主義を捨てることを宣言するのは、もう珍しくなくなった。ただ、協調すること自体は目的ではなく手段にすぎない。目的は、安全で信頼性の高い自動運転車を速やかに製品化し、普及させることだ。協調路線で動き始めた自動車業界を俯瞰する。 現実世界で100億kmは走れない、自動運転車のバーチャルとリアルの融合

現実世界で100億kmは走れない、自動運転車のバーチャルとリアルの融合

ADAS(先進運転支援システム)の高度化から、無人運転車まで、自動車業界が直面する自動運転技術の開発は複雑さを極めている。これに伴い、自動運転車の信頼性の検証も、実走行のテストではまかないきれなくなっている。その中でシミュレーションをいかに活用すればいいのか、走行データというリアルな資産をどのようにバーチャルにつなげるべきなのだろうか。 NVIDIAがADAS用カメラもカバー、ロボタクシーは処理性能を6倍に

NVIDIAがADAS用カメラもカバー、ロボタクシーは処理性能を6倍に

NVIDIAは2020年5月14日(現地時間)、自動運転車向けのプラットフォーム「NVIDIA DRIVE」に次期型のSoC(System on Chip)「Orin」と新たなGPUアーキテクチャ「Ampere」を導入すると発表した。 低速自動運転を“商品レベル”で実現へ、ヤマハ発動機とDMPがAIで資本提携

低速自動運転を“商品レベル”で実現へ、ヤマハ発動機とDMPがAIで資本提携

ヤマハ発動機は2019年5月12日、同社製品の自動化と自律化の実現に向けた知能化技術(AI)開発力の強化を目的として、ディジタルメディアプロフェッショナル(以下、DMP)と業務資本提携を行うことを発表した。DMPが行う第三者割当新株式をヤマハ発動機が引き受ける形となり、出資完了後はヤマハ発動機がDMPの筆頭株主となる。 ソニーがNVIDIAの自動運転プラットフォームとつながる、TRI-AD採用のHILSとも連携

ソニーがNVIDIAの自動運転プラットフォームとつながる、TRI-AD採用のHILSとも連携

ソニーは、NVIDIAのユーザーイベント「GTC 2019」(2019年3月19〜21日、米国カリフォルニア州サンノゼ)において、解像度がフルHDや4Kの車載カメラ8台を自動運転プラットフォーム「DRIVE AGX Xavier」に接続するデモンストレーションを実施した。自動運転に対応できる高画質な複数のカメラ映像を取り込み、遅延なく同時に表示できることをアピールした。自動運転システムの開発で広く用いられているNVIDIA製品と車載向けCMOSイメージセンサーを連携させることにより、量産される自動運転車での採用につなげる。 トヨタ子会社TRI-ADがNVIDIAを全面採用、シミュレーションから車載コンピュータまで

トヨタ子会社TRI-ADがNVIDIAを全面採用、シミュレーションから車載コンピュータまで

NVIDIAは2019年3月18日(現地時間)、ユーザーイベント「GTC 2019」(2019年3月19〜21日)において、トヨタ自動車、デンソー、アイシン精機の共同出資会社であるToyota Research Institute Advanced Development(TRI-AD)との協業範囲を拡大すると発表した。自動運転AIの学習、クラウドベースの走行シミュレーションによる検証から開発用車載コンピュータまで、エンドツーエンドでNVIDIAの技術、製品を採用する。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

モビリティの記事ランキング

- 新型「bZ4X」の走行距離が伸びた理由、デンソーの「世界初」と「世界最高」が貢献

- ギガキャストを発案したテスラの現在・過去・未来

- ECUの一体化で進化したトヨタの「新型TSS」 RAV4の安全走行を支える技術とは

- スズキ、排出ガス中のCO2を回収し農場で再利用できる「スーパーキャリイ」披露

- SDV時代には「製品開発スピード」だけでなく「製品発見スピード」も求められる

- どこへでも移動可能な自由を── ランドクルーザーの新型車「FJ」シリーズが登場

- 「新興勢力に圧倒的に劣っている」――ホンダは開発を根本から変えられるか

- コマツが次世代月面物流ローバーの研究開発を開始

- 新型「CX-5」はSUVの王道を極める、SDV化も進みアップデートでGeminiも利用可能

- デンソー新型SiCなど世界初公開23件! 「人テク展」が映す自動車技術の現在地

コーナーリンク

「自車両の動き推定AI」の公開データセットによる評価結果 出典:東芝

「自車両の動き推定AI」の公開データセットによる評価結果 出典:東芝 「他車両の動き予測AI」の公開データセットによる評価結果 出典:東芝

「他車両の動き予測AI」の公開データセットによる評価結果 出典:東芝