かつて世界一を支えたNECのベクトル演算技術、いま「次世代イノベーション」を担う:モノづくり最前線レポート(2/2 ページ)

新開発のベクトルプロセッサは世界一のメモリ帯域を実現

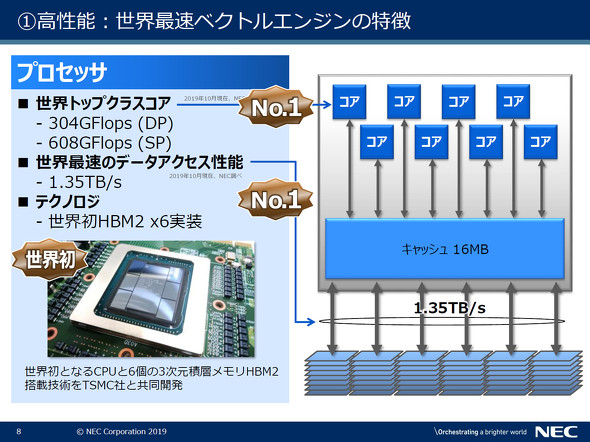

SX-Aurora TSUBASAのベクトルプロセッサは「単一コア当たり世界トップクラス」(NEC)となる演算性能とメモリ帯域を実現。2019年11月以降に受注開始する一部製品ではメモリ帯域をさらに向上させており、最上位モデルのベクトルプロセッサでは2.43TFLOPS(倍精度)の演算性能と、「世界一」(NEC)となる1.35TB/sの帯域幅を提供する。

この高メモリ帯域の実現では、TSMCのCoWoS(Chip-on-Wafer-on-Substrate)技術をベースにNECとTSMCが共同開発したメモリ実装技術が貢献している。同技術は「世界で初めて」(NEC)シリコンインターポーザ上にプロセッサダイと6個のHBM(High Bandwidth Memory)2スタックを搭載している。従来は、NVIDIA製GPU「Tesla V100」など4個のHBM2スタック搭載チップが最大だった。ベクトルプロセッサのダイは16nm FinFETプロセスを採用する。

デスクトップで使えるベクトル計算機、TensorFlowも利用可能に

SX-Aurora TSUBASAはスーパーコンピュータが従来より得意としてきた科学技術計算のみでなく、AIやビッグデータ解析といった新たな分野への適用も目指す。

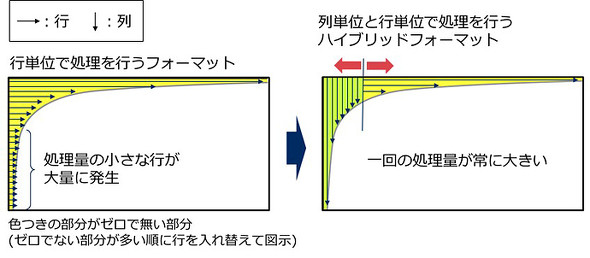

NECは2017年7月、ベクトル計算機に適した機械学習の高速実行技術を開発したと発表している。同技術では、機械学習で大規模データを取り扱う場合に頻出する疎行列演算について、列単位と行単位で処理を行うフォーマットを使い分けるハイブリッドフォーマットを開発。データ処理量を常に大きく保つことで演算効率を向上させている。また、並列演算時の疎行列処理結果をまとめる通信量を削減する技術も生み出した。

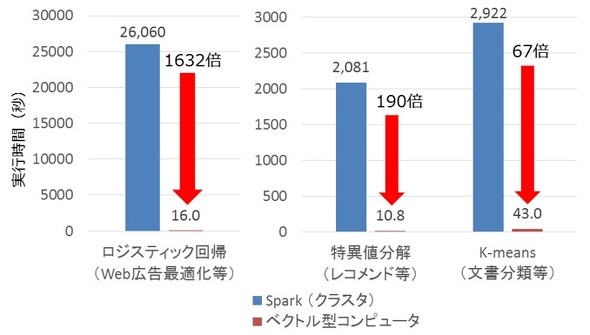

これら技術を盛り込んだミドルウェアを開発し、ユーザーはPythonやクラスタコンピューティングフレームワークのApache Sparkから特別なプログラミング無しで使用できる。同技術を用いてSX-ACEとサーバクラスタを同一コア数で性能比較した場合、Web広告最適化などに利用されるロジスティック回帰では1632倍の高速化を実現したという。

同社担当者は「ECサイトにおけるユーザーへの商品レコメンド機能も他社製CPUと比較して約100倍高速に処理できる。ベクトルプロセッサはニューラルネットワーク以外の統計的機械学習に向く」と述べる。また、Googleが開発する機械学習フレームワーク「TensorFlow」を、SX-Aurora TSUBASA向けに実装した「TensorFlow for SX-Aurora」のリリースも2019年6月から始めている。

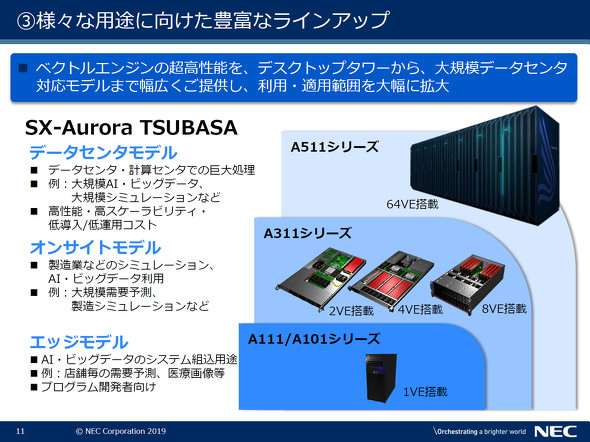

SX-Aurora TSUBASAのシリーズラインアップは、VEを1基搭載しデスクトップで利用可能な「エッジモデル」が2機種、VEを2〜8基搭載するラックマウントフォームファクタの「オンサイトモデル」が3機種、データセンターやHPC用途を指向しVEを64基搭載する「データセンターモデル」が1機種。幅広い筐体サイズに対応し、計算能力ニーズに応じた選択を可能とした。

従来のスーパーコンピュータユーザーに加え、AIやビッグデータ解析を行う企業や研究所の研究者なども、高性能なベクトル計算機を利用しやすくした形だ。最下位モデル(A111-1)の最小構成価格はSDKを含めて170万円(以下、税込み)、データセンターモデル(A511-64)は1億2000万円以上となる。

関連記事

HPCとAI性能を両立したポスト「京」のCPU、ウエハーが初公開

HPCとAI性能を両立したポスト「京」のCPU、ウエハーが初公開

富士通は2019年5月14日、同社のプライベートイベント「富士通フォーラム2019 東京」(2019年5月17日、東京国際フォーラム)の内覧会で、次世代スーパーコンピュータであるポスト「京」に搭載されるプロセッサ「A64FX」のウエハーが初公開された。 ポスト「京」のプロセッサ「A64FX」はArmベースながら異彩放つ重厚系

ポスト「京」のプロセッサ「A64FX」はArmベースながら異彩放つ重厚系

「Arm TechCon 2018」では、Armのアーキテクチャライセンスを基に開発が進められている、次世代スーパーコンピュータのポスト「京」(Post-K)向けのプロセッサ「A64FX」に関する講演が行われた。 スーパーコンピュータ京がGraph500で8期連続世界第1位を獲得

スーパーコンピュータ京がGraph500で8期連続世界第1位を獲得

理化学研究所らによる国際共同研究グループは、大規模グラフ解析に関するスーパーコンピュータの国際的な性能ランキングGraph500にて、スーパーコンピュータ「京」による解析結果が8期連続で第1位を獲得したと発表した。 Graph500の1位にスパコン京、6期連続で

Graph500の1位にスパコン京、6期連続で

理化学研究所らによる国際共同研究グループは、スーパーコンピュータ「京」が6期連続で「Graph500」の1位に選ばれたと発表した。ビッグデータの処理で重要となるグラフ解析において、最高レベルの評価を得た。 量子コンピュータとAI、先進技術における日本の最新動向と位置付け

量子コンピュータとAI、先進技術における日本の最新動向と位置付け

日本最大級の産学官連携イベント「イノベーション・ジャパン2019」(2019年8月29〜30日、東京ビッグサイト青海展示棟)において、科学技術振興機構(JST)事業セミナーで、JST研究開発戦略センター(CRDS)がAI技術および量子コンピュータ技術の最新動向について紹介した。 深層学習研究用のプライベートスパコンが稼働開始、民間では国内最大規模

深層学習研究用のプライベートスパコンが稼働開始、民間では国内最大規模

Preferred Networksは、深層学習を研究開発するためのプライベートスーパーコンピュータの稼働を開始した。計算ノードにNVIDIA製のTesla P100 GPUを1024基搭載し、民間企業の計算環境としては、国内最大規模のスーパーコンピュータとなる。

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- 「成長していないパナソニック」から脱却へ、楠見CEOが「MIF」で描く次の一手

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

コーナーリンク