ICTインフラから新たなアーキテクチャへ NTTが描く“AIネイティブインフラ環境”:製造マネジメントニュース(1/2 ページ)

NTTは、AI時代における同社の“AIネイティブインフラ”の実現に向けた取り組みについて説明した。同社はAI需要の拡大に合わせ、データセンターの拡張や液冷方式対応を進め、顧客のリソースを最適化してセキュアな利用環境と統合的なオペレーションを実現するAIネイティブインフラ「AIOWN」を展開していく方針だ。

NTTは2026年4月27日、東京都内とオンラインで会見を開き、AI(人工知能)時代における同社の“AIネイティブインフラ”の実現に向けた取り組みについて説明した。

NTTはAI活用の進展に“5つの技術”でアプローチ

さまざまな業界でAI活用が進む中、インフラ環境に求める要件が変化しているという。NTT 代表取締役社長の島田明氏は「GPUサーバを用いたAI処理が中心となり、それに伴ってネットワークの応答速度が求められるようになっている。また、データセンターには立地の良さだけではなく、GPUの計算能力を最大化するための発熱対策が必要になるなど、従来のICTインフラから新たなアーキテクチャのインフラへ転換していく必要がある」と語る。

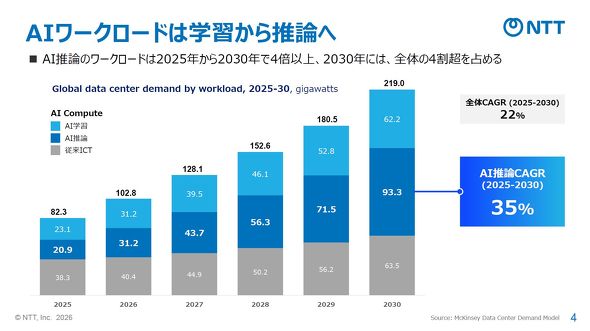

McKinsey & Companyが公表しているデータによると、AI全体のワークロードは2030年までに約22.5倍以上に成長すると予測されている。特に2030年のAI推論ワークロードについては、2025年と比較した際に約4倍以上まで成長し、AI全体のワークロードの内、約半分以上をAI推論が占めるとしている。また、AIの活用領域がより専門性の高い分野に広がるようになると、機密データやインテリジェンスを守るためにセキュリティ対策も重要になる。

これらの背景を踏まえNTTは、AI活用の進展と領域拡大の際に立ちはだかる課題に対して、「液冷方式」「光電融合インターコネクト/ネットワーク」「ソブリンAI」「分散基盤の最適化」「AI向けネットワーク」の5つの技術に焦点を当てて解決を目指している。

データセンターなどに設置してあるGPU高密度ラックの発熱に対しては、GPUの発熱をコスト効率よく冷却する液冷方式技術を展開していく。これにより、従来の空冷方式と比べて冷却に掛かる消費電力を最大で約60%削減可能だ。また、データセンターやサーバ間の遅延を防ぐために光電融合インターコネクト/ネットワークの構築を進め、分散学習や推論を支える低遅延/超高速環境を整えていく。

各企業が持つ大切なデータやノウハウを守るために、ユーザーがデータ主権を持ち、安全性と法規制を確保するソブリンAIを提供する。エッジ領域へのAI拡大に向けては、GPU基盤やオンプレミス環境を整える分散基盤最適化を進めて、統合的かつ効率的なオペレーションを実行可能な状態を目指す。AI推論などのAIワークロードに最適化したAIネットワークの構築も併せて進める。

NTTはこれらの5つの技術を中心に、AI需要の拡大に合わせたデータセンターの拡張/液冷方式対応を進めていく。そして、顧客のAIの利用用途に応じて必要なGPUなどの計算リソース/ネットワーク/電力といったリソースを最適化し、セキュアな利用環境と統合的なオペレーションを実現するAIネイティブインフラ「AIOWN」を展開していく方針だ。

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 「成長していないパナソニック」から脱却へ、楠見CEOが「MIF」で描く次の一手

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- なぜ日産は黒字でホンダは赤字に? EVは減損の嵐……明暗分かれた自動車5社決算

- 切削技術を活用したゴム成形金型屋の「自社製品」に驚いた話

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- 企業の経営効率を高める「業務分析」と「職務分析法」「生活分析法」

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

コーナーリンク

NTTの島田明氏

NTTの島田明氏