カナダが目指す持続可能な生成AIイノベーションの枠組みづくり:海外医療技術トレンド(104)(2/3 ページ)

カナダ個人情報保護当局が生成AIプライバシー保護原則を公表

一方、個人情報保護の分野では、本連載第94回で取り上げたように、カナダ・プライバシー・コミッショナー事務局(OPC)が2023年4月4日、「ChatGPT」に関する調査を開始したことを発表した。その後OPCは、同年12月7日、「責任ある信頼されたプライバシーを保護する生成AI技術のための原則」を公表している(関連情報)。本原則は、生成AIを開発、提供、利用する組織が、主要なカナダのプライバシー原則を適用する際に役立てることを目的として、カナダ連邦政府および各州/準州レベルのプライバシー保護当局が共同で策定したものである。主な対象読者として、(1)生成AIシステムの開発者/プロバイダーと、(2)生成AIを利用する組織を想定している。

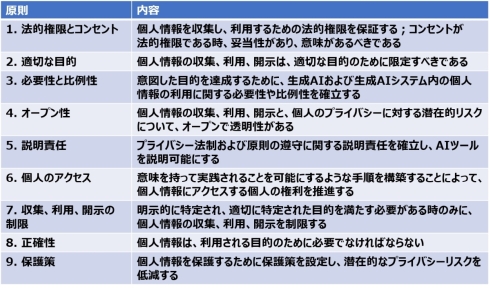

本原則では、表4に示す通り、生成AIシステムの開発、準備、利用のための原則として9項目を掲げている。

表4 生成AIシステムの開発、準備、利用のためのプライバシー保護原則[クリックで拡大] 出所:Office of the Privacy Commissioner of Canada (OPC)「Principles for responsible, trustworthy and privacy-protective generative AI technologies」(2023年12月7日更新)を基にヘルスケアクラウド研究会作成

表4 生成AIシステムの開発、準備、利用のためのプライバシー保護原則[クリックで拡大] 出所:Office of the Privacy Commissioner of Canada (OPC)「Principles for responsible, trustworthy and privacy-protective generative AI technologies」(2023年12月7日更新)を基にヘルスケアクラウド研究会作成そして、個々の原則について、全ての主体、生成AIシステムの開発者/プロバイダー、生成AIを利用する組織のそれぞれが順守すべき事項やベストプラクティスを提示している。

例えば、「説明責任」の原則では以下のような留意事項を挙げている。

- [全ての主体向け]

- プライバシー法制を順守する責任があることを認識し、この順守を実際に示すことができるようにすべきである

- プライバシー責務の順守に関する明確な期待を確立するように明確化された役割と責任、ポリシー、プラクティスなど、プライバシー順守目的で明確に定義された内部ガバナンス構造を有する

- 組織が、プライバシーに関連する質問や要望を受け取り、対応できるようなメカニズムを確立する

- プライバシーおよびその他の権利に関連して、生成AIシステムが有する可能性があるような潜在的または既知の影響度を特定し、低減するために、プライバシー影響度評価(PIA)および/またはアルゴリズム影響度評価(AIA)のような評価に着手する

- 生成AIおよびAI規制の双方が進化するという特性を想定して、定期的に説明責任の対策(バイアスのテスト/評価など)を見直し、再評価する

- [生成AIシステムの開発者・プロバイダー向け]

- 生成AIシステムからのアウトプットを追跡可能で説明可能にするために、適切なステップを踏む。簡単に言うと、これには、システムの稼働方法に関する完全な説明(トレーサビリティー)、アウトプットに到達した方法の根拠が含まれる。開発者/プロバイダーは、生成AIツールからのアウトプットを説明できないという意見を言ったところで、利用組織やツールと相互作用する個人に明示し、意図した目的のために利用するのに、ツールが適正か否かを判断できるようにすべきである

- 生成AIの学習データの露出が個人のプライバシーに影響を及ぼす場合、データ抽出に対するシステムの脆弱性およびその他の第三者に露出する可能性がある手法に関して、検証がなされることを保証する

- システムの妥当性や信頼性を評価するため、独立した監査に着手し、プライバシー法制の順守を確認し、不正確性やバイアスについて検証し、潜在的リスクを低減するために効果的な安全対策を推奨する。また開発者/プロバイダーに対しては、独立研究者、データ保護機関およびその他の関連する監視主体が、潜在的なリスクや影響度に関して、生成AIシステム(または基礎モデル)の評価・監査ができるようにすることが推奨される

- [生成AIを利用する組織向け]

- 意思決定の説明責任は組織に委ねられており、意思決定プロセスを支援するために利用される自動化システムにはない点を認識する

- 影響を受けた個人に対して、管理的あるいは行われた重要な意思決定向けの効果的なチャレンジのメカニズムを提供することを保証する。これには、要望に応じて、個人が意思決定に到達した方法を理解できるようにするために十分な情報を保持/提供すること、人間のレビューおよび/または意思決定について再考慮するよう求める機会を可能にすることが含まれる

- 生成AIシステムのアウトプットが、有意義に説明できない場合、提案した利用が適切でないか否かを考慮する

なおカナダでは、2022年6月16日、カナダ連邦議会に「2022年デジタル憲章実施法案」の一部として「人工知能・データ法(AIDA)」提案が上程されており、現在も審議が続いている(関連情報)。このような流れをくむ形で、2023年9月、イノベーション・科学経済開発省が「高度生成AIシステムの責任ある開発と管理に関する自主行動規範」を公表する(関連情報)など、いわゆるハードローおよびソフトローの両面から、生成AIに関する制度的仕組みづくりが進んでいる。

Copyright © ITmedia, Inc. All Rights Reserved.

医療機器の記事ランキング

- 脳動脈瘤の治療をより安全に テルモが細径対応の新デバイス発売

- 厚さ約25μmの神経シートを開発、光刺激と記録を同時に実現

- 約10秒で検温完了 ケースごと丸洗い可能なテルモの新型体温計

- 知人より見知らぬ他人とシンクロ? スポーツ観戦の熱狂を科学的に解明

- 生きた乳酸菌は代謝、死んだ乳酸菌は免疫へ 状態で異なる腸内効果

- 日立ら肺がん細胞診の新解析技術 SEMと元素分析で検体評価を支援

- 75秒で精子濃度など20項目を自動解析 男性不妊検査向け装置を提案

- 50万人の情報が流出した英国バイオバンクのインシデントでPETs利用は拡大するか

- あなたの「網膜」は実年齢より老けている? 写真1枚でAIが疾患リスクを推定

- がんの微小病変解析をより正確に、1台で核酸抽出から定量を自動処理する装置

コーナーリンク