日立の生成AI活用は生産性向上と安心安全の両輪で、推進組織も発足:人工知能ニュース(1/2 ページ)

日立製作所が生成AIに関する同社の取り組みについて説明。生成AIの安全かつ有効な社内外での利活用を推進するCoE組織「Generative AI センター」を新設したことも発表した。

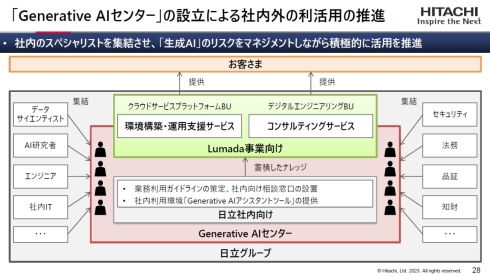

日立製作所(以下、日立)は2023年5月15日、東京都内で会見を開き、ChatGPTなどに代表される生成AI(人工知能)に関する同社の取り組みについて説明した。また同日付で、生成AIの安全かつ有効な社内外での利活用を推進するCoE(Center of Excellence)組織「Generative AI センター」を新設したことも発表した。同センターには、データサイエンティストやAI研究者、社内ITの他、数十人の各分野の専門家が組織横断で参加し、デジタルソリューション群「Lumada」の価値最大化や日立社内の生産性向上に向けて生成AIを積極的に活用していく方針だ。

日立 デジタルシステム&サービス統括本部 CTOの鮫嶋茂稔氏は「当社はこれまでも生産性向上に役立つAIの開発や活用に注力してきたが、安心安全とのかかわりが深い社会インフラの事業を展開しているからこそ、生産性向上と安心安全の両輪で進めていくことを重視している。生成AIについても、これまでと同じようにこれらの両輪が重要なことに変わりはない」と語る。

「生成AIをリスクマネジメントしながら積極的に活用」

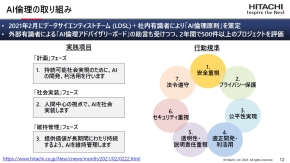

鮫嶋氏の語る通り企業によるAIの開発や活用では、学習に用いるデータのプライバシー保護や、AI倫理原則の策定が求められる。日立も、2013年5月にデータサイエンティストチームと社内有識者を中心に立ち上げたプライバシー保護の枠組みをベースにした「プライバシー保護諮問委員会」を2014年7月に設置しており、2021年2月にはLumada事業におけるデータ利活用組織であるLumada Data Science Lab.(LDSL)を中心にAI倫理原則を策定している。

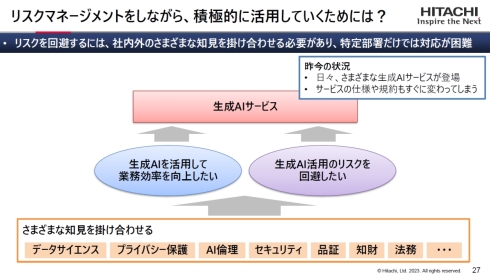

新たな技術や知見が日々生まれている生成AIを積極的に活用していく場合でも、従来と同様にリスクマネジメントが重要になる。日立 デジタルエンジニアリングビジネスユニット Data&Design本部長の吉田順氏は「リスクを回避するには社内外のさまざまな知見を掛け合わせる必要があり、データサイエンティストチームなど特定部署だけでは対応が難しい。そこでGenerative AI センターでは、データサイエンティストやAI研究者、社内ITだけでなく、製品やサービスの設計開発に携わるエンジニア、セキュリティ、法務、品証、知財といった社内のスペシャリストを集結させることで、生成AIのリスクをマネジメントしながら積極的に活用を推進していく」と説明する。

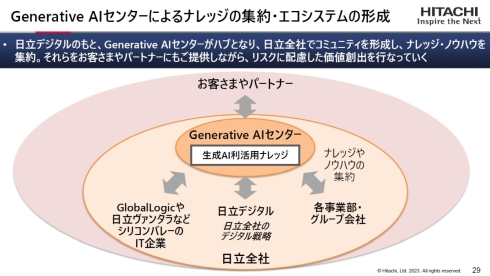

Generative AI センターの役割は大まかに分けて「日立社内向け」と顧客に対する事業展開と関わる「Lumada事業向け」の2つがある。まず、日立社内向けでは、文章の作成/要約や翻訳、ソースコード作成など、生成AIを日立グループ32万人のさまざまな業務で利用を推進し、生産性向上につなげるノウハウを蓄積する。北米を拠点とする日立デジタル下で、Generative AI センターがハブとなって日立全社でコミュニティーを形成し、生成AIの活用に関するナレッジやノウハウを集約する。

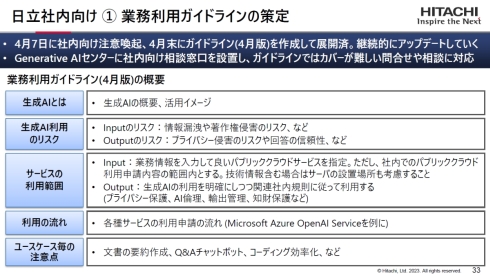

日立社内向けの具体的な取り組みとしては、2023年4月に社内展開した生成AIの業務利用ガイドラインがある。「生成AIは禁止ではなく積極的に活用していく」(吉田氏)。ただし、生成AIの技術進化が著しいこともありガイドラインは継続的なアップデートを行うとともに、Generative AI センターにも社内向け相談窓口を設置してガイドラインだけではカバーが難しい問い合わせや相談に対応する。

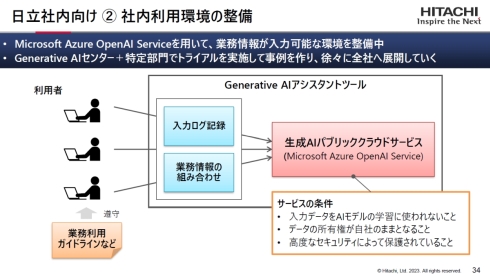

また、マイクロソフトの生成AIプラットフォームである「Microsoft Azure OpenAI Service」を用いて、業務情報が入力可能な環境の整備をスタートしている。立ち上げはスモールスタートとなり、Generative AI センターと特定部門でトライアルを実施して事例を作り、徐々に全社に展開して行く方針だ。

Copyright © ITmedia, Inc. All Rights Reserved.

製造マネジメントの記事ランキング

- 「成長する世界」と「停滞する日本」、最新データで1人当たりGDPは38位まで後退

- 日本の製造業は、「DX」の前に「DE」からで良い気がする

- 失敗データこそ資産だ――3Dモデルや解析結果をAIで統合、一目で探せるナレッジに

- 「子どもは最もシビアなユーザー」ジャクエツに見るデジタルではないDXの本質

- 古野電気とアイコムが無線機とレーダー分野での協業開始、新たな価値創出へ

- 2028年には1ラック当たり1MWの発熱量に!? AI時代におけるデータセンター動向とは

- 「成長していないパナソニック」から脱却へ、楠見CEOが「MIF」で描く次の一手

- デンソーがクラウド基盤の統合を推進、2拠点への統合でデータ移行の負担を解消

- OKIが6年間の中期計画、2031年度までに2950億円を投資し企業変革を加速

- ダイキン工業と野村不動産、使用済み空調機を分解し再資源化する実証開始

コーナーリンク

日立の鮫嶋茂稔氏

日立の鮫嶋茂稔氏

日立の吉田順氏

日立の吉田順氏