3棟で電源容量100MWに、NVIDIA認証のデータセンターと検証ラボが開設:組み込み開発ニュース(2/2 ページ)

MCデジタル・リアルティは千葉県印西市にデータセンター「NRT14」と検証ラボの「DRIL in Japan」を開設した。キャンパス戦略で顧客に合わせたキャパシティーの拡張や、機密性に強みを持つ。

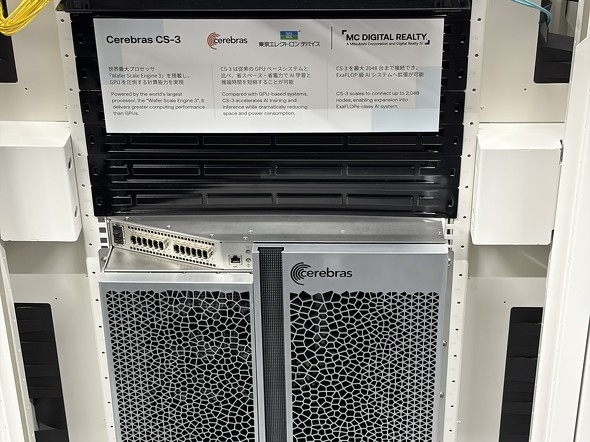

実証ラボ内の様子:最新AIサーバラックや冷却設備を公開

内覧会では、ラボ内に構築された次世代の計算基盤やネットワーク機器の詳細が公開された。

黒い筐体の「OCP ORV3 ラック」は、データセンターにおけるハードウェア設計をオープンソース化するプロジェクト「OCP(Open Compute Project)」の規格に準拠した専用ラックである。電源供給には背面に設置された「バスバー」と呼ばれる通電バーを使用し、そこから直接直流(DC)48Vを各サーバへ供給する仕組みを採用している。交流から直流(DC)48Vへ一括変換して供給する仕組みにより、電力変換効率を最適化しつつ、高密度なAIサーバ群の安定稼働を支える設計となっている。

またこの他、アリスタネットワークスの高性能イーサネットネットワーキングプラットフォームや、第3世代のウェハースケールAIチップを搭載したCerebrasのディープラーニング専用システム「CS-3」などの最新機器を導入している。これら約20社のパートナー企業によるエコシステムにより、AIインフラの最適化に向けた実証環境を整えた。

冷却設備は、データセンター側から供給される冷却水を、ラック下部などに設置した冷却水分配装置(CDU:Coolant Distribution Unit)で熱交換し、サーバへ循環させる仕組みだ。実証環境にはニデック製や富士通製のインラック型CDUを設置し、IT機器内を循環する二次側の冷却液には「PG25(プロピレングリコール25%水溶液)」を採用した。さらに、既存の空冷データセンターにおける高密度化の需要に応えるため、リアドア型の熱交換器といった代替ソリューションも併せて展示している。

キャンパス戦略で物理的距離や低遅延に強み

内覧会後に開催されたメディアブリーフィングでは、デジタル・リアルティのナー氏、シャープ氏とMCデジタル・リアルティ 代表取締役社長の山下康平氏より、最新の市場動向と戦略的展望が示された。

山下氏は、同社のデータセンターの強みとして「拡張性」と「キャンパス戦略」を挙げた。「印西エリアに複数の棟を連続して構築することで、顧客はビジネスの成長段階に合わせて柔軟にキャパシティーを拡張できる。さらに、物理的な距離の近さは低遅延や情報の機密性の面でも大きな利点となる」と強調した。

企業が扱うデータの保管場所やネットワークの要件も変化している。ナー氏は、用途に応じたデータセンターの使い分けについて、「既存のワークフローなどは従来のデータセンターで十分だが、新しいインフラでは複数のAI、またはAIエージェント同士を連携させる必要がある」と分析した。従来のデータ保管や定型業務は既存施設で対応可能である一方、マルチクラウド環境下で最新のAIアプリケーションを駆動させるには、専用の高度な相互接続インフラが不可欠であるとしている。

2社が提供するデータセンターのユースケースについてシャープ氏は、「業種を問わずAIが業務プロセスに組み込まれるようになった。直近では、金融や医薬品業界でのユースケースが増えている」と現状を明かした。特に、金融業界は従来自社でデータセンターを構築/保有していたが、「AIの電力や冷却要件に対応できなくなった企業が、当社のような最新鋭のコロケーション施設へ移行するトレンドが進んでいる」と指摘した。

シャープ氏は、日本市場の将来性についても強い期待を寄せた。「製造業において、日本はまだまだ世界をリードしていると考えている。今後、製造業ではAI活用が一段と進展するだろう」と述べ、同社として製造業企業のAIインフラ需要をけん引していく展望を示した。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

Arm初のCPUチップ「AGI CPU」が顧客とパートナーにもたらす悲喜こもごも

Arm初のCPUチップ「AGI CPU」が顧客とパートナーにもたらす悲喜こもごも

Armの最新動向について報告する本連載。今回は、2026年3月にArmが発表した、同社が初めてCPUチップそのものを製造/販売する「AGI CPU」を解説するとともに、顧客やパートナーにどのような影響を与えるのかを考察する。 NVIDIA「Vera Rubin」は7つの新チップ、GroqのLPU追加でAIエージェント性能向上

NVIDIA「Vera Rubin」は7つの新チップ、GroqのLPU追加でAIエージェント性能向上

NVIDIAは米国カリフォルニア州サンノゼで開催中のユーザーイベント「GTC 2026」の基調講演において、CPU「Vera」やGPU「Rubin」など新たなアーキテクチャを基にしたAIインフラの基盤「Vera Rubinプラットフォーム」を発表した。 次世代AI向け国産水冷データセンター、密閉循環で水使用効率を実質的ゼロへ

次世代AI向け国産水冷データセンター、密閉循環で水使用効率を実質的ゼロへ

PFN、IIJら3者はAI向け水冷データセンター「AImod」を2026年4月より稼働する。水冷と空冷ハイブリッド空調によりPUE1.1台とWUE(水使用効率)の実質的ゼロを達成。次世代チップを見据え、大規模AI計算基盤のモデル確立を目指す。 LLMじゃない、部品図の公差も読み解くリコーの「LMM」とは?

LLMじゃない、部品図の公差も読み解くリコーの「LMM」とは?

リコーは、複雑な図表や部品図を論理的に読み解く大規模マルチモーダルモデル(LMM)を開発した。大型モデルに匹敵する精度を小型サイズで実現し、オンプレミス向け業務エージェントの展開を加速する。 「蛇口をひねれば思考が出てくる時代」へ マクニカが示すAI革命の最前線

「蛇口をひねれば思考が出てくる時代」へ マクニカが示すAI革命の最前線

マクニカはメディア向け勉強会を開催し、「思考のコスト」を下げるAI革命の背景と進化を説明した。自律型AIの台頭、エッジAIへの移行、現実空間で稼働するフィジカルAIへの拡張という、3つのパラダイムシフトを示す。 宇宙に本格進出するNVIDIA、軌道データセンター向けの「Vera Rubin」を発表

宇宙に本格進出するNVIDIA、軌道データセンター向けの「Vera Rubin」を発表

NVIDIAはユーザーイベント「GTC 2026」において、最新のAIインフラ基盤「Vera Rubinプラットフォーム」をベースに、宇宙空間をはじめサイズ、重量、電力(SWaP)に制約のある環境向けに開発中の「NVIDIA Space-1 Vera Rubin Module」を発表した。