LLMじゃない、部品図の公差も読み解くリコーの「LMM」とは?:人工知能ニュース(1/2 ページ)

リコーは、複雑な図表や部品図を論理的に読み解く大規模マルチモーダルモデル(LMM)を開発した。大型モデルに匹敵する精度を小型サイズで実現し、オンプレミス向け業務エージェントの展開を加速する。

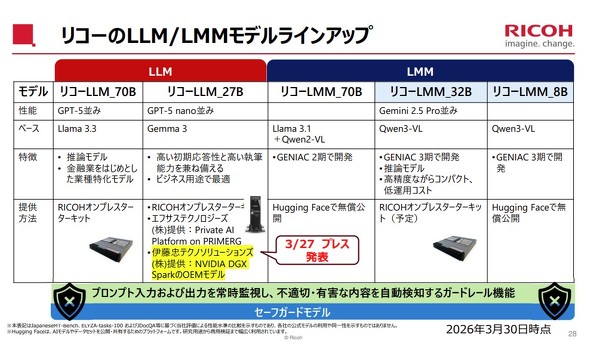

リコーは2026年3月30日、オンラインで会見を開催し、経済産業省主導の「GENIAC(Generative AI Accelerator Challenge)」プロジェクト第3期において、企業ドキュメントを多段推論で読解するマルチモーダル大規模言語モデル(LMM:Large Multimodal Model)の基本モデル「Qwen3-VL-Ricoh-32B-20260227」を開発したと発表した。

企業に眠る“秘伝のタレ”を読み解く

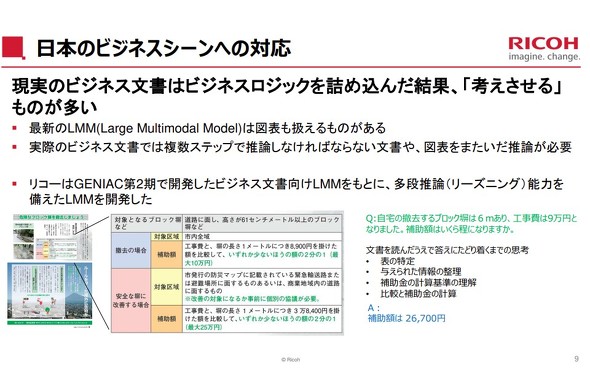

日本の企業の多く、特に製造業においては、設計図や品質管理基準、サービスマニュアルなどには、独自のビジネスロジックが図表やフローチャートとして高密度に詰め込まれていることが多い。例えば、工程順を表す「矢印(⇒)」や、グラフ内のテキストボックスなどがそれにあたる。

しかし、従来のテキスト検索やRAG(検索拡張生成)では、図表が表す文脈や、複数ページにまたがる関係性を正確に読み取ることが難しく、現場がほしい答えにたどり着けないという課題があった。リコー デジタル技術開発センター所長の鈴木剛氏は「日本ではビジネス文書にロジックを詰め込む文化がある。単に図表を視覚的に読み込むだけでなく、意図を正しく把握し、複雑な文書からQ&Aで知識を引き出せるモデルが必要だった」と開発の背景を語る。

鈴木氏は「多くの日本企業に存在する、“秘伝のタレ”ともいえる暗黙知を可視化し、トップラインの向上を実現したい」と語り、情報資産のデジタル化に取り組む姿勢を見せる。

「LLM」と「LMM」の違いとは?

LLM(Large Language Model:大規模言語モデル)は、膨大なテキストデータを深層学習し、自然な文章の理解や生成を行うAIモデルであり、テキストの処理に特化している。

一方、LMM(Large Multimodal Model:大規模マルチモーダルモデル)は、テキストに加えて画像、図表、動画、音声といった複数のデータ形式を統合的に扱えるAIモデルである。「マルチモーダルLLM」と表現されることもあるが、リコーではこれをLMMと呼んでおり、図面やフローチャートといった非テキスト情報の活用に向けて開発を推進している。

Copyright © ITmedia, Inc. All Rights Reserved.