カーナビが「前の黒いクルマに続いて曲がって」と案内、三菱電機が開発:車載情報機器

三菱電機は2020年7月22日、自然な言葉で人と機器が円滑に意思疎通する技術「Scene-Aware Interaction(シーン・アウェア インタラクション)」を開発したと発表した。

三菱電機は2020年7月22日、自然な言葉で人と機器が円滑に意思疎通する技術「Scene-Aware Interaction(シーン・アウェア インタラクション)」を開発したと発表した。

物体認識や意味的領域分割、移動体の動作解析、自然言語処理を組み合わせることにより、機器が認識した周辺環境や目の前の出来事を、自然言語で説明できるようにした。カーナビゲーションシステム、自律移動ロボットや監視カメラ、人の移動に合わせて稼働するエレベーターに開発技術を搭載することで、人やモノの動きが多い複雑な環境での機能を高めることができる。

従来のカーナビゲーションシステムを例にすると、地図データに含まれていない情報に言及した音声案内はできないため、距離や交差点の住所を基にルート案内を行わなければならない。開発技術では、郵便ポストや大きな看板などカメラで認識した目印に言及して右左折を指示したり、「前方の黒いクルマに続いて曲がってください」のようにアナウンスしたりすることができる。

また、「左から歩行者が道を渡ろうとしています」「対向車線のバスに注意してください」のように、周囲の環境を踏まえた警告を生成することも可能だ。ルート案内に対し、ドライバーが「目印が見つからない」とシステムに伝えると、案内の内容を変更して即座に代わりの目印や別の説明で言い直す。高精度地図と組み合わせることで空間の構成を高度に把握しているので、これらのことが可能になる。

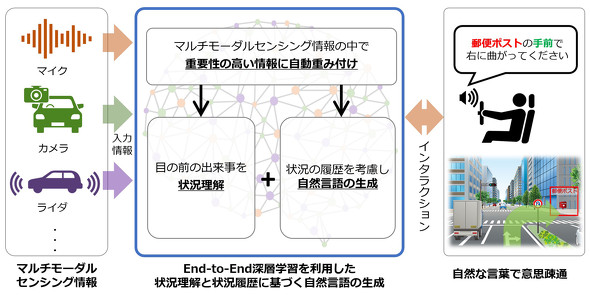

開発技術には、入出力のサンプルだけで学習できるエンドツーエンド深層学習を採用。カメラの画像データ、マイクで収集した音、LiDAR(ライダー、Light Detection and Ranging)やレーダーで取得した位置情報などさまざまな情報から、周囲の状況を機器が理解する。各種センサーから得た情報の中で重要度が高い情報に重み付けを行い、機器が理解した内容について自然な言葉を用いて詳細に表現するような学習モデルも構築した。

機器側は、これまでの状況や人間の発話の履歴から自然な言葉を生成し、人間と円滑に意思疎通を図る。機器が理解した内容が、人間の理解とどれだけ類似しているかを検討したところ、従来の視覚情報のみを基にした手法よりも高い評価を得られたとしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

人の曖昧な命令を自動補完するエッジAI、三菱電機が2022年にも製品搭載へ

人の曖昧な命令を自動補完するエッジAI、三菱電機が2022年にも製品搭載へ

三菱電機は人の曖昧な命令をエッジ機器単体で状況に応じて不足情報を自動補完して理解する「コンパクトな知識処理に基づくHMI制御技術」を開発した。同社のAI技術「Maisart」の1つで、テレビやカーナビゲーションシステムなどに用いられているプロセッサやメモリでも利用可能なエッジAI技術となる。 カーシェアや交通機関を外国人にも使いやすく、話者に合わせて言語を自動切換え

カーシェアや交通機関を外国人にも使いやすく、話者に合わせて言語を自動切換え

英語で話しかけると英語で、ドイツ語で話しかけるとドイツ語で、乗客の問いかけに答えるバスが2020年内にも走り出す。 ハーマンが自動車向けで3兆円の受注獲得、サムスングループの強みをフル活用で

ハーマンが自動車向けで3兆円の受注獲得、サムスングループの強みをフル活用で

サムスン傘下に入って3年のハーマンインターナショナルが、2025年に売上高200億ドル(約2兆1524億円)を達成するという目標に向けて動き出している。ハーマンインターナショナルは民生向けと自動車向けの両方でビジネスを展開しており、どちらも成長のけん引役と位置付けているが、売り上げの比率が大きいのは自動車向けだ。 中古車でもパーソナライズ可能に、BMWが新たなOTA計画を発表

中古車でもパーソナライズ可能に、BMWが新たなOTA計画を発表

BMWは2020年7月2日、2020年第3四半期以降の車載ソフトウェアのアップグレードについて発表した。 コンチネンタルが統合コックピットでパイオニアと協業、アジア市場向けで

コンチネンタルが統合コックピットでパイオニアと協業、アジア市場向けで

パイオニアとコンチネンタルは2020年5月26日、統合コックピットの開発における戦略的提携に合意したと発表した。 インフォテインメントは乗員みんなで使う、日産が進めるナビとスマホアプリの連携

インフォテインメントは乗員みんなで使う、日産が進めるナビとスマホアプリの連携

日産自動車は、「インテリジェントモビリティ」の要素の1つで、つながる便利さを提供する「インテリジェントインテグレーション」の取り組みの一環で、出発前から到着後まで、車内外の体験をシームレスにつなげるパーソナルサービスの開発を進める。その例が「コネクテッドアプリコンセプト」だ。 自動運転車の意思表示で「窓」が重要になる理由

自動運転車の意思表示で「窓」が重要になる理由

現在、ドライバーは他のドライバーや歩行者に、ライトを使って合図したり手振りをしたりするなどのさまざまな方法で意図を伝えています。しかし、クルマからドライバーがいなくなったらどうなるのでしょうか。