NVIDIAの「Rubin Ultra」は新サーバラック「Kyber」を導入、中は全て縦置き:組み込み開発ニュース

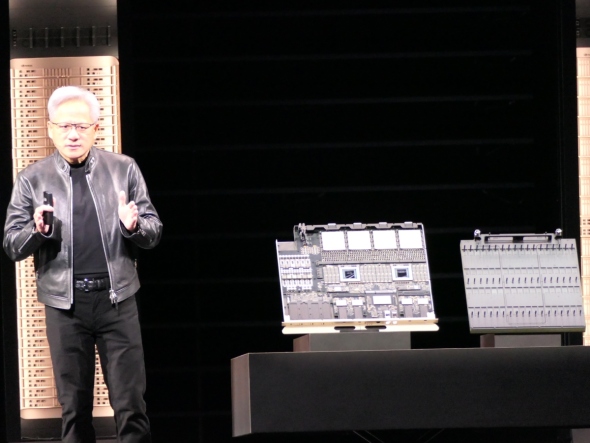

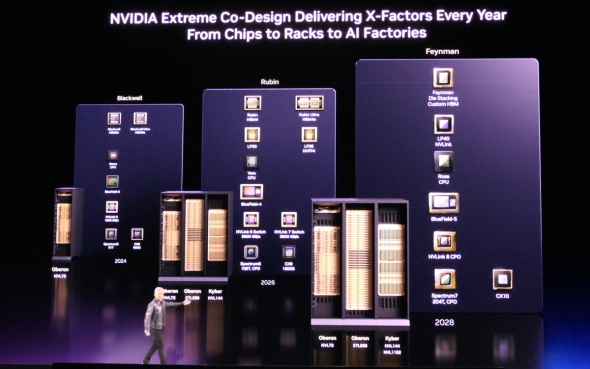

NVIDIAは、ユーザーイベント「GTC 2026」の基調講演において、主要チップの量産開始を発表したAIインフラ基盤「Vera Rubinプラットフォーム(以下、Vera Rubin)」以降の開発ロードマップを紹介した。

NVIDIAは2026年3月16日(現地時間)、米国カリフォルニア州サンノゼで開催中のユーザーイベント「GTC(GPU Technology Conference) 2026」(開催期間:同年3月16〜19日)の基調講演において、同イベントで主要チップの量産開始を発表したAI(人工知能)インフラ基盤「Vera Rubinプラットフォーム(以下、Vera Rubin)」以降の開発ロードマップを紹介した。

Vera Rubinでは、従来のBlackwell世代で用いていた6つのICを刷新するとともに、AIの推論処理に特化したLPU(Language Processing Unit)である「Groq 3 LPU」を新たに追加している。

NVIDIAはAIインフラ基盤を毎年進化させる方針であり、2026年に投入するVera Rubinに続いて2027年には「Rubin Ultra」を提供する予定だ。Rubin Ultraは、Vera Rubinの強化版の位置付けとなり、CPU「Vera」やデータ処理を行うDPU(Data Processing Unit)「BlueField-4」、サーバラック間を接続するネットワークインタフェースIC「ConnectX-9」、データセンター間をつなぐイーサネットスイッチIC「Spectrum-6」は変更しないものの、GPUとLPU、サーバラック内の接続を担うスイッチICである「NVLink」は新規開発を行う。さらに、サーバラックのフォームファクターも従来の「Oberon」に替えて新たな「Kyber」を導入する。

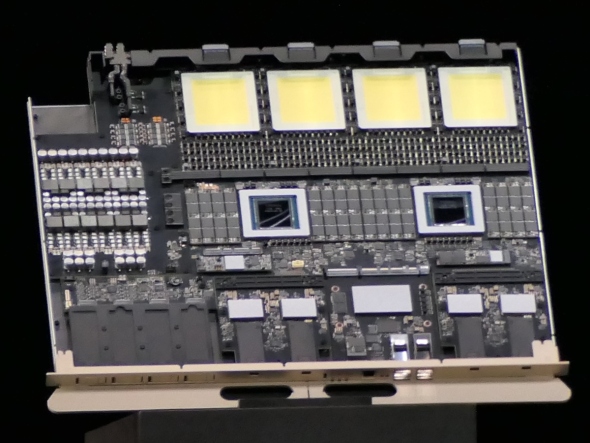

Rubin Ultraは、GPUダイ2個を集積したGPUパッケージを2個搭載することにより、GPUダイの個数でVera Rubinの2倍となる4個の構成となる。メモリもHBM4eにアップグレードされ、容量も1TBに到達する。AI処理性能は、NVIDIA独自の4ビット浮動小数点演算であるNVFP4で、Vera Rubinの2倍となる100PFLOPSだ。また、LPUは、NVFP4に新たに対応することでさらにAI推論処理性能を向上する。

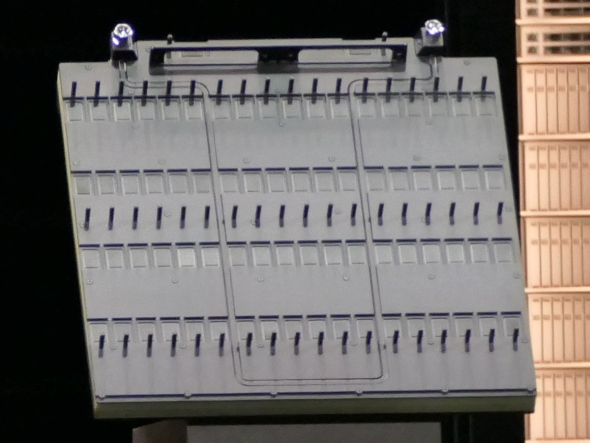

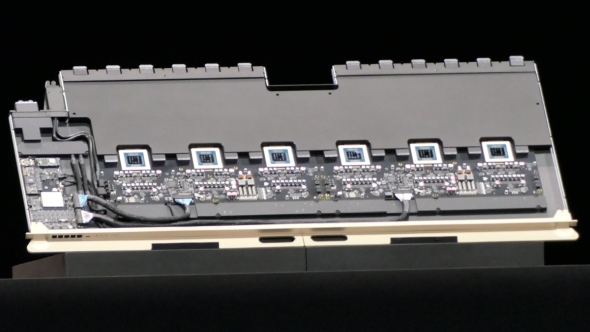

これら以上に大きな変更になるのがKyberの導入である。現行のOberonは、一般的なサーバラックと同様に、シャシーに装着したCPUやGPUを搭載するコンピュートトレーや、NVLinkを搭載するスイッチトレーの間をケーブルでつないでいた。Kyberでは、CPU(Vera)2個とGPUパッケージ2個を搭載するコンピュートブレード18枚を縦に並べて、ケーブルの役割を代替するミッドプレーンに接続する。一方、コンピュートブレードの背面側には、Kyber対応のため新たに開発したNVLinkである「NVLink-7」を搭載するスイッチブレードがやはり縦に並べられてミッドプレーンに接続される。コンピュートブレードとスイッチブレードは、Kyberのサーバラック内でそれぞれのミッドプレーンを介して接続されることになる。コンピュートブレード、ミッドプレーン、スイッチブレードともに全て縦置きで設置する構成となっている。

18枚のブレードユニットに搭載されるGPUパッケージの総数は36個で、Kyberのサーバラック内にはこのコンピュートブレード18枚のセットが2段分組み込まれる。さらに1パッケージ当たり2個のGPUダイが集積されているので、Kyberのサーバラック1台の中には144個のGPUダイを搭載されていることになる。

なお、Rubin Ultraのコンピュートブレードの背面に設置されるスイッチブレードはコンピュートブレードの約2倍のサイズであり、1台のKyberに12枚が組み込まれるという。

Rubin Ultraに次いで2028年は、新世代となる「Feynman」が投入される。今回のVera Rubinと同様に、主要な7つのチップの全てが刷新される予定だ。GPUは、HBM4eより広帯域のカスタムHBMをダイスタッキングで搭載する方針。CPUは「Rosa」、LPUは「LP40」、DPUは「BlueField-5」、ネットワークインタフェースICは「ConnectX-10」、イーサネットスイッチICは「Spectrum-7」、サーバラック内の接続を担うスイッチICは「NVLink-8」となる予定だ。

Rubin UltraでNVFP4に対応したLPUはインタフェースにNVLinkを用いてさらなる帯域幅の拡大を図る。また、Spectrum-7とNVLink-8では、光電融合技術であるCPO(コパッケージドオプティクス)を採用する予定である。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

NVIDIA「Vera Rubin」は7つの新チップ、GroqのLPU追加でAIエージェント性能向上

NVIDIA「Vera Rubin」は7つの新チップ、GroqのLPU追加でAIエージェント性能向上

NVIDIAは米国カリフォルニア州サンノゼで開催中のユーザーイベント「GTC 2026」の基調講演において、CPU「Vera」やGPU「Rubin」など新たなアーキテクチャを基にしたAIインフラの基盤「Vera Rubinプラットフォーム」を発表した。 NVIDIAのGPUは「Blackwell Ultra」から「Rubin」へ、シリコンフォトニクスも採用

NVIDIAのGPUは「Blackwell Ultra」から「Rubin」へ、シリコンフォトニクスも採用

NVIDIAは、米国サンノゼで開催中のユーザーイベント「GTC 2025」の基調講演において同社のGPUアーキテクチャのロードマップを発表した。 NVIDIAの新アーキテクチャ「Blackwell」は生成AI特化、汎用人型ロボットにも適用

NVIDIAの新アーキテクチャ「Blackwell」は生成AI特化、汎用人型ロボットにも適用

NVIDIAは「GTC 2024」において、新たなGPUアーキテクチャ「Blackwell」を発表。AI処理性能で前世代アーキテクチャ「Hopper」の5倍となる20PFLOPSを達成。生成AIの処理性能向上にも注力しており、Hopperと比べて学習で4倍、推論実行で30倍、消費電力当たりの処理性能で25倍となっている。 NVIDIAが生み出す半導体産業の“正の循環”、AIフィジックスが新たな原動力に

NVIDIAが生み出す半導体産業の“正の循環”、AIフィジックスが新たな原動力に

AI技術の進化をけん引するNVIDIAが、半導体技術の進化にも大きな影響を与えようとしている。同社のティム・コスタ氏によれば、AIエージェントとフィジカルAIに加えて、これらに次ぐ第3のAIともいえる「AIフィジックス」が重要な役割を果たすという。 NVIDIAは組み込みAIボードもBlackwell世代へ、2070TFLOPSの「Jetson AGX Thor」

NVIDIAは組み込みAIボードもBlackwell世代へ、2070TFLOPSの「Jetson AGX Thor」

NVIDIAは2025年8月25日、組み込みAIボード「Jetsonシリーズ」の最新製品となる「NVIDIA Jetson AGX Thor」を発表した。AI処理性能はFP4で2070TFLOPSで、これは現行の「NVIDIA Jetson AGX Orin」の7.5倍に達する。 NVIDIAがフィジカルAIのオープン展開を加速、自動運転向けで「Alpamayo」を公開

NVIDIAがフィジカルAIのオープン展開を加速、自動運転向けで「Alpamayo」を公開

NVIDIAは「CES 2026」の開催に合わせて、フィジカルAI(人工知能)の代表的なアプリケーションである自動運転技術とヒューマノイド向けのオープンソースAIモデルを発表した。