NVIDIA「Vera Rubin」は7つの新チップ、GroqのLPU追加でAIエージェント性能向上:人工知能ニュース(2/2 ページ)

NVIDIAは米国カリフォルニア州サンノゼで開催中のユーザーイベント「GTC 2026」の基調講演において、CPU「Vera」やGPU「Rubin」など新たなアーキテクチャを基にしたAIインフラの基盤「Vera Rubinプラットフォーム」を発表した。

AIエージェントの性能向上にはCPUとストレージも重要

5つのラックシステムについては、先述したVera Rubin NVL72とGroq 3 LPXの他、CPUのVera単体で構成される「Vera CPU Rack」、新たなストレージシステム「BlueField-4 STX Storage Rack」、データセンター間をつなぐ「Spectrum-6 SPX Ethernet Rack」が用意されている。

Vera CPU Rackは、AIエージェントを扱う際にCPU上で実行する処理の速度を高めるために設計された、Veraを256個組み込んだラックシステムだ。Veraは、新規にカスタム設計したプロセッサコア「Olympus」を88個搭載し、176のマルチスレッド処理が可能だ。コア当たりのL2キャッシュや統合L3キャッシュも強化しており、現行のGraceからAIエージェントのCPU側に求められる、SQLクエリ、コードのコンパイル、Python実行、サンドボックス実行などの処理性能を大幅に高めた。Vera CPU Rackとしては、Graceと比べて約2倍の処理性能となっている。

データセンターにおけるAIエージェントの処理性能を高めるためにはストレージの役割も重要だ。一般的なストレージシステムでは、AIエージェントの処理に必要なデータへのリアルタイムアクセスができず、コンテキストを保持するためのワーキングメモリも持たない。そのため、ストレージシステムがボトルネックになって、GPUの利用率が低下する可能性がある。

BlueField-4 STX Storage Rackは、DPUのBlueField-4をベースに、CPUのVera、ネットワークインタフェースICのConnectX-9を組み合わせて構築するストレージラックシステムのレファレンスで、消費電力1W当たりのストレージ処理性能が4倍、コンテキストメモリのTPSが5倍などとなっている。レファレンスとある通り、NVIDIAが直接提供せず、パートナーがストレージシステムを提供することになる。

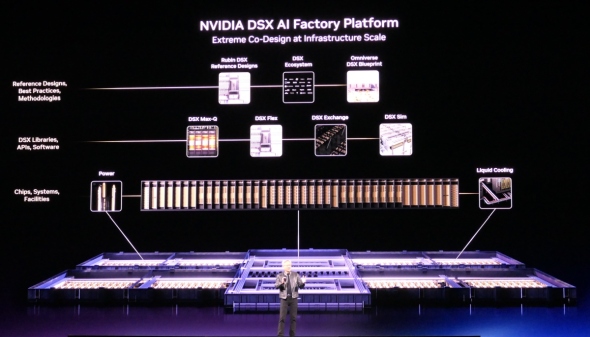

なお、これら5つのラックシステムによって構成する、AIファクトリーのレファレンスとなる「Vera Rubin DSX」も発表している。Vera Rubin DSXの構築に必要なソフトウェアスタックはオープンソースとなっており、AIファクトリーを構築したユーザー企業やパートナーが広く活用できるようになっている。また、Vera Rubin DSXと完全互換性を有する形でデジタルツインのプラットフォーム「Omniverse」を実装できる「Omniverse DSX Blueprint」も発表している。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

NVIDIAのGPUは「Blackwell Ultra」から「Rubin」へ、シリコンフォトニクスも採用

NVIDIAのGPUは「Blackwell Ultra」から「Rubin」へ、シリコンフォトニクスも採用

NVIDIAは、米国サンノゼで開催中のユーザーイベント「GTC 2025」の基調講演において同社のGPUアーキテクチャのロードマップを発表した。 NVIDIAの新アーキテクチャ「Blackwell」は生成AI特化、汎用人型ロボットにも適用

NVIDIAの新アーキテクチャ「Blackwell」は生成AI特化、汎用人型ロボットにも適用

NVIDIAは「GTC 2024」において、新たなGPUアーキテクチャ「Blackwell」を発表。AI処理性能で前世代アーキテクチャ「Hopper」の5倍となる20PFLOPSを達成。生成AIの処理性能向上にも注力しており、Hopperと比べて学習で4倍、推論実行で30倍、消費電力当たりの処理性能で25倍となっている。 NVIDIAが生み出す半導体産業の“正の循環”、AIフィジックスが新たな原動力に

NVIDIAが生み出す半導体産業の“正の循環”、AIフィジックスが新たな原動力に

AI技術の進化をけん引するNVIDIAが、半導体技術の進化にも大きな影響を与えようとしている。同社のティム・コスタ氏によれば、AIエージェントとフィジカルAIに加えて、これらに次ぐ第3のAIともいえる「AIフィジックス」が重要な役割を果たすという。 NVIDIAは組み込みAIボードもBlackwell世代へ、2070TFLOPSの「Jetson AGX Thor」

NVIDIAは組み込みAIボードもBlackwell世代へ、2070TFLOPSの「Jetson AGX Thor」

NVIDIAは2025年8月25日、組み込みAIボード「Jetsonシリーズ」の最新製品となる「NVIDIA Jetson AGX Thor」を発表した。AI処理性能はFP4で2070TFLOPSで、これは現行の「NVIDIA Jetson AGX Orin」の7.5倍に達する。 NVIDIAがフィジカルAIのオープン展開を加速、自動運転向けで「Alpamayo」を公開

NVIDIAがフィジカルAIのオープン展開を加速、自動運転向けで「Alpamayo」を公開

NVIDIAは「CES 2026」の開催に合わせて、フィジカルAI(人工知能)の代表的なアプリケーションである自動運転技術とヒューマノイド向けのオープンソースAIモデルを発表した。 NVIDIAとダッソーがCEO対談 産業AI基盤構築で戦略的パートナーシップ締結

NVIDIAとダッソーがCEO対談 産業AI基盤構築で戦略的パートナーシップ締結

ダッソー・システムズは年次イベント「3DEXPERIENCE World 2026」において、NVIDIAとの戦略的パートナーシップを締結したことを発表。同イベントの中で、ダッソー・システムズ CEOのパスカル・ダロズ氏と、NVIDIA 創業者 兼 CEOのジェンスン・フアン氏が対談形式で協業の背景や狙いについて語った。