スマートファクトリーとAI、ChatGPT-4oの衝撃と可能性:工場スマート化の今(2/3 ページ)

世界の産業界でIoT(モノのインターネット)やロボット、AI(人工知能)などを活用したスマートファクトリー化が進んでいる。その流れの中で何が起きているのか、Beckhoff Automation(日本法人) 代表取締役社長の川野俊充氏に話を聞いた。

ファウンデーションモデルを活用したベッコフの新機能

MONOist ベッコフとしてはAIに関してどのような展開を考えているのでしょうか。

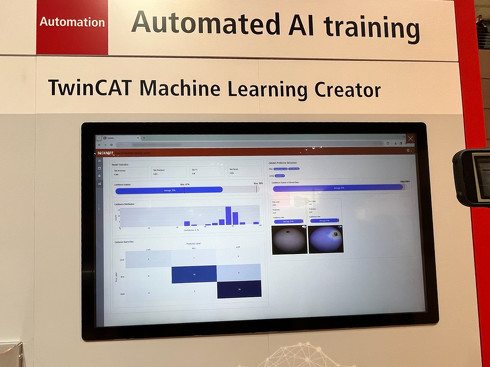

川野氏 「ハノーバーメッセ(HANNOVER MESSE) 2024」(ドイツ・ハノーバー/2024年4月22〜26日)では「TwinCAT Machine Learning Creator」を発表したが、これはベッコフが用意した外観検査用のファウンデーションモデル(基盤モデル)を提供することで、これまでデータサイエンティストが行っていたようなデータの前処理などが要らなくなるものだ。どの画像が正解か、不正解かのラベル付けは必要だが、それらを与えれば後は自動で行い、どの部分を見て推論しているかも明示される。

ファウンデーションモデルというのは、事前に大量のデータで学習を済ませてあるAIモデルで、例えばロボットの行動生成なら、追加の学習をほとんどしなくても、人が今までティーチングをしていた動作をロボットが自動でできるようになる。

著名なロボットAI研究者のPieter Abbeel氏が教え子とともに設立した米国のCovariantはファウンデーションモデルを使ったロボット向けAIを開発していて、例えばTシャツなどの不定型物、柔軟物のバラ積みピッキングが事前学習なしでできる。テキストや画像などを入力して、「これをピッキングして」といえば、出力として実際にロボットがタスクを実行する。うまくできなければアドバイスを求めてきて、「倒してからつかんでごらん」と言うと実際に倒してつかめるようになる。

例えばハンドが変わったり、無関係な部品が来たりしたらまだ難しいとは思うが、もはや完全に人のようだ。

人がやらなければいけない現場の作業自体はまだ残るかもしれないが、将来的に現場で人が判断をしなければいけないような仕事は、訓練が済んだAIを活用した方がよっぽどコストが安いということになるのではないか。

10年程前にインダストリー4.0に関する講演に呼ばれた際によく使っていたスライドがある。当時はこれを見せてもあまり実感を持って捉えてもらえなかったが、10年前にはそれこそ夢物語だった世界がいよいよ現実になろうとしている。

人と機械が対話をしながら協力して、時にはロボットが助けを求めてくるような、これまでSFの中のだけにあった世界が現実になろうとしている。そう確信できるところまで来ている。これらをイメージした上で、これからのスマートファクトリーを考えなければいけない。

ChatGPTを組み込んだTwinCAT Chat

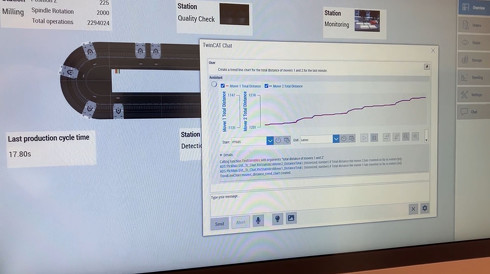

今回のハノーバーメッセでは、PLC言語の開発環境にChatGPTを組み込んだ「TwinCAT Chat」を使ったデモも発表した。動作中の装置から必要な意味合いを解釈するプログラムを生成できることでき、例えばリニア搬送システム「XTS」の2つの可動子の距離を常にモニタリングできるようなグラフを書いてほしいと依頼すると、必要なプログラミングをその場で行い、グラフとして見せたり、設置してあるカメラからどんなものが見えているのかを解説したりすることができる。状態監視をする対象を止める必要もない。

これは現場の画像やセンサーのデータを全てクラウドに送って分析、解釈している。音声認識と音声合成を使えば、普通に人と対話するようにできるようになる。

われわれが開発しているモジュール式ロボットシステム「ATRO」も、組み立てるまで身体形状が決まらないため人がプログラミングするのは難しいかもしれない。だが、ATROにAIを組み合わせれば、組み立てた後にロボットと対話しながら、具体的な作業の指示を出したり、必要なモジュールを足したりして、プログラミングができなくてもロボットの行動生成ができるようになるだろう。

Copyright © ITmedia, Inc. All Rights Reserved.