クアルコムのSoCに独自LLMを組み込み、エッジ生成AIでIoT事業の成長を加速:人工知能ニュース(2/2 ページ)

サンダーソフトジャパンは、中国サンダーソフトと米国クアルコムの両社が合弁でSOM製品を中心としたIoT向けプラットフォームを展開しているサンダーコムの事業について説明した。

独自開発の「Rubik LLM」をエッジデバイスに組み込み

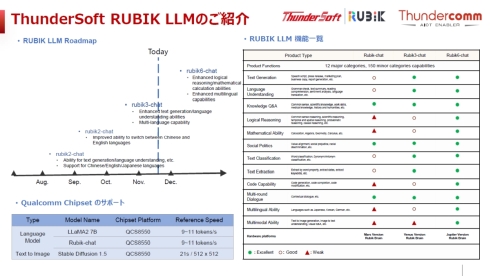

サンダーコムの事業展開を次のステップに進めるために取り組みを加速させているのがエッジデバイスにおける生成AIの活用である。まず、サンダーコムの事業展開でソフトウェア関連を支えるサンダーソフトは「Rubik LLM」と呼ぶLLMを独自開発しており、並行してクアルコムのチップセットで動作もサポートしている。LLMの規模も、70億を皮切りに300億まで拡大しており言語は英語と中国語、日本語に対応している。今後も500億、700億と規模拡大を続けていく方針だ。

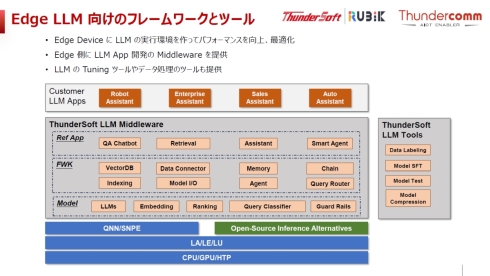

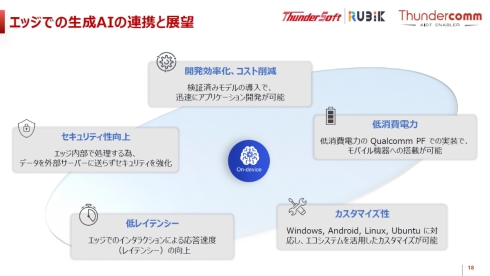

そして、このRubik LLMをサンダーコムのSOMに組み込むためのフレームワークとツールを用意している。エッジでの生成AIの利点としては「エッジ内部で処理することによるデータセキュリティ性の向上」「低レイテンシ」などがあり、それを検証済みのRubik LLMによって効率的に導入でき、クアルコムのSoCに低消費電力性能が得られ、サンダーコムが得意とするAndroid、Linux、Ubuntu、Windowsといったカスタマイズ対応も可能になるという。

会見ではTurboX C8550の開発キットである「TurboX C8550 Development Kit」を用いて、70億パラメータのRubik LLMを組み込んで実際に動作させるデモンストレーションを披露した。TurboX C8550のメモリ容量は12GB(LPDDR5x)であり、そのまま70億パラメータのRubik LLMを組み込むことは難しいが、量子化などの手法を用いてモデルを圧縮することでエッジデバイスでの動作を可能にしている。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

エッジでも生成AIは可能、マクニカが「Jetson AGX Orin」に日本語LLMを実装

エッジでも生成AIは可能、マクニカが「Jetson AGX Orin」に日本語LLMを実装

マクニカは、「EdgeTech+ 2023」において、NVIDIAの組み込みAIボード「Jetson AGX Orin」を用いてエッジデバイス上で生成AIモデルを動作させるデモを披露した。 Jetson Orinの生成AI処理性能はXeonの1.7倍、NVIDIAが“史上最大”の機能拡張へ

Jetson Orinの生成AI処理性能はXeonの1.7倍、NVIDIAが“史上最大”の機能拡張へ

NVIDIAは、組み込み機器向けのエッジAI開発プラットフォームである「Jetson」について、生成AIへの対応を含めた大幅な機能拡張を行うと発表した。 Metaの大規模言語モデルを活用してエッジデバイス向け生成AIを開発

Metaの大規模言語モデルを活用してエッジデバイス向け生成AIを開発

MediaTekは、Metaの大規模言語モデル「Llama 2」を同社の最新APUやNeuroPilot AI Platformと連携させ、エッジデバイス用AIアプリケーションの開発に活用する。 性能2PFLOPSでコスパはGPUの10倍、LeapMindが大規模モデル対応のAIチップ開発へ

性能2PFLOPSでコスパはGPUの10倍、LeapMindが大規模モデル対応のAIチップ開発へ

LeapMindはが生成AIをはじめとする大規模AIモデルの学習と推論を高速化する新しいAIチップの開発を開始したと発表。演算性能目標は2PFLOPSで、同等性能のGPUと比べて10倍のコストパフォーマンスを目指す。 エッジAI開発をとにかく簡単にする開発基盤、“俺の嫁召喚装置”にも貢献

エッジAI開発をとにかく簡単にする開発基盤、“俺の嫁召喚装置”にも貢献

サンダーソフトジャパンは2018年10月26日、東京都内で記者会見を開催し、AI(人工知能)機能を提供するIoT(モノのインターネット)製品の開発支援プラットフォームとして、「Thundercomm TurboX」(以下、TurboX)を日本市場向けに提供開始すると発表した。 中国のサンダーソフトは日本市場を引き続き重視、組み込みAI分野で200億円投資

中国のサンダーソフトは日本市場を引き続き重視、組み込みAI分野で200億円投資

中国の組み込み開発ベンダー・サンダーソフトは創業から10周年を迎えた同社の事業戦略について説明。売上高の30%弱を占める日本市場を引き続き重視しており、日本拠点内に独自の研究開発組織を立ち上げ、組み込みAI(人工知能)やエッジコンピューティングの技術開発を行える体制を目指す。