MaaS時代のクルマは視線もインタフェースに、音声と視線認識技術を握るCerence:モビリティサービス

自動運転やMaaSの社会実装が進む中、クルマが提供する体験価値も変革が求められている。音声認識に強みを持つ車載ソフトウェアベンダーのCerenceもクルマの新たな価値を提案する企業の1社だ。同社は視線検知と音声認識を組み合わせ、乗員とクルマの双方向コミュニケーションを実現するインタフェースを開発している。

自動運転やMaaS(Mobility-as-a-Service:移動のサービス化)の社会実装が進む中、クルマが提供する体験価値も変革が求められている。音声認識に強みを持つ車載ソフトウェアベンダーのCerenceもクルマの新たな価値を提案する企業の1社だ。同社は視線検知と音声認識を組み合わせ、乗員とクルマの双方向コミュニケーションを実現するインタフェースを開発している。

Cerenceは米国Nuance Communicationsの車載ソフトウェア事業がスピンオフし、2019年10月1日に設立された。同社はNuanceとの資本関係を解消し、NASDAQに上場する公開企業だ。グローバルに23拠点を持ち、全従業員は1300人。ヘッドユニットに組み込まれる車載ソフトウェアや、車載ソフトウェアとつながるクラウドソリューションなどを自動車メーカーやサプライヤーに提案する。

Cerenceの技術を搭載したクルマはこれまでに累計2億8000万台出荷されたとし、2019年度の売り上げ見込みは、3.08億〜3.1億米ドル(約335億〜337億円)に達するという。また、2019年第1四半期に出荷された自動車の約54%で、同社の車載ソフトウェアまたはクラウドソリューションが採用された。2023年にはグローバル自動車市場における同社車載ソフトウェアの搭載率が50%に拡大すると予測し、1台当たりの売り上げ伸張と新興国を中心としたマーケットシェア獲得を目指す。

日本法人のCerence Japanが公開した「Cerence Multi Modal PoC」のデモカーは、同社の野心的な成長目標を裏付けるものだ。Cerence Multi Modal PoCは、視覚と聴覚など複数の感覚を用いてコミュニケーションを行う「マルチモーダルインタフェース」をクルマに実装するコンセプトだ。

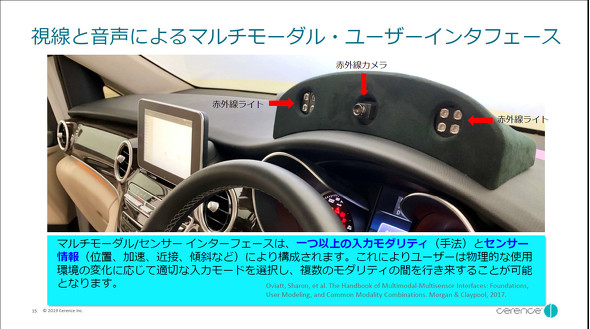

デモカーは運転席のダッシュボード上に赤外線カメラと赤外線LEDを備え、ドライバーの視線および顔の向きを捉える。また、音声認識用にマイクも設置している。ドライバーの視線と音声を組み合わせたユーザー入力、および車載センサーによる車両情報や周囲環境情報を組み合わせ、クルマはドライバーが求める最適な応答を返す。

Cerence Japanでシニアセールスエンジニアリングマネージャー(兼)プリンシパル・マーケティングマネージャーを務める村上久幸氏は「スマートフォンの登場前後でHMI(Human Machine Interface)やクルマのインタフェースも大きく変わった。スマートフォンに慣れたユーザーに対して、クルマのインタフェースも最適化する必要があるのではないか。音声やタッチパネル、物理スイッチ、空間でのジェスチャーなど、状況に応じて最適な入力が行えるのがクルマにおけるマルチモーダルだ」と述べる。

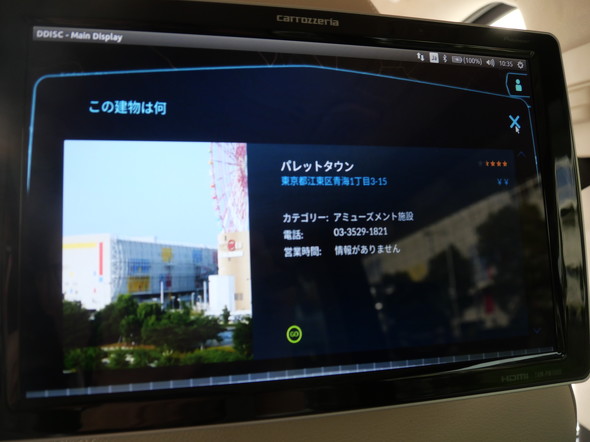

報道陣向けに披露したデモは、ドライバーが視線を向けて発した質問に対してクルマが応答するというもの。建物に視線を向け「あの建物は何?」とドライバーが質問するとクルマが施設名を応答したり、「あの施設の電話番号を教えて」とドライバーが発すると当該施設の電話番号が示され、そのままシームレスに電話を掛けたりできる。

従来のカーナビゲーションシステムにおける近隣施設のPOI(Point Of Interest)設定は、自車位置を中心とした同心円状に検索する場合が多い。この設定では、既にクルマが通り過ぎた地点にある施設が選択されることもあり、非効率な経路を提案されることになる。

Cerence Multi Modal PoCにおける近隣施設のPOI設定は、「ドライバーの視界に入ったところを分析する」(村上氏)という点が特徴だ。Cerenceは独自に3次元の市街地モデル構築を進めており、同モデルと自車位置からドライバーの視界内にどのような施設が入っているかリアルタイム分析を行う。ドライバーが発声し始めた瞬間のタイムスタンプ情報を基に、赤外線カメラから得られた3D視線検知ベクターと視界内市街地モデルを突き合わせ、どの施設にPOIを設定するか判定する。

デモカーは音声処理、視線認識、3次元市街地モデルとの突き合わせ、HMI描画を3台のノートPCで動作させ、システム処理をローカルで完結させている。一方、今後登場が予定される商用システムは、クルマで取得した音声および視線情報をクラウドに送信、処理し、応答内容をクルマに返すことを想定している。ローカル処理することによるシステムコスト増加や市街地モデル陳腐化を防ぐ狙いだ。クラウド利用で課題となるレイテンシも「1〜2秒程度」(同社担当者)に抑えられるという。

3次元市街地モデルの開発は現在、オープンストリートマップを基に行っているが「商用向けにはHEREが提供する地図データがベースとなる可能性がある」(村上氏)としている。今後、対応地域の拡充や市街地モデルの更新なども継続して行う方針だ。また、村上氏は新たなビジネスモデルとして広告を挙げ、「ドライバーへの応答に広告主を優先して回答するといったこともできる」と話した。

また、車外環境に加えて車両装備への視線検知にも対応する。窓に視線を向けて「あっちの窓を開けて」とドライバーが発生すると視線を向けたウインドウが開いたり、HMIに表示された内容に視線を向けて操作したりする機能も検討しているという。視線による車両装備の操作は初めて乗車するクルマであっても直観的にできるため、「MaaS時代のクルマには非常に相性が良い技術」と同社担当者は説明する。

同ソリューションはPoC(概念実証)の段階で、現在はグローバルで自動車メーカーやサプライヤーに提案活動を行っているという。村上氏は「既に高い関心を示しているメーカーがある。欧州で先行している状況だ。Cerence Multi Modalを活用した市販車もそう遠くはない未来に登場するだろう」と述べる。

Copyright © ITmedia, Inc. All Rights Reserved.

関連記事

音声認識に視線や感情、眠気検知を組み合わせ、より柔軟なエージェントに

音声認識に視線や感情、眠気検知を組み合わせ、より柔軟なエージェントに

Nuance Communications(ニュアンス)は、消費者向けエレクトロニクス展示会「CES 2019」(2019年1月8〜11日、米国ネバダ州ラスベガス)において、カメラによる視線検知と音声認識技術を組み合わせた開発中の新機能を披露した。開発技術は、POI(Point of Interest)検索やストリーミングサービス、リアルタイムな情報を得る場合にはクラウド連携が必要だが、それ以外については車載情報機器側で処理が終えられるという。 ドライバーモニタリング用カメラの用途さまざま、脈拍測定から音声認識まで

ドライバーモニタリング用カメラの用途さまざま、脈拍測定から音声認識まで

三菱電機は「第46回東京モーターショー2019」(会期:2019年10月24日〜11月4日、東京ビッグサイト他)において、MaaS(Mobility-as-a-Service、自動車などの移動手段をサービスとして利用すること)用の車両向けの乗員センシング技術を発表した。 笑いの測定方法を開発、笑いが緊張・不安などを改善することを実証

笑いの測定方法を開発、笑いが緊張・不安などを改善することを実証

近畿大学は、笑いを医学的に検証する共同研究を実施し、笑いの測定方法を開発するとともに、笑いがもたらす身体的および心理的影響を解析した。 機械学習で車室内の雑音をシャットアウト

機械学習で車室内の雑音をシャットアウト

三菱電機は研究開発成果披露会で、車内音声通話の雑音除去技術を展示。機械学習を利用しており、自動車内でハンズフリー通話を行う際などに走行音やワイパー音といった雑音を約96%除去できるという。 シートベルトで眠気や体調悪化を検知、損保ジャパン日本興亜とベンチャー

シートベルトで眠気や体調悪化を検知、損保ジャパン日本興亜とベンチャー

損害保険ジャパン日本興亜とPOSH WELLNESS LABORATORYは2019年3月13日、シートベルトカバー型デバイスを用いてドライバーの眠気や体調を検知するサービスの提供に向けて、実証実験を開始したと発表した。 “使えない”クルマの音声認識が“使える”ようになる日は近い

“使えない”クルマの音声認識が“使える”ようになる日は近い

音声認識システム開発の大手・Nuance Communications(ニュアンス)がシリコンバレーで最新技術説明会を開催。車載器とクラウドの双方で音声認識処理を連携して行う「ハイブリッド」方式のデモを行った。さらに、人工知能技術の活用により、Appleの「Siri」をはるかに上回るレベルの音声認識技術も開発中だという。