マイクロソフトがUIの進化を語る、NUIの発展を牽引するKinectとMSRの研究事例:ユーザーインタフェース最新動向(2/3 ページ)

マイクロソフトのモーションセンサーデバイス「Kinect for Windows センサー」が発売されてから間もなく1年がたとうとしている。発売当初から、次世代のユーザーインタフェース「NUI」を手軽に実現できるデバイスとして注目を集め、既に多くの開発プロジェクトが始動している。本稿では、日本マイクロソフトが披露したKinect for Windows センサーを活用した事例およびMicrosoft Researchによる最新の研究成果を紹介する。

マクロソフトが考えるNUI

なぜ、こんなにもKinect for Windows センサーが注目されているのか。それは、デバイスとしての“手軽さ”に他ならないだろう。

Kinect for Windows センサーと「Kinect for Windows SDK」により、ユーザーは最先端のインタフェースとして注目されているNUIを備えたWindowsアプリケーションを自由に開発・販売(Kinect for Windows センサーは商用利用が許可されている)できるようになった。Xbox版のヒットのおかげもあって、発売当初からデバイスとしての認知度が高く、2万円台でNUIを実現するための豊富なセンサーを搭載した装置が入手できるというのは、個人はもちろんのこと、企業などに属するエンジニアにとっても大きな魅力である。

ただ、ソフトウェア技術をなりわいとするマイクロソフトにとって、Kinect for Windows センサーは、誰でも簡単に使用できる“パッケージ品(箱から出してすぐに使える製品)”に他ならない。彼ら自身が本当に目指しているのは、ソフトウェアの力で、CUIやGUIに次ぐ、新しいユーザーインタフェース、NUIの時代をけん引することだ(MS-DOSやWindowsを生みだしたように)。

当然、NUIの実現には、センサーデバイスの存在は欠かせないが、NUIによる“コンピュータとの自然な対話”を実現するためには、「ビッグデータの活用が不可欠。あらゆるデータを分析・解析し、そこからある法則・ルールを見つけ出して、それをアルゴリズム化して、ソフトウェアに落とし込むことが必要だ。人工知能の研究における『機械学習』の実現。つまり、人間の学習能力と同じようなことを、コンピュータで実現できるようになる必要がある」(加治佐氏)という。

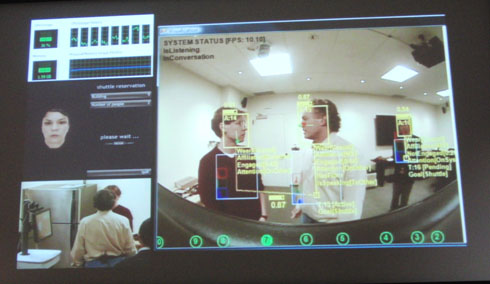

こうしたNUIの研究を行っているのが、マイクロソフトの基礎研究部門である「Microsoft Research(MSR)」だ。記者会見では、MSRの最新の取り組みとして、フリーハンドでデバイス操作などが行える装着型デバイス「Digits」、米マイクロソフト本社に試験導入されたビル間移動向け「シャトルバス手配システム」、そして、2013 International CESで披露されたKinect for Windowsセンサーとプロジェクターを活用した「IllumiRoom」が紹介された。

「シャトルバス手配システム」。米マイクロソフト本社で試験運用されたもので、社員が広大な敷地を移動する際に利用するシャトルバスの手配を、アバター(CG)との会話で実現する。ここにNUI(音声認識や音声合成、人物追跡・行動分析など)が生かされている

Copyright © ITmedia, Inc. All Rights Reserved.