急成長中の中国ヒューマノイド大手AgiBotの技術戦略:ロボットイベントレポート(2/3 ページ)

菱洋エレクトロとリョーサンがセミナー「“ロボットが自分で学ぶ未来を体験” 〜実機と仮想環境が融合する次世代のロボット技術〜」を開催。本稿では、同セミナーに登壇した中国のヒューマノイド企業AgiBotで東アジア事業本部長を務める張赫氏の講演をレポートする。

現場で進化させられる基盤モデル「GO-1」はVLAを発展させたViLLA

100台のロボットによる100万件以上(合計43.8TB)の実機軌跡データで構築されたデータセットが「AgiBot World」である。AgiBotは2025年3月、ヒューマノイド用基盤モデル「GO-1(Genie Operator-1)」を公開した。「GO-1」はVLAを発展させたViLLA(Visual-Language-Latent-Action)アーキテクチャを採用しており、視覚情報と言語指示から直接行動を出力するのではなく、「潜在アクション(Latent Action)」という抽象的な中間表現を介して行動を出力する。

ViLLA は階層構造となっており、VLM(視覚言語モデル)と複数の専門家(Expert)モデルを統合し入力に合わせて使い分けるMoE(Mixture of Experts)の2層で構成されている。VLMは画像入力と自然言語命令を理解する。一方、MoEは動画データから行動パターンを理解する「Latent Planner」、拡散モデルを使って実際のアクションを担当する「Action Expert」から構成される。このモデルを大規模データで学習させることで、データ効率と汎化性能を向上させているとされている。

AgiBotは、膨大なデータで事前学習された「GO-1」をベースに、顧客の小規模データを使って事後学習することでロボットに最適な作業をさせられるとしている。AIモデルをオンラインで継続更新するためのフレームワークが「SOP(Scalable Online Post-training)」である。これは「1台の経験を複数台にシェアできる」仕組みであり「数時間で複雑タスクの実行性能を向上させる」、すなわち「導入後にAIモデルを進化させることができる」と紹介した。張氏は、紙製で変形する箱をひたすら組み立てたり、タオルの畳み作業を安定精度ほぼ100%で36時間連続稼働できたりしたと紹介した。

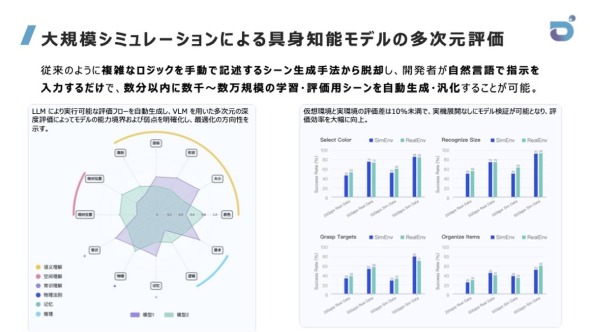

LLMで訓練シナリオを自動構築するシミュレーター「Genie Sim 3.0」

実機データを補完するのがシミュレーターである。「CES 2026」で公開されたオープンソースの「Genie Sim 3.0」はロボット開発に特化したシミュレーションプラットフォームである。NVIDIAのIsaac Simをベースとしており、3DGSやDiffusionのようなフォトリアルな3D再構成技術と物理演算を融合することで、視覚的リアルさと実際の物理精度や光学特性の両立を実現した。5000以上のデジタルアセットや1万時間以上の合成データセットが提供されている。

最大の特徴は、LLM(大規模言語モデル)を活用して自然言語指示を入力するだけでロボットの訓練シナリオを自動構築できる「GenieSim Assistant」である。これによって学習/評価用シーンごとに複雑なロジックを手動で記述する必要がなくなった。評価についても単純な成功率だけではなく、総合的な分析を自動で行うことができる。また、AgiBotが収集した実データを組み込むことで5%未満という極めて低いSim2Real誤差を実現しているとされている。

Copyright © ITmedia, Inc. All Rights Reserved.