非接触操作によるUIは万能か? NUI実現における注意点:モーションセンサーで組み込み機器はどう変わる?(2)(1/3 ページ)

モーションセンサーデバイスとNUI(Natural User Interface)の基礎、各センサーデバイス製品の特徴などを詳しく解説する連載。今回は、モーションセンサーデバイスのユーザーインタフェース(UI)としての活用例や、NUIを実現する際の注意点について紹介する。

前回「モーションセンサーデバイスとは何か」では、“自然かつ直感的な動作”で機器の操作を行う「ナチュラルユーザーインタフェース(NUI:Natural User Interface)」の概念を解説し、NUIを実現するデバイスとして「モーションセンサーデバイス」の活用が注目されている点を紹介しました。

連載第2回となる今回は、モーションセンサーデバイスのユーザーインタフェース(UI)としての活用例や、筆者の経験から得たNUIを実現する際の注意点について解説します。

操作の手段としての活用

まずは、従来のキーボードやマウス、タッチパネルを使った操作の代替手段としての利用――つまり、UIとしての活用例――を紹介します。

モーションセンサーデバイスの最大の特長は、身体の動きやジェスチャーで「非接触操作」を実現できる点にあります。この特長を生かし、現在、医療分野や飲食店舗内における機器操作など、特に衛生面での配慮が求められるシーンでの活用が注目されています。この事例として有名なのが、手術室内で「Kinect」を活用した医療支援システム「Opect」(日本マイクロソフトがニチイ学館、東京女子医科大学と共同で開発したシステム)です。

これは、手術中に執刀医が「手をかざす」「手を振る」などのジェスチャーでディスプレイ上に表示された画像を操作できるシステムで、非接触操作による衛生面の向上、直感的なUIを実現しています。

その他、UIとしての活用例

この他にも、ジェスチャー認識の機能が家庭用TVに搭載され、リモコン操作(音量の調整や選局など)の代替手段として活用されているケースや、リビングのカーテンの開閉、照明のON/OFFなどに採用されている例もあります。

また、既に市販されているPCやタブレット端末/スマートフォンの中にも、タッチパネルと併用して、ジェスチャーによる操作を実現しているモデルもあります。

ジェスチャー操作は子ども向けの玩具にも

少し変わったところでは、子ども向けの玩具にジェスチャー操作機能が採用されている例があります。

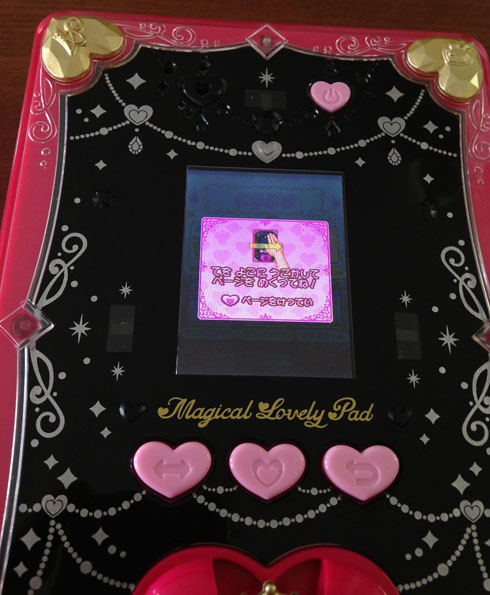

子ども向けアニメ番組『ドキドキ! プリキュア』(東映アニメーション)の劇中で、主人公のキャラクターが扱う武器「マジカルラブリーパッド」がそれです。筆者は、バンダイから発売されているマジカルラブリーパッドを愛娘のため(!?)に、1台購入したのですが、彼女が寝ている隙に分解して、中の構造をのぞいてみました。

マジカルラブリーパッドには、3つの簡単な赤外線センサーが搭載されているだけなのですが、パッドの上で「手を振る」「ハートを描く」「両手を開く」など、実に14種類ものプリセットされたジェスチャーを認識することができます。

このような子どもの玩具にもジェスチャー操作が採用されているとは……。すごい時代になったものですね。実際、使用する子どもにとって「触らずに動く」という体験は、まさに劇中の魔法そのものといえるのかもしれません。

| 参考リンク: | |

|---|---|

| ⇒ | バンダイ - マジカルラブリーパッド |

非接触操作によるUIは万能か?

さて、モーションセンサーデバイスのUIとしての活用例を幾つか紹介しましたが、どのような場面においても「非接触/ジェスチャー操作」が最適かというと、実はそうではありません。ジェスチャー操作よりもタッチパネルを使って操作した方が使いやすいケースもありますし、どのような場面でも“使える”というわけではないのです。

医療分野での活用事例のように、「触れない/触りたくない」といった場合、非接触操作は大きな効果を発揮します。あるいは、子ども向けの玩具の例のように「触らなくても動く」といった、新しさや面白さを狙ったものも適しているかもしれません。

モーションセンサーデバイスのUIとしての活用は、“他の代替手段に対する優位性をきちんと説明できること”が大切です。タッチパネルによるUIと比べて何が優れているか? そもそも非接触操作にするメリットがあるのか? などを踏まえた上で、ジェスチャーUIの採用を検討するとよいでしょう。

Copyright © ITmedia, Inc. All Rights Reserved.