産総研のフィジカルAIプロジェクトに迫る 10万年ギャップを超えろ!:組み込みイベントレポート(4/5 ページ)

産業技術総合研究所(産総研)が「フィジカル領域の生成AI基盤モデルに関する研究開発」プロジェクトについて解説するウェビナーを開催。同プロジェクトを構成する6つのグループから最新の研究成果が報告された。

継続事前学習による推論型LLMの構築

産総研から日本語に強いLLMとして「Swallow」が最初に公開されたのは2023年12月だ。その後も発展を続けており、2026年3月時点で、ダウンロード数は241万、モデル数は132、データセットダウンロード数は55万、データセットの数は19に達している。

東京科学大学 情報理工学院情報工学系 教授の岡崎直観氏は、主に2026年2月に発表された深い推論に対応した「GPT-OSS Swallow」と「Qwen3 Swallow」について紹介した。

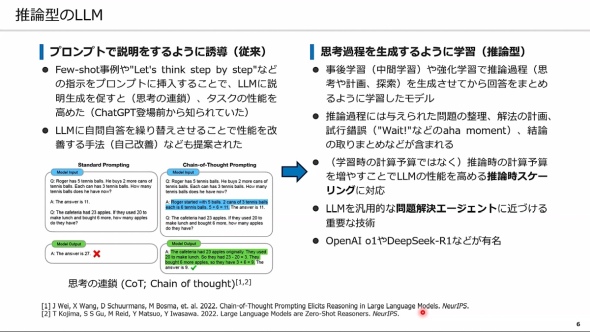

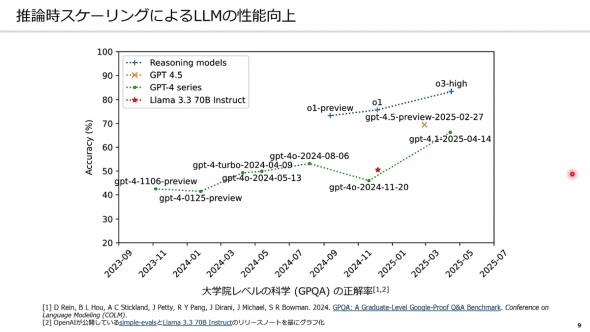

推論型LLMには「OpenAI o1」や「DeepSeek-R1」などが知られている。「Chain of Thought(思考の連鎖)」を行うことでタスクの成功を高めることができることそのものは以前から知られていたが、推論型LLMは、その思考過程を生成するように事前に学習させておくモデルである。推論型モデルは推論時の計算リソースを増やすことでLLMの性能を高めることができる。岡崎氏は、推論型LLMが実際に数学の難しい問題を解く過程を示して紹介した。推論型LLMの登場により、高難易度のベンチマークにおいて飛躍的な性能向上が見られている。

ではGPT-OSS SwallowとQwen3 Swallowは、どのようにモデルを構築したのだろうか。まず、CPT(継続事前学習)によって日本語の知識やコーディング、数学の知識などを身に付けさせる。それをSFT(教師ありファインチューニング)によって対話能力を身に付けさせ、RLVR(検証可能な報酬に基づく強化学習)を行って思考力を調整している。CPTを単純に行うと非推論型モデルに戻ってしまうので、CPTの後にはSFTが必要となるのだという。このときに推論過程付きの合成データを学習に活用している。それぞれのステップの詳細についても紹介されたがここでは割愛する。

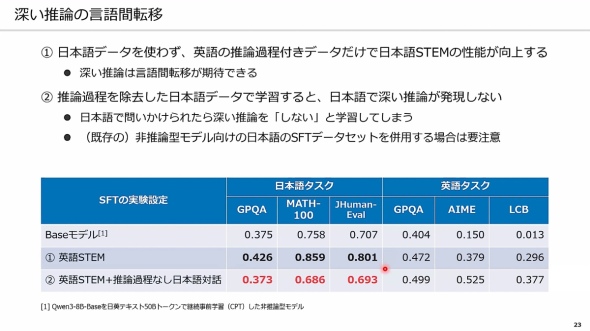

Qwen3 SwallowはオープンなLLMの中では日本語タスクで最高性能を示している。GPT-OSS SwallowはオープンなLLMの中では日本語と英語のタスクの両方で最高性能となっている。深い推論の言語間転移を見ると、言語間転移が期待できること、また推論過程を除去した日本語データで学習すると日本語で深い推論が発現しないことが分かったという。

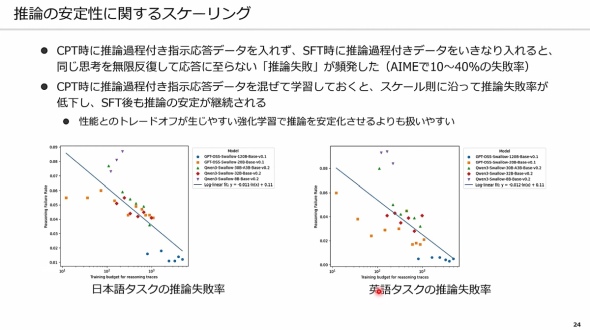

また推論の安定性に関しては、推論過程付き指示応答データを混ぜて学習しておくと、スケール則に従って推論失敗率が低下し、教師ありファインチューニング時にも推論の安定が継続されることが分かったという。

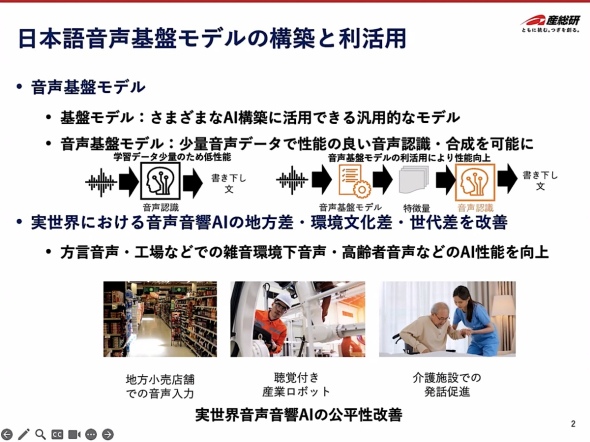

少量データ活用のための日本語音声基盤モデルの構築

産総研 人工知能研究センター 知的メディア処理研究チーム 研究チーム長の深山覚氏は、産総研で構築している日本語音声基盤モデルと、音声認識、音声感情認識などへの応用事例を紹介した。

音声基盤モデルは、少量音声データから性能の良い音声認識/合成を可能にする技術である。産総研では、実世界における音声音響AIの地方差(≒方言)、環境文化差、世代差などの課題を改善することを目指している。例えば、地方小売店での音声入力、工場でも使える聴覚付き産業ロボット、音声インタフェースを持つ高齢者介護ロボットの実現などに貢献することを目標としている。これらの他、外国語訛りのある音声の音声認識性能の改善への活用などにも取り組んでいる。話者の属性に由来する性能差を抑制する音声処理、特に少量データに由来することで性能が低くなってしまうタスクについて、音声基盤モデルを使って改善することを目指しているという。

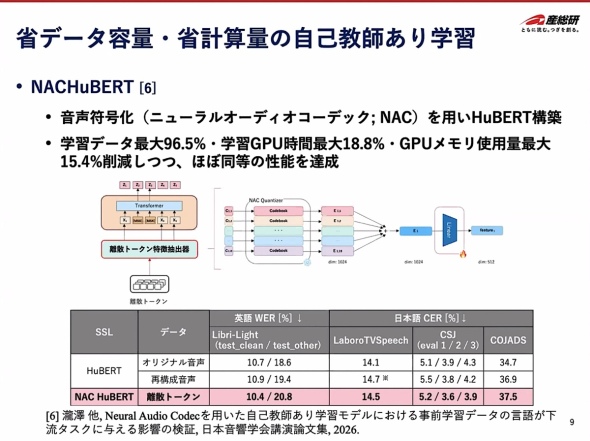

音声基盤モデルは自己教師あり学習モデルを使って構築できる。これは深層学習モデルの中間層表現が音声処理の複数タスクに活用可能であることに由来している。その源流は言語データの自己教師あり学習にある。深山氏は「BERT」の考え方を音声に適用したのが「vq-wav2vec」であること、さらにそれを改良した「wav2vec 2.0」や「HuBERT」についても紹介した。産総研ではHuBERTをさらに少データで学習させる手法を開発し「NACHuBERT」を構築した。学習データを最大96.5%、GPU処理時間を最大18.8%削減しつつ、ほぼ同じ性能を達成した。

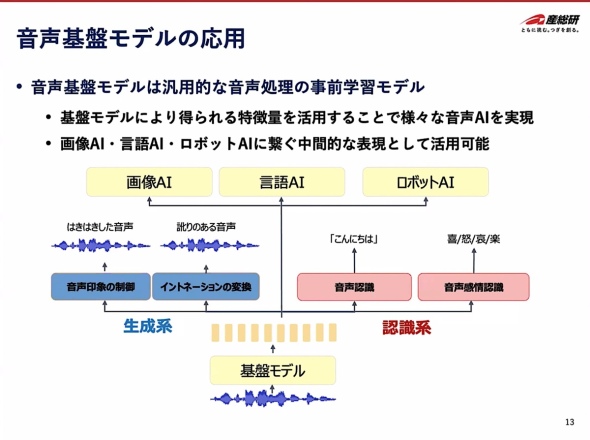

これらの知見を基に開発されたのが2025年3月公開のいざなみとくしなだである。いざなみはwav2vec 2.0、くしなだはHuBERTのアーキテクチャで構成されている。少量の日本語音声データで高性能な音声処理を構築可能とすることを目指している。日本語特有の感情表現に有用なモデルとされており、音声感情認識の性能を上げている。実験結果を見ると、くしなだは11時間程度の学習データから84.67%の感情認識率を実現した。

このように音声基盤モデルを汎用的な音声処理の事前学習モデルとして用いることで、さまざまな音声AIの実現できる。訛りを付け加えたり、感情表現を変えたり、相手の感情を推定するタスクにも応用させたりといったことが可能だ。中間表現は画像や言語、ロボットのAIにつなぐ表現としても活用可能だ。深山氏は「音声や音響は発話のみならず空間把握においても重要なものだ」と語る。

Copyright © ITmedia, Inc. All Rights Reserved.