ROSのAIエージェント「RAI」を使って自然言語でアームロボットを制御する:生成AIで変わるロボット制御(後編)(3/4 ページ)

ロボット制御における生成AIの活用に焦点を当て、前後編に分けて解説する。後編では、ROSのAIエージェントライブラリ「RAI」の概要と、RAIを用いた生成AIによるアームロボット制御の事例を解説する。

3.実機を使用した制御例

ここからは実際のロボット制御について解説する。

3.1. ハードウェア構成

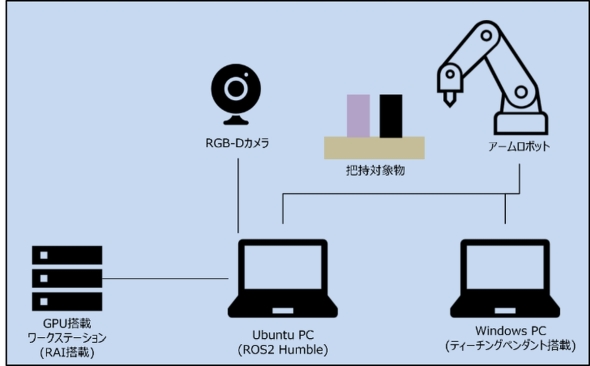

まず、本検証におけるハードウェア構成を解説する。図1は検証における全体の構成図である。それぞれの機器について役割を解説していく。

3.1.1. GPU搭載ワークステーション

検証においてローカル環境で起動するLlamaのモデルを使用したため、GPU搭載ワークステーションにRAI、LLMを導入し、実行する役割を持っている。

3.1.2. Ubuntu PC(ROS 2 Humble)、Windows PC(ティーチングペンダント搭載)

アームロボットを制御するために2台のPCを使用した。

Ubuntu PCはアームロボットをROS 2で制御するためのもので、RAIから送られてきたロボット制御通信を受け取り、ROS 2のアームロボットのパスプランニングライブラリ「MoveIt2」で制御を行う。

Windows PCにはアームロボット用のティーチングペンダントソフトが搭載されている。Ubuntu PCとアームロボットが通信を行うには、ティーチングペンダント側から設定が必要なため、接続を行っている。

3.1.3. RGB-Dカメラ、アームロボット、把持対象物

アームロボットには、デンソーウェーブ製の産業用ロボット「COBOTTA」を、カメラは、把持座標を算出するために距離計測が可能なRGB-Dカメラを使用した。把持対象は、最初の動作検証として形状が単純な、色のついた消しゴムを選定した(図2)。

3.2. 技術構成

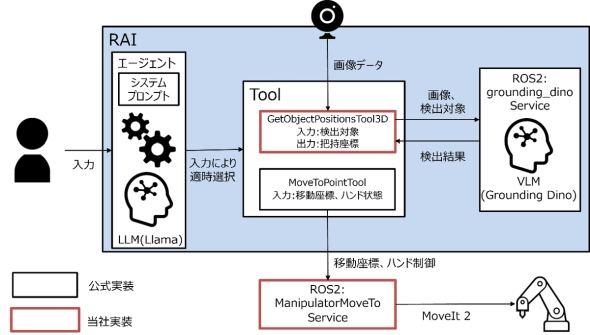

次に本検証で使用した技術構成やソフトウェアについて解説する。技術構成は、図3の通り。RAIを中心とし、ユーザーが入力したタスクをLLMが理解し、システムの中で定義されたツールを動的に呼び出し、カメラ画像から物体認識やロボット制御を行う。

3.2.1. RAIのシステムプロンプト

今回のシステムでのプロンプトは

“あなたは物体を検知して操作することができるアームロボットです。定義されている機能のみを使用してください。”

などの内容を定義している。検証中に意図しない挙動を起こした場合は、システムプロンプトに制限事項やルールを追加していった。

Copyright © ITmedia, Inc. All Rights Reserved.