製造業の生成AI普及の起爆剤 手のひらサイズのAIスパコンがもたらす革新:生成AI

生成AI普及の起爆剤となる手のひらサイズのAIスパコン「NVIDIA DGX Spark(TM)」が登場した。最大2000億パラメーターのLLMを扱える高い性能が特徴だ。ビジネスの価値向上や製造現場の課題解決を目的とした生成AIアプリケーションのプロトタイピングやPoCに最適である。

AI(人工知能)技術は製造業にさまざまな恩恵をもたらしてきた。需要予測の高精度化、設計や解析の最適化、検査品質の向上、設備や機械の予防保全などがその例だ。

生成AIはそうした取り組みを新たな局面に導こうとしている。製品企画の支援に始まり、現場に蓄積されたノウハウやいわゆる匠の技の形式知化、過去トラブル文書や類似図面の効率的な検索、社内の規則や手続きに関するチャットボットなど、さまざまな応用が提案されている。

菱洋エレクトロ ソリューション事業本部 専任部長の中村亮一氏は「自社の競争力を高めるには、生成AIに関してニーズやアプリケーションを検討するフェーズから、開発や活用を進めるフェーズへとできるだけ早く移行することが重要といえるでしょう」と提案する。

企業での生成AI開発に適したオンプレミス環境

生成AIを企業内で活用するには、社内に蓄積されている過去トラブル情報、過去図面、受発注情報、顧客情報、研究情報や設計情報などを、ファインチューニング(追加学習)やRAG(検索拡張生成)といった手法を用いて既存のLLM(大規模言語モデル)に組み込む必要がある。

さまざまなプロトタイピングやPoC(概念実証)を繰り返しながら、実効ある生成AIアプリケーションを開発するには、専門性を持った人材と利用しやすい開発環境をそろえることが重要だ。また、社内の情報を扱う際にはセキュリティも考慮しなければならない。

こうした背景もあって、あらためて注目されているのがオンプレミスでの環境構築だ。

菱洋エレクトロ ソリューション事業本部 ソリューション技術部 営業技術グループの小宮敏博氏は「クラウドとして提供されているAI用のインスタンスを利用する方法が一般的ではありますが、ファインチューニングやRAGの開発には膨大な計算リソースが必要になるため利用料は高額になり、ときには確保していた予算を超えてしまうことも十分に考えられます」と説明する。

また、セキュリティの観点から重要な情報を社外クラウドに置くことを禁止または制限している企業も多い。「オンプレミスであれば、開発者は時間制限なく環境を利用でき、データを社外に置く必要もありません。トライアンドエラーやプロトタイピングを繰り返すには最適です」(小宮氏)。

オンプレミスの課題は初期投資負担が一般に大きいことだが、その壁を打ち破る新たなAIスーパーコンピュータが登場した。

デスクサイドのAIスパコン「NVIDIA DGX Spark」が登場

オンプレミスでの生成AI開発の第一歩として最適なハードウェアプラットフォームが「NVIDIA DGX Spark」である。

幅150×奥行き150×高さ50.5mmとコンパクトな筐体に、最大約250TFLOPS(FP16)、最大1PFLOPS(FP4)という極めて高いAI処理性能を持つ「NVIDIA Grace Blackwell Superchip」と128GBの統合メモリを搭載した、最大で2000億(200B)パラメーターの大規模モデルを処理できる手のひらに乗るサイズのAIスパコンだ。

先ほども触れたように、オンプレミスは初期投資負担が大きいという課題が一般に指摘されるが、NVIDIA DGX Sparkは100万円以下と比較的導入しやすい価格帯であり、クラウドの月額費用を考えれば十分に釣り合う額といえる。

NVIDIA DGX Sparkの主な特徴は4つある。

1つ目は、NVIDIA DGX Sparkの心臓部となるNVIDIA Grace Blackwell Superchipだ。Armベースで20コアのGrace CPUと、最新世代のBlackwell GPUがシングルパッケージに統合されている。このうちGPU部分は、生成AIの推論やファインチューニングを高速化するために開発された第2世代のTransformerエンジンや第5世代のTensorコアなどで構成されていて、1つ前のHopper世代にはなかったFP4がサポートされたことで、AIモデルを量子化したときにより高い推論処理性能が得られるようになっている。

2つ目は、128GBという大容量の統合メモリの搭載である。Grace CPUとBlackwell GPUの両方からアクセスでき、最大2000億パラメーター(スパース化前提)のAIモデルをインメモリで処理できる。700億パラメーター以上のLLMを動かしても余裕がある。

3つ目は、2台のNVIDIA DGX Sparkをクラスタとして構成するために用いるインターコネクト「NVIDIA ConnectX-7(R)」とQSFPポートを標準で装備したことだ(接続用ケーブルは別売)。2チャンネル分の100GbEに相当するインターコネクトによってクラスタ構成となり、2台分のメモリとGPUリソースを活用した分散推論/分散学習を行え、より大規模なモデルにも対応できる。

4つ目の特徴は、購入後から即座に利用可能になるターンキーのソフトウェアスタックである。Ubuntuベースの「DGX OS」の他、プログラミング環境の「CUDAツールキット」などがプリインストールされている。このため、ユーザーが個別にリソースを集めたりデプロイする必要がない。

外観検査AIやチャットボットなどに応用が可能

NVIDIA DGX Sparkは1台で使用した場合でも最大200Bパラメーターの言語モデルを処理できるため、前述のようなLLMのファインチューニングやRAGの他、画像を生成する拡散モデル、映像も扱える視覚言語モデル(VLM)、複数のAIモデルを組み合わせたマルチエージェントなど、さまざまなモデルや構成を試すことができる。

小宮氏は「例えば、監査役にGPT-OSS 120B、コード生成にDeepSeek Coder、画像分析にQwen-VLを統合メモリ上に同時にロードし、必要に応じて複数のモデルを切り替えながら、連携させて複雑なタスクを処理する、といったシステムも実現できます。この場合、メモリ使用量は89GBから110GBとなり、128GBの統合メモリに収まります」と説明する。

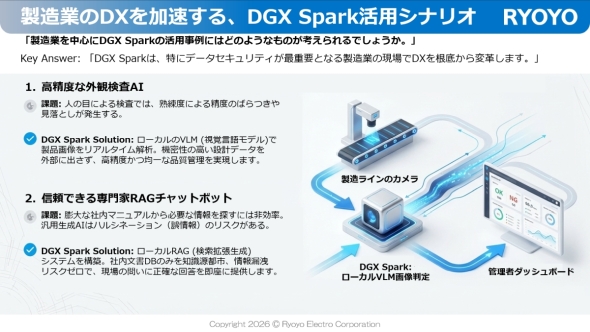

製造業向けのアプリケーションとしては、VLMを使って製品画像をリアルタイムに解析する機能を既存の外観検査システムにアドオンし高精度かつ均一な品質管理につなげるシステムや、社内文書をベクトルデータベースに格納したRAGチャットボットなどが具体的なアイデアとして挙げられるだろう。

「NVIDIA DGX Spark」の製造業向け活用シナリオの例。高精度な外観検査AIや信頼できる専門家RAGチャットボットなどが挙げられる。なお、高精度な外観検査AIについてはPoCでの利用を想定[クリックで拡大]

NVIDIA DGX Sparkであれば、クラウドのような従量課金を気にする必要はなく、データを外部に置く必要もないため、プロトタイピングやPoCを進めやすい。

AI Techmate Programで顧客の生成AI活用を支援

生成AIを企業で本格的に活用しようとすれば、ファインチューニング、RAG、マルチエージェントなどの手法を使って自社の業務に適したアプリケーションを用意する必要がある。その開発やプロトタイピングには高性能かつ潤沢なGPUリソースが必要で、専門人材の確保を含めて高いハードルになっていた。デスクサイドに置けて、開発に必要なソフトウェアスタックがすぐに利用できるNVIDIA DGX Sparkは、いわば「生成AI普及の起爆剤」になり得る製品といえる。

実際に菱洋エレクトロからの販売台数も増加していて、中村氏は「NVIDIA DGX Sparkは当社での取り扱い実績が多い製品の一つだ」と述べる。

なお、同社がこれまで販売したNVIDIA DGX Sparkのユーザー層を調べたところ、29%が企業のAI研究開発部門、11%がスタートアップ/中小企業、10%が学術研究機関だったという。ファインチューニングやマルチモーダルLLM活用のプロトタイピングに加え、外観検査、ロボティクス、セキュリティ監視、ライフサイエンスへの応用検証などが主な用途として挙げられている。個人での購入が22%と多いのもNVIDIA DGX Sparkの特徴で、生成AIに関するスキルの習得、映像制作、個人事業としてのアプリケーション開発などに活用したいと回答しているそうだ。そして、同調査の利用用途カテゴリーの割合においてLLM/生成AIが49%を占めるという事実は、NVIDIA DGX SparkがLLM/生成AIの活用に向けた道筋を開くことを期待されていることがよく分かる結果となっている。

また、NVIDIA DGX Sparkは、NVIDIAのレファレンス構成をベースに、OEMパートナー各社からも提供されている。基本仕様はおおむね共通で、主にストレージ容量などの構成差や、オンサイト保守を含むサポート内容がベンダーごとに異なる。菱洋エレクトロは顧客要件に応じて、こうしたOEMモデルを含め最適な形態を提案/提供する。顧客がNVIDIA DGX Sparkからより大規模なGPUサーバやGPUクラスタにスケールアウトさせたい場合には、これまで取り扱ってきたNVIDIA製品のノウハウを生かしながら最適なソリューションを提案するという。

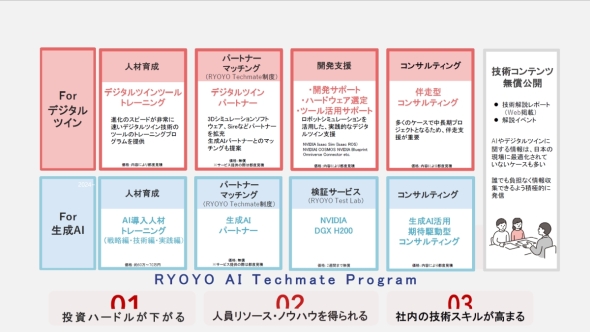

さらに、菱洋エレクトロならではの取り組みが顧客の生成AI活用やデジタルツイン構築を支援する「AI Techmate Program」だ。中村氏は「経営レベルや現場レベルでの課題やニーズを伺いながら、コンサルティング、開発支援、パートナーとのマッチング、検証用のテストラボおよび人材育成などを提供するサービスです。2024年10月にサービスを発表して以来、多くのお引き合いをいただいており、実際に幾つかのプロジェクトが進んでいる状況です」と強調する。なおAI Techmate Programは、特定製品の導入を前提とせず、生成AI活用の企画/PoC/運用設計を支援する枠組みとして提供している。その支援内容は以下の図の通りだ。

菱洋エレクトロの「AI Techmate Program」のサービス内容。生成AIにとどまらず、AIモデルの学習環境となるデジタルツインを構築するためのサービスもラインアップに加えている[クリックで拡大]

いわゆるモノ売りにとどまらず、生成AI活用の次のフェーズを支援するサービスを展開しているのが菱洋エレクトロの強みだ。生成AIの活用を検討しているのであれば、NVIDIA DGX Sparkの販売と生成AI活用の支援で高い実績を持つ同社にぜひ相談してほしい。

Copyright © ITmedia, Inc. All Rights Reserved.

関連リンク

提供:菱洋エレクトロ株式会社

アイティメディア営業企画/制作:MONOist 編集部/掲載内容有効期限:2026年3月3日